IBM新的AI工具箱让你的深度学习网络得以更好利用

2018年04月18日 由 nanan 发表

716181

0

IBM昨日宣布推出面向AI开发人员的敌对稳健性工具箱。该工具箱采用代码库的形式,其中包括攻击代理、防御实用程序和基准测试工具,这些工具允许开发人员将旧式韧性集成到敌对攻击中。该公司称这是第一次采用此种形式。

IBM安全系统CTO Sridhar Muppidi表示:“一些现有模式针对对抗性AI所面临的最大挑战之一是它们非常具有平台特定性。IBM团队设计了他们的敌对稳健性工具箱,以实现平台无关性。无论你是在Keras或TensorFlow中编码/开发,都可以应用相同的库来构建防御系统。”

这就像AI的混合武术训练师一样,评估DNN的韧性,教它定制防御技术,并提供一种内部的反病毒层。最后一个可能不是标准的练习,但对DNN来说绝对是至关重要的。

敌对性攻击是那些希望破坏、重新使用或欺骗AI的不良行为者犯下的。它们以多种方式进行,从物理混淆到对付DNN机器学习攻击形式的反AI。

如果AI抵御能够学习的对手的想法不算恐怖,那么对人类的潜在危险是绝对可怕的。

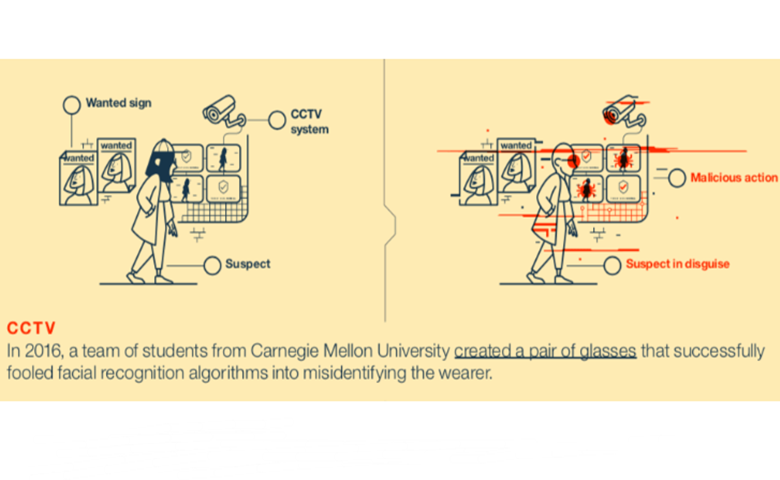

在中国,面部识别软件是执法技术的一个重要组成部分,其中包括配备了AI的闭路电视摄像头,能在6万多人中挑出一张脸。随着AI变得更有能力,西方世界可能会争相效仿。

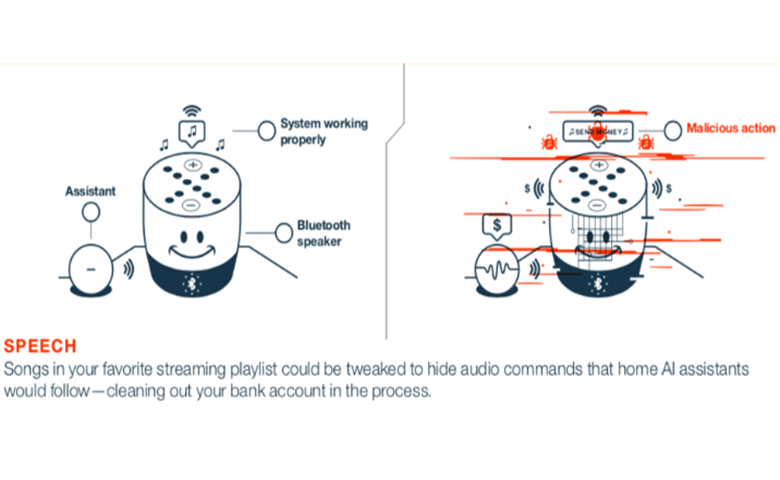

今年早些时候,就上图所示的语音系统漏洞进行了报道,并解释说,语音对文本系统的欺骗意味着语音助手将产生不好的消息。黑客并不一定要依靠从你最喜欢的播放列表中选择一首歌曲,他们可以在公共交通工具上,或者在办公室里,假装自己在听音乐,然后嵌入信号。

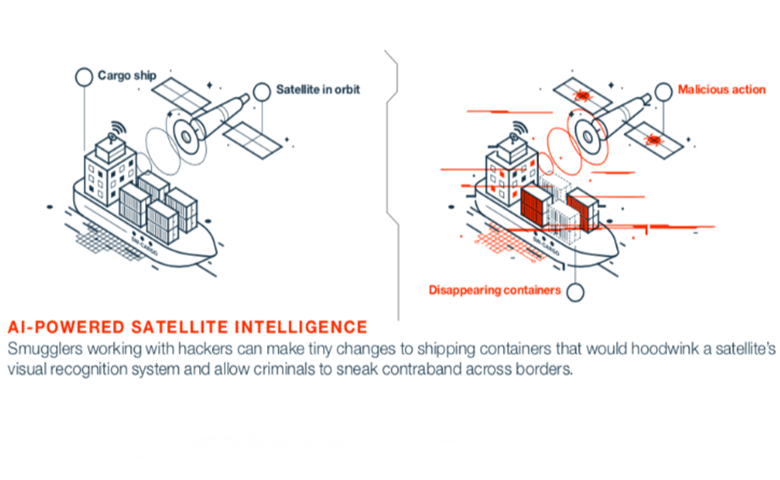

这些威胁还包括欺骗GPS误导船只、攻击舰载系统、伪装船只的ID,以欺骗AI驱动的卫星。随着越来越多的全球AI系统上线,国家支持的针对军用船只的行动也日益成为现实。去年,美国海军领导人发现自己在回答有关海上一系列神秘冲突的问题时,对抗系统的攻击就不止一次出现。

AI系统特别容易受到攻击的领域包括无人驾驶汽车和军用无人机,如果它们的安全受到威胁,它们都可能成为黑客的武器。实际上,所有的DNN都需要有抵御攻击的能力。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消