DeepMind研究:测试神经网络的抽象推理

2018年07月12日 由 浅浅 发表

318175

0

机器能学会抽象推理吗?这是谷歌子公司DeepMind发表的一篇新论文的主题,题为“Measuring abstract reasoning in neural networks”,将在瑞典斯德哥尔摩举行的国际机器学习会议上发表。

研究人员将抽象推理定义为在概念层面检测模式和解决问题的能力。人类的语言,空间和数学推理可以通过测试来经验性地测量,如通过梳理形状位置和线条颜色之间的关系。但那些测试并不完美。

“问题是,即使是人类,如果受试者准备太多,这样的测试也可能无效,因为可以学习特定测试的启发式方法,从而缩短了对普遍适用的推理的需求,”研究人员解释说,“鉴于神经网络具有惊人的记忆能力,这种潜在的缺陷在神经网络中更为严重。”

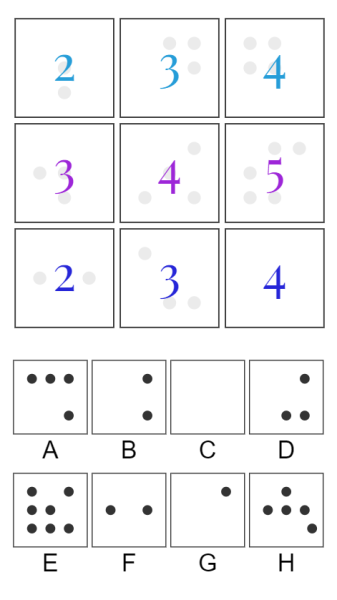

团队的解决方案是一个生成器,它创建涉及一系列抽象因素的问题,包括“渐进”之类的关系以及“颜色”和“大小”之类的属性。他们限制这些因素来创建不同的问题集,例如,揭示的谜题仅在应用于线条颜色时的渐进关系,以测试和训练机器学习模型。人们的想法是,高熟练度的算法,很有可能推断出他们从未见过的概念。

机器学习模型完成的一个视觉测试

大多数模型在测试中表现良好,有些模型的性能高达75%,研究人员发现,模型准确性与推断任务的潜在抽象概念的能力密切相关。他们通过训练模型来获得答案,从而提高了性能,并预测了应该考虑的关系和属性来解决这个难题。

团队写道,“有些模型学会了解决复杂的视觉推理问题,为此,他们需要从原始像素输入中诱导和检测抽象概念的存在,如逻辑运算和算术进展,以及将这些原则应用于从未观察到的刺激。”

但即使是表现最佳的神经网络Wild Relation Network(WReN)也有其局限性:它无法推断出在训练期间没有看到的属性值,并且在对先前看到的关系进行训练时,它在泛化任务上的表现更差(例如,形状数量的进展)或新属性(大小)。

“我们的研究结果显示,对于泛化得出普遍的结论可能是无益的:我们测试的神经网络在某些泛化方案中表现良好,而在其他方面表现很差,”该团队在博客文章中写道,“他们的成功取决于一系列因素,包括所用模型的架构以及该模型是否经过训练,以便为其答案选择提供可解释的理由。”

最终的结果可能是一个大杂烩,但研究人员还没有放弃。他们打算探索改进泛化的策略,并探索在未来的模型中使用结构丰富、但普遍适用的归纳偏差。

论文:proceedings.mlr.press/v80/santoro18a/santoro18a.pdf

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消