MIT开发新型无监督语言翻译模型,又快又精准

2018年10月31日 由 浅浅 发表

459544

0

麻省理工学院的研究人员开发了一种新颖的“无监督”的语言翻译模型,这意味着它无需人工注释和指导即可运行,这可以使基于计算机的更多语言翻译更快,更高效。

麻省理工学院的研究人员开发了一种新颖的“无监督”的语言翻译模型,这意味着它无需人工注释和指导即可运行,这可以使基于计算机的更多语言翻译更快,更高效。谷歌,Facebook和亚马逊的翻译系统需要训练模型来查找数百万文档中的模式,例如法律和政治文档或新闻文章,这些文档已被人类翻译成各种语言。给定一种语言的新单词,然后他们就可以找到另一种语言中匹配的单词和短语。

但是这种翻译数据耗时且难以收集,并且对于全世界使用的7000种语言中的许多语言而言可能根本不存在。最近,研究人员一直在开发“单语”模型,这些模型使两种语言的文本之间进行翻译,但两者之间没有直接的翻译信息。

本周在自然语言处理经验方法会议上发表的论文中,麻省理工学院计算机科学与人工智能实验室(CSAIL)的研究人员描述了一种比这些单语模型运行得更快,更有效的模型。

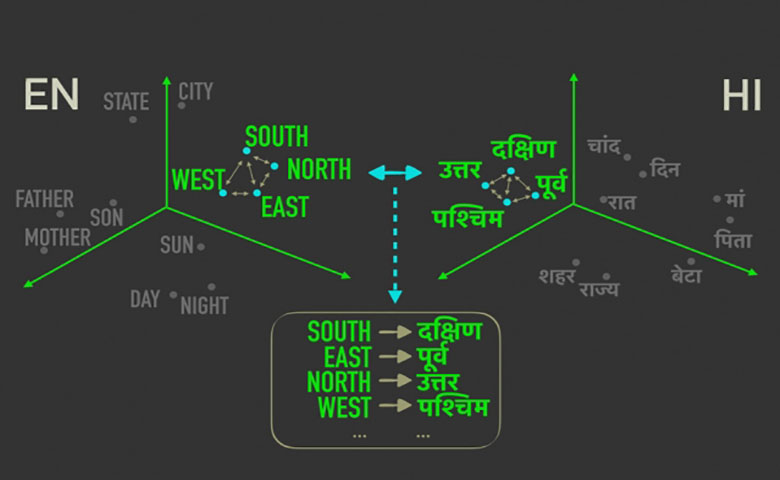

该模型利用统计中的度量,Gromov-Wasserstein距离,本质上是测量一个计算空间中的点之间的距离,并将它们与另一个空间中的类似距离点进行匹配。他们将这种技术应用于两种语言的“单词嵌入”,这两种语言的词表示为向量(基本上是数字数组),具有相似含义的单词聚集在一起。在这样做时,模型在两个嵌入中快速对齐单词或向量,这两个嵌入通过相对距离最密切相关,这意味着它们可能是直接翻译。

在实验中,研究人员的模型与最先进的单语模型一样准确,有时更准确,重要的是速度更快,而且仅使用一小部分计算能力。

“该模型将两种语言中的单词视为一组向量,并通过基本保留关系将这些向量从一组映射到另一组,”该论文的共同作者,CSAIL研究员Tommi Jaakkola表示,“这种方法可以帮助翻译低资源语言或方言,只要它们有足够的单语内容。”

CSAIL博士生第一作者David Alvarez-Melis表示,该模型代表了机器翻译的主要目标之一,即完全无监督的单词对齐。“如果你没有任何与两种语言相匹配的数据,你可以映射两种语言,并使用这些距离测量,对齐它们。”

关系最重要

对于无监督的机器翻译来对齐字嵌入并不是一个新概念。最近的工作训练神经网络直接在两种语言的词嵌入或矩阵中匹配向量。但是这些方法在训练期间需要进行大量调整以使对准完全正确,这是低效且耗时的。

另一方面,基于关系距离测量和匹配矢量是一种更加有效的方法,不需要太多微调。无论单词向量落在给定矩阵中的哪个位置,单词之间的关系(即它们的距离)都将保持不变。例如,“父亲”的向量可能落在两个矩阵的完全不同的区域中。但“父亲”和“母亲”的载体很可能总是紧密相连。

“这些距离是不变的,”Alvarez-Melis说,“通过查看距离,而不是向量的绝对位置,那么你可以跳过对齐并直接匹配向量之间的对应关系。”

这就是为什么Gromov-Wasserstein能派上用场,该技术已被用于计算机科学,例如帮助在图形设计中对齐图像像素。但是这个指标看起来似乎是为词对齐量身定做的,Alvarez-Melis表示,“如果在一个空间中有一些点或词靠的很近,那么Gromov-Wasserstein会自动尝试在另一个空间找到相应的点集群。”

对于训练和测试,研究人员使用了一个公开可用的单词嵌入数据集,称为FASTTEXT,具有110种语言对。在这些嵌入和其他嵌入中,在类似上下文中越来越频繁出现的单词具有紧密匹配的向量。“母亲”和“父亲”通常会在一起,但距离“房子”更远。

提供“软翻译”

该模型注意到与其他向量密切相关但不同的向量,并且指定了在另一个嵌入中类似的距离向量将对应的概率。这有点像“软翻译”,Alvarez-Melis说,“因为它不是仅仅返回一个单词翻译,而是告诉你这个向量或单词与另一种语言中的单词有很强的对应关系。”

一个例子是一年中的月份,它们以多种语言紧密结合在一起。该模型将看到一组12个向量,这些向量在一个嵌入中聚类,在另一个嵌入中聚类非常相似,“该模型不知道这些是月份,”Alvarez-Melis说,“它只知道有一组12个点与另一种语言中的12个点对齐,但它们与其他单词不同,所以它们可能很好地结合在一起。通过找到每个单词的这些对应关系,它然后同时对齐整个空间。”

Jaakkola说,研究人员希望这项工作可以作为“可行性检查”,将Gromov-Wasserstein方法应用于机器翻译系统,以便更快,更高效地运行,并获得更多语言的访问权限。

另外,模型的一个可能的好处是它自动产生一个值,可以解释为在数字尺度上量化语言之间的相似性。研究人员表示,这可能对语言学研究有用。该模型计算两个嵌入中所有向量彼此之间的距离,这取决于句子结构和其他因素。如果向量都非常接近,它们的分数将接近0,并且它们越远,分数越高。例如,法语和意大利语等类似的浪漫语言得分接近1,而汉语与其他主要语言得分在6到9之间。

Alvarez-Melis说:“简单的数字可以说明语言之间的相似程度,并且可以用来描述语言之间的关系。”

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消