Facebook利用新型机器学习工具打击网络恐怖主义宣传

2018年11月13日 由 浅浅 发表

667412

0

网络上的恐怖主义宣传是较新的现象,在现实世界中,恐怖主义团体对反恐工作具有很强的适应力,所以任何人都不应该对Facebook这样的社交平台上存在这样的动态感到惊讶。越多地发现和删除恐怖主义内容,这些群体就越精明。

网络上的恐怖主义宣传是较新的现象,在现实世界中,恐怖主义团体对反恐工作具有很强的适应力,所以任何人都不应该对Facebook这样的社交平台上存在这样的动态感到惊讶。越多地发现和删除恐怖主义内容,这些群体就越精明。一些恐怖分子试图通过改变他们的技术,放弃旧帐户和创建新帐户,开发新的代码语言以及将消息分成多个组件来避免检测。有时我们会预测这些策略,毫无疑问,这种动态加强了成功打击网络恐怖主义的能力。由于恐怖分子的对抗性转变,Facebook团队决定不过多地透露我们的执法技巧。但团队认为让公众对他们正在做的事情有所了解很重要,其中包括在极少数情况下立即告知执法部门,以便我们确定即将发生伤害的可能性。

新的机器学习工具

团队过去曾提供过有关执法技术的信息,并希望从广义上描述一些证明有效的新策略和方法。

他们现在使用机器学习来评估可能表示支持ISIS或基地组织的Facebook帖子。该工具会生成一个分数,表明该帖子违反我们的反恐政策的可能性,这反过来又有助于我们的审核小组优先考虑分数最高的帖子。通过这种方式,系统可确保审阅者能够首先关注最重要的内容。

在某些情况下,当工具表明该帖子包含对恐怖主义的支持时,我们会自动删除帖子。我们仍然依靠专业审核人员来评估大多数帖子,并且只有在工具的置信度足够高以至于其决定表明它将比我们的人工审核者更准确时才立即删除帖子。

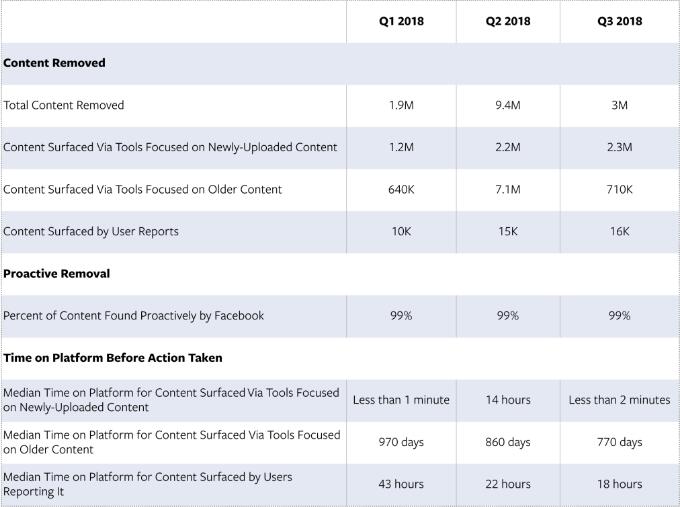

在Facebook的规模上,人工审查和强大的技术都不会阻止所有错误。团队一直在努力平衡积极的政策执行和对用户的保护。我们看到这项工作带来了实实在在的好处:例如,新机器学习工具提供支持的优先级对于减少用户报告的恐怖分子内容停留时间至关重要,从2018年第一季度的43小时到第三季度的18小时。

改进现有工具和伙伴关系

团队还改进了一些现有的主动技术,现在能够更有效地发现恐怖主义内容。例如,通过算法识别违反文本帖子(语言理解)的实验现在可以支持19种语言。同样,虽然团队长期使用图像和视频散列(将文件转换为唯一的数字字符串,作为该文件的“指纹”),但现在还使用音频和文本散列技术来检测恐怖主义内容。

团队继续与全球互联网反恐论坛(GIFCT)组织的技术合作伙伴联盟分享这些数字指纹或“散列”(图像,视频,音频和文本),包括微软,Twitter和YouTube,并制作一些新的散列技术可供参与该联盟的公司使用。

执法进展

我们对技术工具所做的改进使得在寻找和删除Facebook内的恐怖内容方面取得了持续和持续的进展。在2018年第二季度,团队对与伊斯兰国,基地组织及其附属机构有关的940万件内容采取了行动,其中大部分是使用专门技术浮出水面的旧材料。在2018年第三季度,恐怖主义内容的总体删除量下降到300万,其中80万件内容已经过时。

在采取行动之前,人们经常会问到恐怖分子内容会在Facebook上停留多长时间。但分析表明,采取行动的时间是一种不那么有意义的伤害衡量指标,而不是那些更明确地关注实际接收的暴露内容的指标。这是因为一段内容可能会在发布后的几分钟内获得大量观看,或者在被其他人观看或分享之前的几天,几周甚至几个月内仍然可以保持很久。

恐怖分子一直在寻求规避侦查,所以需要通过改进技术,训练和流程来应对此类攻击。随着时间的推移,这些技术会得到改善,但在最初的实施过程中,这些改进可能不会像成熟时那样迅速发挥作用。

尽管这种改进对于强有力的反恐至关重要,但这可能会导致行动时间的增加。狭隘地关注错误的指标可能会阻碍或阻止做最有效的工作。团队正在制定更有意义的指标,专注于曝光而非时间,从而采取行动并在未来分享更多相关信息。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消