Facebook AI可从真实的视频中提取可控角色

2019年04月19日 由 张江 发表

624390

0

还记得那些流行于90年代的FMV游戏吗?那些游戏将预先录制的剪辑与动画雪碧图和3D模型混合在一起,而Facebook正设法让它们重新流行起来。

还记得那些流行于90年代的FMV游戏吗?那些游戏将预先录制的剪辑与动画雪碧图和3D模型混合在一起,而Facebook正设法让它们重新流行起来。在新发布的论文“Vid2Game: Controllable Characters Extracted from Real-World Videos”中,Facebook AI Research的科学家描述了一个系统,能够从真实视频中提取可控角色。

论文作者表示,“我们的方法是从一个不受控制的视频中提取一个角色,使我们能够控制它的动作,该模型生成了该角色的新的图像序列,生成的视频可以是任意背景,系统能有效地捕捉到人的动态和外观。”

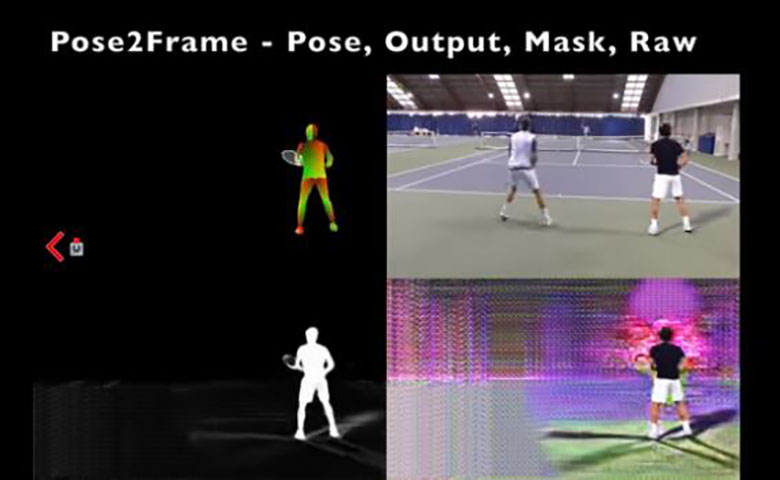

该方法依赖于两个神经网络,Pose2Pose,该框架将当前姿势和单实例控制信号映射到下一个post,以及Pose2Frame,它将当前姿势和新姿势以及给定的背景叠加到输出帧上。这种复原可以通过任意低维信号控制,例如来自操纵杆或键盘的信号。系统足够稳健,可以在动态背景中定位提取的角色。

首先,团队将包含一个或多个角色的输入视频输入到为特定域(例如,跳舞)训练的Pose2Pose网络,将它们及其运动隔离(加上估计的前景空间掩模)。

使用这些和组合的姿态数据,Pose2Frame将场景中与角色相关的变化,如阴影、持有的物品和反射,这些和与角色无关的变化分开,并返回一对与任何所需背景线性混合的输出。

为了训练人工智能系统,研究人员采集了三个视频,每个视频长度为五到八分钟,其中一个是户外网球运动员,另一个是人在室内舞剑,最后一个是人在走路。此方法成功地处理了动态元素,比如其他人和摄像机角度的差异,以及角色服装和摄像机角度的变化。

每个网络都解决了之前未完全满足的计算问题,同时为生成具有逼真图形的视频游戏开辟了道路。此外,从类似YouTube的视频中提取的可控角色,可以在虚拟世界和增强现实中找到其自身的位置。

论文:

arxiv.org/pdf/1904.08379.pdf

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消