谷歌发布Translatotron语音翻译系统,直接翻译语音且保留原声

2019年05月16日 由 董灵灵 发表

841068

0

Google AI发布了Translatotron,Translatotron是基于AI的语音翻译系统,能够将人的声音直接翻译成另一种语言,而且合成的翻译保持原声。

Google AI发布了Translatotron,Translatotron是基于AI的语音翻译系统,能够将人的声音直接翻译成另一种语言,而且合成的翻译保持原声。传统上,语音翻译使用自动语音识别将语音转换为文本,应用机器翻译,然后使用文本到语音来产生翻译,但Translatotron是一种端到端的翻译模型。

语音到语音翻译系统在过去几十年中得到了发展,其目标是帮助说不同语言的人们相互交流。这些系统通常被分成三个独立的部分:

- 自动语音识别将源语音转录为文本,

- 机器翻译将转录文本翻译成目标语言,

- 文本到语音合成(TTS)在目标中生成语音来自翻译文本的语言。

将任务划分为这样的级联系统非常成功,为许多商业语音转语音翻译产品提供动力,包括谷歌翻译。

Translatotron系统避免将任务划分为单独的阶段,提供了比级联系统更多的优势,包括更快的推理速度,自然地避免了识别和翻译之间的复合错误,使得在翻译后保留原始发言者的声音变得简单,并且更好地处理不需要翻译的单词(例如,名字和专有名词)。

Translatotron系统

语音翻译的端到端模型的出现始于2016年,当时研究人员证明了使用单个序列到序列模型进行语音到文本翻译的可行性。2017年,团队证明了这种端到端模型可以胜过级联模型。

最近的研究提出了许多进一步改进端到端语音到文本翻译模型的方法,包括利用弱监督数据。Translatotron更进一步,通过证明单个序列到序列模型可以直接将语言从一种语言翻译成另一种语言的语音,而不依赖于任何一种语言的中间文本表示,正如级联系统所要求的那样。

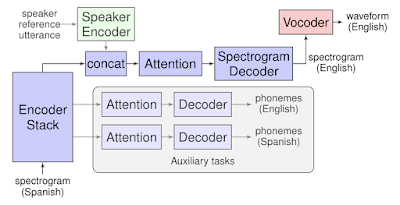

Translatotron基于序列到序列网络,其将源光谱图作为输入并生成目标语言中的翻译内容的光谱图。它还使用了另外两个经过单独训练的组件:一种将输出光谱图转换为时域波形的神经声码器,以及可选的扬声器编码器,可用于在合成翻译语音中维护源扬声器语音的特征。

在训练期间,序列到序列模型使用多任务目标,在生成目标谱图的同时预测源和目标转录物。但是,在推理期间不使用转录本或其他中间文本表示。

性能表现

通过测量BLEU分数来验证Translatotron的翻译质量,该分数是通过语音识别系统转录的文本计算的。虽然结果落后于传统的级联系统,但我们已经证明了端到端直接语音到语音转换的可行性。

在下面的音频剪辑中比较了从Translatotron到基线级联方法的直接语音到语音翻译输出。在这种情况下,两个系统都提供合适的翻译并使用相同的规范语音自然说话。

收听更多音频样本:google-research.github.io/lingvo-lab/translatotron

保持声音特征

通过结合扬声器编码器网络,Translatotron还能够在翻译的语音中保留原始扬声器的声音特征,这使得翻译的语音听起来更自然。此功能利用了之前针对TTS的演讲者验证和演讲者调整的谷歌研究。

扬声器编码器在演讲者验证任务上预先训练,学习从简短的示例话语对扬声器特性进行编码。在该编码上调节频谱图解码器使得可以合成具有类似扬声器特性的语音,即使内容处于不同的语言环境中。

团队给出的音频片段演示了Translatotron在将原始扬声器的声音转换为翻译语音时的性能。在这个例子中,Translatotron提供比基线级联模型更准确的平移,同时能够保留原始说话者的声音特征。保留原始说话者声音的Translatotron输出训练的数据少于使用规范声音的数据,因此它们产生的翻译略有不同。

音频样本:google-research.github.io/lingvo-lab/translatotron/#conversational

结论

Translatotron是第一个能够将语言从一种语言直接翻译成另一种语言的语音的端到端模型,并且在翻译的语音中保留原说话者的声音。我们希望这项工作可以作为未来端到端语音转语音翻译系统研究的起点。

论文:

arxiv.org/abs/1904.06037

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消