智能体通过观看视频学习子程序,进行高水平规划

2019年05月31日 由 冯鸥 发表

18089

0

人类每天都在进行高水平的规划,这对机器人来说并不容易。越来越多的研究表明,一种人工智能训练技术——层级抽象(即视觉运动子程序)可以提高强化学习中的样本效率。

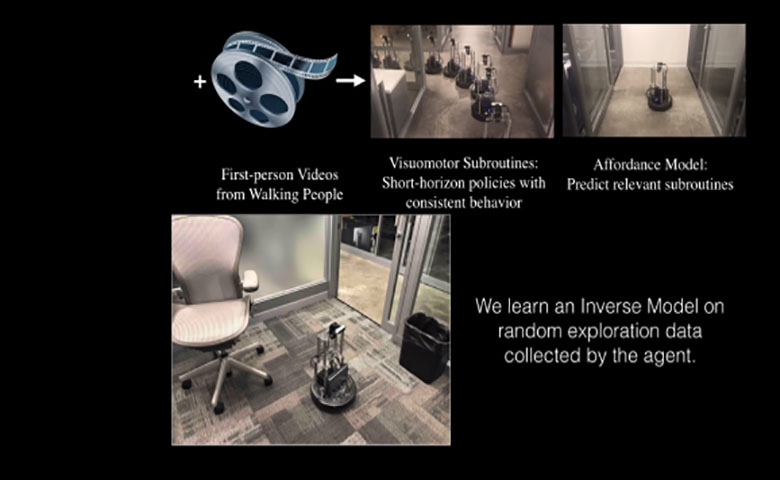

人类每天都在进行高水平的规划,这对机器人来说并不容易。越来越多的研究表明,一种人工智能训练技术——层级抽象(即视觉运动子程序)可以提高强化学习中的样本效率。以前这些层次结构必须通过手工编码或端到端训练获得,这需要大量的时间、注意力和耐心。但在新发布的论文中,Facebook AI Research、加州大学伯克利分校和伊利诺伊大学厄巴纳香槟分校的研究者描述了一种系统,该系统通过摄取带有逆机器学习模型的伪标记的视频来学习层次结构。

它让人想起去年Facebook开源的模型Talk the Walk,它只需要360度的图像和自然语言,标有当地地标的地图,就能在纽约市的街道上导航。

“每天早上,当你决定从厨房拿一杯咖啡时,你会想到走下走廊,左转进入走廊,然后进入右边的房间。你不需要决定确切的肌肉扭矩,而是通过组合这些可重复使用的低级视觉运动子程序,在更高的抽象级别进行规划,以达到你的目标。这些视觉运动子程序使规划能够减轻经典规划中的高计算成本和强化学习中的高样本复杂性。”

在两阶段系统的第一阶段,研究人员通过运行使用智能体训练的模型,使用随机勘探数据的自我监督来生成伪标记,在这种情况下,伪标记是智能体想象的行为。总的来说,该模型从分布在四个环境中的1500个不同位置学习,随机执行30个步骤,生成45000个交互样本。

在第二阶段,将大约217000个伪标记视频切成220万个单独的剪辑输入模型,预测参考视频中相应的动作,而另一个网络则检测参考视频中的动作序列,并将其编码为向量。

另一个模型通过预测从第一帧推断出的轨迹编码,预测出哪一个子程序可以被任何给定的视频帧调用。

在一个真实世界的机器人被部署在办公室环境的实验中,研究人员展示了用于学习技能的被动视频。至少在以前不可见的环境中,与纯交互方法相比,这种方法的性能更好。

最令人印象深刻的是,训练过的模型避免障碍物的速度比下一个最佳基线快4倍,这使得机器人能够完全自主地长距离前进。

团队表示,“尤其令人惊讶的是,这些模型从与环境的45000次互动中学到了很多。通过第一人称视频的成功学习,智能体可以执行连贯的轨迹,尽管它只执行过随机动作。此外,它在学习技能方面的表现优于基于最先进的学习技术,这些技术的训练基于多个数量级的更多互动样本(4.5万对1000万)。”

论文:

arxiv.org/pdf/1905.12612.pdf

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消