对抗Deepfake:AI驱动的成像系统识别图像是否经过修改

2019年06月05日 由 马什么梅 发表

834693

0

为了防范能够改变照片和视频的复杂方法,纽约大学Tandon工程学院的研究人员展示了一种实验技术,利用人工智能对从采集到传输的整个过程中的图像进行认证。

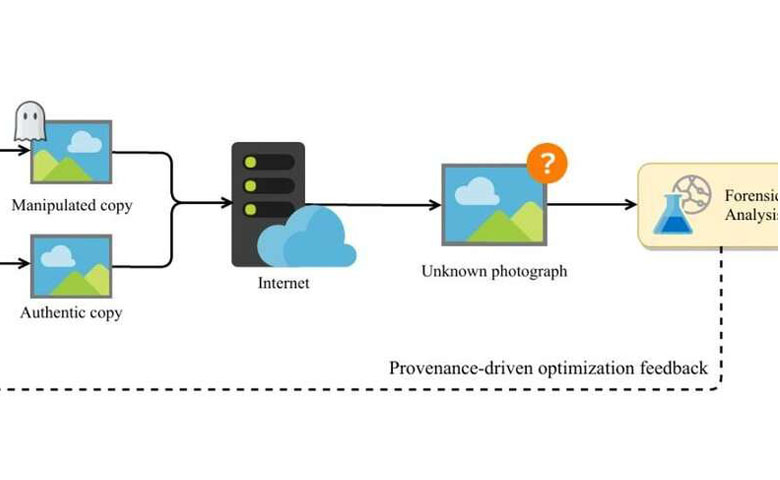

为了防范能够改变照片和视频的复杂方法,纽约大学Tandon工程学院的研究人员展示了一种实验技术,利用人工智能对从采集到传输的整个过程中的图像进行认证。在测试中,这个原型成像管道在不牺牲图像质量的情况下,检测到修改操作的机率从45%提高到90%以上。

确定照片或视频是否真实变得越来越困难。用于改变照片和视频的复杂技术已经变得如此易于获取,以至于“deepfake”照片或视频非常有说服力,通常包括名人或政治人物。

Pawel Korus是纽约大学Tandon计算机科学与工程系的研究助理教授,他开创了这种方法。它用神经网络取代了典型的照片开发流程,在图像采集时将精心制作的部分直接引入图像。这些伪像类似于“数字水印”,对操作非常敏感。

与以前使用的水印技术不同,这些人工智能学习的人造物不仅可以揭示照片操作的存在,还可以揭示它们的特征。

该过程针对相机嵌入进行了优化,可以承受在线照片共享服务所应用的图像失真。将这些系统集成到相机中的优点是显而易见的。

纽约大学Tandon计算机科学与工程教授Nasir Memon表示,“如果摄像机本身产生的图像对篡改更敏感,那么任何调整都被发现的概率很高,这些水印可以在后期处理中存活下来,但是,它们在修改时非常脆弱:如果你改变图像,水印就会破裂。

纽约大学Tandon计算机科学与工程教授Nasir Memon表示,“如果摄像机本身产生的图像对篡改更敏感,那么任何调整都被发现的概率很高,这些水印可以在后期处理中存活下来,但是,它们在修改时非常脆弱:如果你改变图像,水印就会破裂。大多数其他确定图像真实性的方法只是检查最终样品。相比之下,Korus和Memon认为现代数字成像依赖于机器学习。在智能手机上拍摄的每张照片都经过近乎即时的处理,以适应低光照并稳定图像,这两种工作均由板载AI完成。在未来几年,人工智能驱动的流程很可能完全取代传统的数字成像管道。

随着这种转变的发生,Memon指出,“我们有机会改变下一代设备在图像完整性和认证方面的能力。为取证而优化的成像管道可在真假难以确定的区域帮助恢复信任。”尽管该方法在测试中显示出潜力,但还需要额外的工作来优化系统。

开源:

github.com/pkorus/neural-imaging

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消