我的脸难道我还做不了主了?!

2019年11月05日 由 sunlei 发表

970850

0

从一知半解,到窃窃私语,再到公开讨伐,人脸识别引发的数据隐私问题,随着这项技术几年来的大规模下沉,最终到达了一个需要法律深度介入的十字路口。

昨天登上热搜的“人脸识别”,不再是大家单纯过一把嘴瘾,看个热闹,而是因为有人真的付诸了法律行动。

一位大学教授,以“保护隐私”为由把一家使用了人脸识别认证系统的公园告上了法庭。

这桩被誉为“中国人脸识别第一案”的起因很简单:

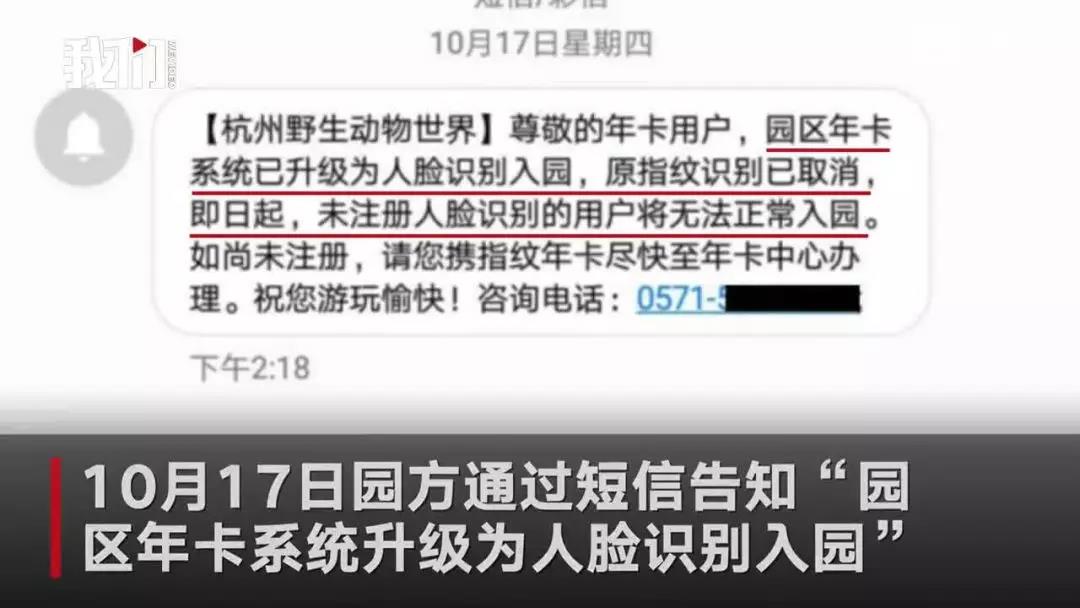

前不久,浙江理工大学特聘副教授郭兵收到了来自杭州野生动物世界的一条短信,提示他的动物园年卡如果不进行人脸识别将无法正常使用。

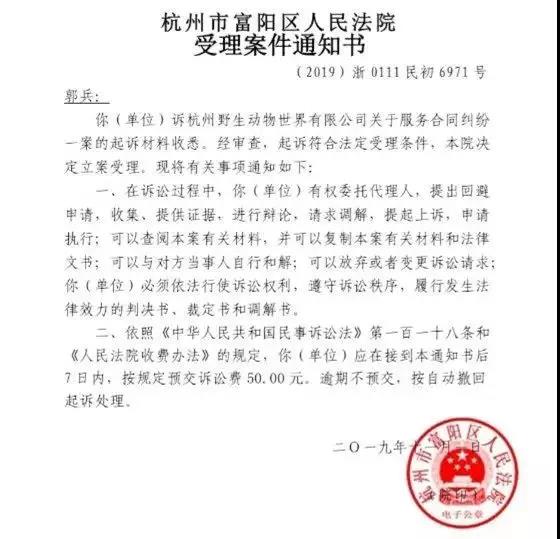

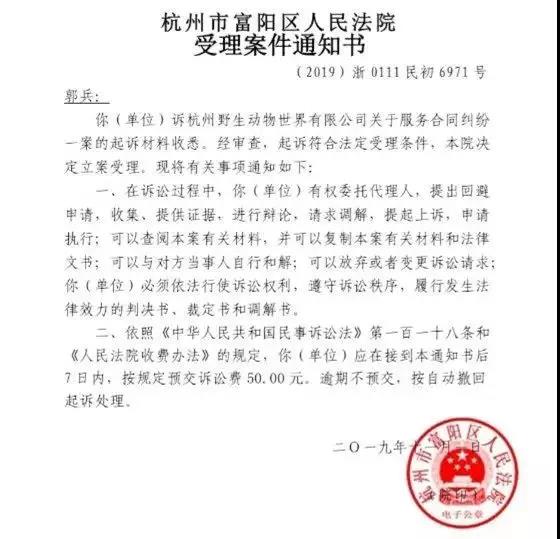

郭兵不同意接受人脸识别,在协商未果的情况下,于10月28日向杭州市富阳区人民法院提起了诉讼。当地法院目前已经决定正式受理此案。

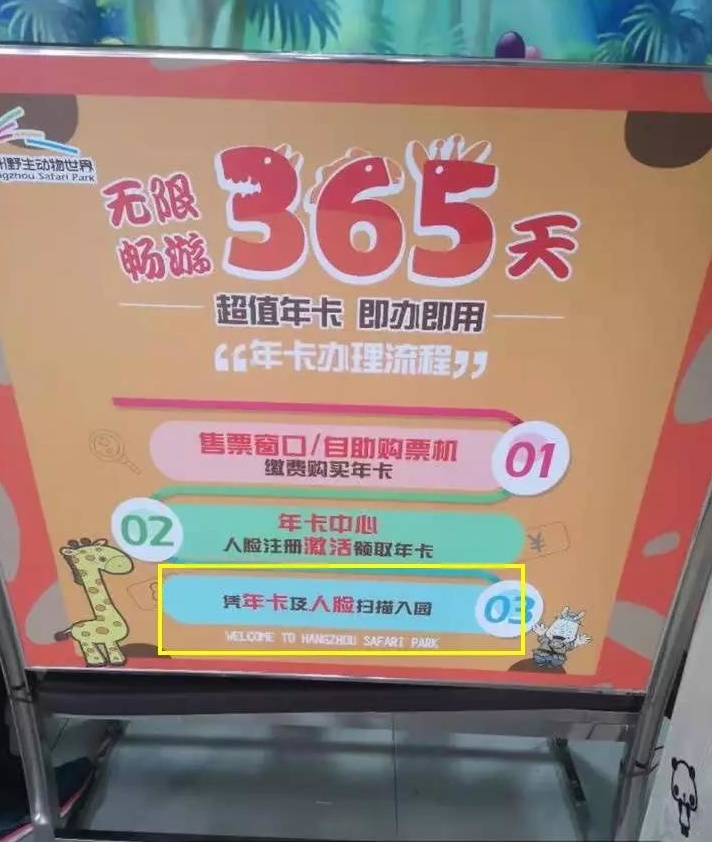

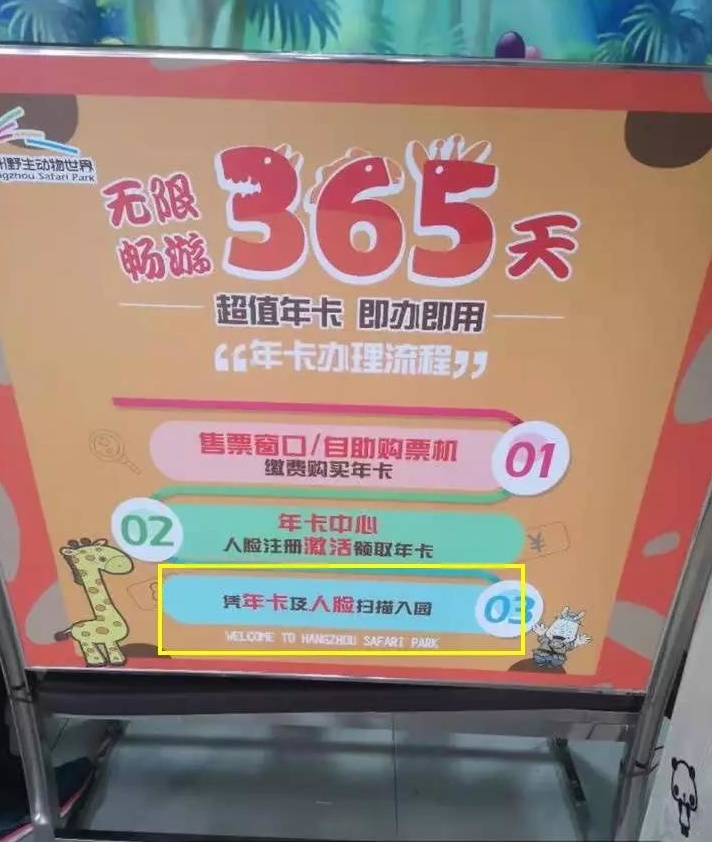

2019年4月27日,郭兵花费1360元,购买了杭州野生动物世界的年卡。该卡有效期为一年,不限次数,入园时要同时验证卡和指纹。

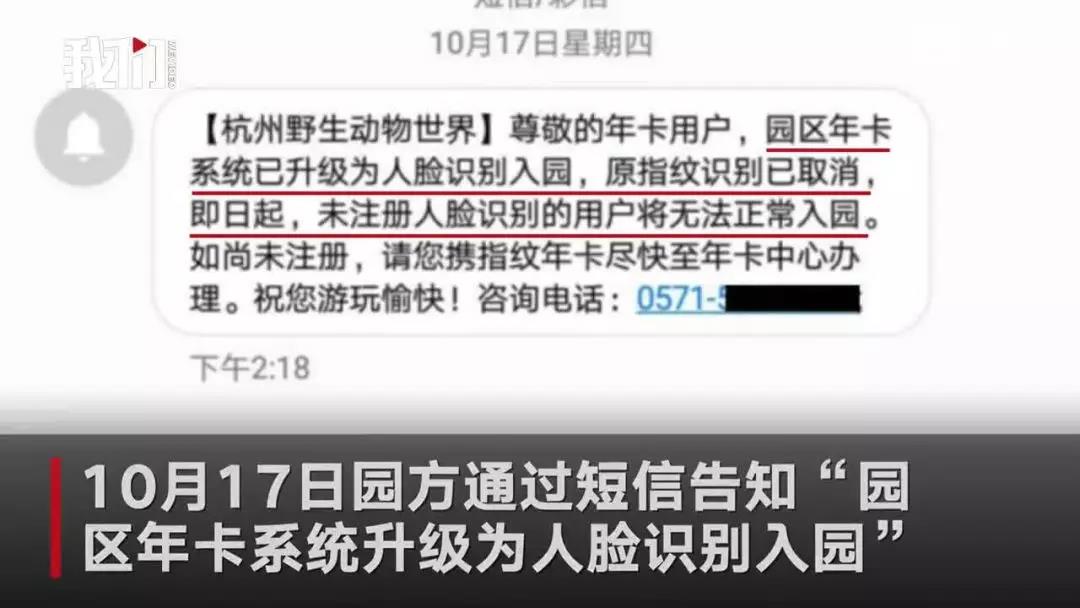

2019年10月17日,园区向他发来短信,称“年卡系统已升级为人脸识别入园,原指纹识别已取消,即日起,未注册人脸识别的用户将无法正常入园。”

“凭什么你没征求我的意见,就默认我们都同意把面部信息提供给你?”

看到短信的郭兵在2019年10月26日特意去了一趟动物园,进行核实。工作人员明确告知他,系统升级了,原来的指纹识别不用了,改用人脸识别。如果没有进行人脸识别注册,既不会退年卡的钱,也不让进动物园玩。

郭兵认为,园区升级后的年卡系统进行人脸识别将收集他的面部特征等个人生物识别信息,该类信息属于个人敏感信息,一旦泄露、非法提供或者滥用,将极易危害包括原告在内的消费者人身和财产安全。根据《消费者权益保护法》第29条之规定,园区收集、使用原告个人信息,应当遵循合法、正当、必要的原则,明示收集、使用信息的目的、方式和范围,并经原告同意;而且,被告收集、使用原告个人信息,应当公开其收集、使用规则,不得违反法律、法规的规定和双方的约定收集、使用信息。

郭兵认为,被告在未经原告同意的情况下,通过升级年卡系统强制收集原告个人生物识别信息,严重违反了相关规定,损害了原告的合法权益。

公园的官方回复也很有意思,因为他们颇为疑惑,一谈到“人脸识别”大家都惊呼“我的隐私数据被盗了”,怎么指纹、电话和身份证信息大家都无动于衷呢?

协商未果。于是,郭兵于2019年10月28日向杭州市富阳区人民法院提起了诉讼,目前杭州市富阳区人民法院已正式受理此案。

北京大学法学院副院长薛军表示:应该禁止,折算退款

理由是:个体生物信息例如人脸,基因,虹膜,指纹,掌纹,声纹,步态等等由于高度敏感原则上应该禁止收集使用,因为这个是伴随终生,不可更改的,一旦泄漏几乎不可救济。对于退款问题,应该遵循公平原则,解除合同的过错方在公园,建议公园按照有效时间段的比例折算退款金额。

北京市律协消费者权益法律事务专业委员会邱宝昌主任:持相同意见

理由是:公园将指纹识别改为人脸识别的做法,属于变更合同条件,侵犯了消费者的自主选择权,消费者有权不同意使用人脸识别,应该由变更合同的一方即公园来承担违约责任。

除了力挺教授,大家又把最近备受争议的校园安防监控项目与 BrainCo脑机接口头环引发的校园监控事件拉出来鞭尸n次。

事实上,当这项技术最终被写上一纸诉状时,小编的心情是复杂的。

一方面,大众对隐私的重视和“较真”似乎有些珊珊来迟。

如果是在两年前,支付宝微信的人脸识别支付尚未推出,机场人脸识别闸机尚未引入,各大银行的APP和柜台机器尚未嵌入人脸识别功能,小区门口还没有架起人脸识别门禁,公司还没有换上人脸识别打卡机……那么或许我们还有说“不”的丁点儿可能性。

但是,在走进一家沙县小吃都可以用刷脸支付的当下,你所谓的“脸权”早已不再由自己掌控。

扪心自问一下,被人脸识别设备环绕,是不是至少有一次的面部信息是自己自愿认证的?

另一方面,现在之所以将枪口都对准了“人脸识别”,实为后者是当下新技术应用中的“出头鸟”。

很多人出口便是“脸和基因数据是不可更改的生物信息,是个人安全的最后防线”,听起来严重不已。但事实上,从目前来看,与人脸信息被盗用相比,手机APP通过你开启的麦克风权限“偷听”你的语音信息,电商网站上的消费信息被偷取、置换和销售会带来更为严重的后果。

后者更为普遍,甚至每时每刻都在发生,否则你以为很多音乐APP的个性化推荐会做的那么精准?有工程师曾透露,“这就是一个行规,没什么大不了的”。

2018年底,亚马逊音箱被爆出发生重大监听事故,正式拉开了“全球智能硬件窃听风云”长篇故事的大幕。当时一位德国用户向当地杂志爆料,在自己向亚马逊讨要自己的个人活动语音数据时,对方发给他了1700份陌生人对话的语音。

而国内一家智能音箱公司的工作人员曾透露,为了能够获得更多语音数据,智能音箱在一定时间内自动开启进行录音在业内已经不是什么新鲜事了。

譬如,曾有朋友半夜起床去厕所时发现,自己床头的某品牌智能音箱正处于唤醒录音状态。

……

但是,以上行为与技术本身有关系吗?

事实上,这些采集和存储数据的旁门左道,跟“人工智能”或“人脸识别”基本是两码事。

我们的矛头其实指偏了。

有人说密码被破解还可以换个密码,而人脸数据一旦泄露就无法更改。但身份证也是如此,一旦身份信息泄露,也同样改不了。

但与身份信息不同的是,身份证电话泄露可以被不法分子用来进行诈骗活动,而人脸数据泄露被直接利用的案例现在其实很少,很多人提到的“假视频制作”其实目前除了被用来恶搞,并无可以参考的真实犯罪案例。

据一位安全工程师透露,目前人脸数据泄露并没有产生大规模黑产,虽然已经有些已知的case,但整体来看,人脸识别数据直接导致的案例量级很小。

在终于有人愿意用时间和金钱成本都极高的法律手段来维护自己的隐私权的当下,我相信这位教授站出来的终极目的不是为了要回那1000多块的卡费,而是用这起诉讼来引起法律界朋友们的重视。

我们必须承认一个残酷现实——发展人工智能,需要大量数据,而要想获得这些数据,必然会牺牲一部分隐私。

三四年前,大家都在关注人工智能底层技术的发展,这个矛盾尚处于蠢蠢欲动阶段,而在技术逐渐被大规模推广和使用过程中,如今矛盾已经在中国大众隐私意识觉醒的过程中被逐渐激化。

所以,我们是放弃发展这项技术而保护隐私?还是让出隐私来发展技术?

都不是。

我们要做的是在隐私与技术发展中间划一条线,需要集体讨论到底需要割让多少公众隐私,来达到一个整体的社会效益。

而画这条线的标准只有一个:如何在我们可以接受的隐私损失范围内,来获得更多好处。

譬如,如果有医学专家告诉一位癌症患者,医院需要他提供一部分个人身体数据来做更多分析以便更好控制病情,你认为他说“不”的几率会有多大?

实际上,我们在很多场景下并非不愿意把自己的一些数据“贡献”出来,而是我们担心,这些数据是否会被非法使用。

因此,解决“如何让数据不被非法使用”这个问题就好了。

然而,事情往往没有那么简单。

1个月前,就有热搜爆出有人在网络商城中公然售卖“人脸数据”,量级高达17万条。有意思的是,这些数据是完全被标注好的,除了人脸位置信息,还有性别、表情情绪、颜值等其他信息。

而这些照片对应的被拍摄者,很多都不知道自己的脸竟然被非法采集过;买家,则是一些做计算机视觉或做人脸模型训练的开发者。

如果是考虑到安防公共安全,人脸数据被使用还尚可进一步讨论,那么医院、商场超市、学校以及各种商业场所,值得我们足够信任吗?

历史告诉我们,一旦一项技术变得无处不在,即使安全问题还没有得到充分解决,人们也开始学着去接受它。

而这意味着,我们需要去更多关注“开发和部署人脸识别技术的公司和使用这项技术的商铺是否值得信任”,而不是“大众是否会因为隐私问题排斥或接受人脸识别技术”。

那么回到这个案子上,你信任动物园以及给动物园提供系统的信息服务商吗?

昨天登上热搜的“人脸识别”,不再是大家单纯过一把嘴瘾,看个热闹,而是因为有人真的付诸了法律行动。

一位大学教授,以“保护隐私”为由把一家使用了人脸识别认证系统的公园告上了法庭。

这桩被誉为“中国人脸识别第一案”的起因很简单:

前不久,浙江理工大学特聘副教授郭兵收到了来自杭州野生动物世界的一条短信,提示他的动物园年卡如果不进行人脸识别将无法正常使用。

郭兵不同意接受人脸识别,在协商未果的情况下,于10月28日向杭州市富阳区人民法院提起了诉讼。当地法院目前已经决定正式受理此案。

事情的经过是这样的……

2019年4月27日,郭兵花费1360元,购买了杭州野生动物世界的年卡。该卡有效期为一年,不限次数,入园时要同时验证卡和指纹。

2019年10月17日,园区向他发来短信,称“年卡系统已升级为人脸识别入园,原指纹识别已取消,即日起,未注册人脸识别的用户将无法正常入园。”

“凭什么你没征求我的意见,就默认我们都同意把面部信息提供给你?”

看到短信的郭兵在2019年10月26日特意去了一趟动物园,进行核实。工作人员明确告知他,系统升级了,原来的指纹识别不用了,改用人脸识别。如果没有进行人脸识别注册,既不会退年卡的钱,也不让进动物园玩。

郭兵认为,园区升级后的年卡系统进行人脸识别将收集他的面部特征等个人生物识别信息,该类信息属于个人敏感信息,一旦泄露、非法提供或者滥用,将极易危害包括原告在内的消费者人身和财产安全。根据《消费者权益保护法》第29条之规定,园区收集、使用原告个人信息,应当遵循合法、正当、必要的原则,明示收集、使用信息的目的、方式和范围,并经原告同意;而且,被告收集、使用原告个人信息,应当公开其收集、使用规则,不得违反法律、法规的规定和双方的约定收集、使用信息。

郭兵认为,被告在未经原告同意的情况下,通过升级年卡系统强制收集原告个人生物识别信息,严重违反了相关规定,损害了原告的合法权益。

公园的官方回复也很有意思,因为他们颇为疑惑,一谈到“人脸识别”大家都惊呼“我的隐私数据被盗了”,怎么指纹、电话和身份证信息大家都无动于衷呢?

协商未果。于是,郭兵于2019年10月28日向杭州市富阳区人民法院提起了诉讼,目前杭州市富阳区人民法院已正式受理此案。

案件引发社会热议

北京大学法学院副院长薛军表示:应该禁止,折算退款

理由是:个体生物信息例如人脸,基因,虹膜,指纹,掌纹,声纹,步态等等由于高度敏感原则上应该禁止收集使用,因为这个是伴随终生,不可更改的,一旦泄漏几乎不可救济。对于退款问题,应该遵循公平原则,解除合同的过错方在公园,建议公园按照有效时间段的比例折算退款金额。

北京市律协消费者权益法律事务专业委员会邱宝昌主任:持相同意见

理由是:公园将指纹识别改为人脸识别的做法,属于变更合同条件,侵犯了消费者的自主选择权,消费者有权不同意使用人脸识别,应该由变更合同的一方即公园来承担违约责任。

网友的表现也没有让人感到意外

除了力挺教授,大家又把最近备受争议的校园安防监控项目与 BrainCo脑机接口头环引发的校园监控事件拉出来鞭尸n次。

事实上,当这项技术最终被写上一纸诉状时,小编的心情是复杂的。

一方面,大众对隐私的重视和“较真”似乎有些珊珊来迟。

如果是在两年前,支付宝微信的人脸识别支付尚未推出,机场人脸识别闸机尚未引入,各大银行的APP和柜台机器尚未嵌入人脸识别功能,小区门口还没有架起人脸识别门禁,公司还没有换上人脸识别打卡机……那么或许我们还有说“不”的丁点儿可能性。

但是,在走进一家沙县小吃都可以用刷脸支付的当下,你所谓的“脸权”早已不再由自己掌控。

扪心自问一下,被人脸识别设备环绕,是不是至少有一次的面部信息是自己自愿认证的?

另一方面,现在之所以将枪口都对准了“人脸识别”,实为后者是当下新技术应用中的“出头鸟”。

很多人出口便是“脸和基因数据是不可更改的生物信息,是个人安全的最后防线”,听起来严重不已。但事实上,从目前来看,与人脸信息被盗用相比,手机APP通过你开启的麦克风权限“偷听”你的语音信息,电商网站上的消费信息被偷取、置换和销售会带来更为严重的后果。

后者更为普遍,甚至每时每刻都在发生,否则你以为很多音乐APP的个性化推荐会做的那么精准?有工程师曾透露,“这就是一个行规,没什么大不了的”。

2018年底,亚马逊音箱被爆出发生重大监听事故,正式拉开了“全球智能硬件窃听风云”长篇故事的大幕。当时一位德国用户向当地杂志爆料,在自己向亚马逊讨要自己的个人活动语音数据时,对方发给他了1700份陌生人对话的语音。

而国内一家智能音箱公司的工作人员曾透露,为了能够获得更多语音数据,智能音箱在一定时间内自动开启进行录音在业内已经不是什么新鲜事了。

譬如,曾有朋友半夜起床去厕所时发现,自己床头的某品牌智能音箱正处于唤醒录音状态。

……

但是,以上行为与技术本身有关系吗?

事实上,这些采集和存储数据的旁门左道,跟“人工智能”或“人脸识别”基本是两码事。

我们的矛头其实指偏了。

有人说密码被破解还可以换个密码,而人脸数据一旦泄露就无法更改。但身份证也是如此,一旦身份信息泄露,也同样改不了。

但与身份信息不同的是,身份证电话泄露可以被不法分子用来进行诈骗活动,而人脸数据泄露被直接利用的案例现在其实很少,很多人提到的“假视频制作”其实目前除了被用来恶搞,并无可以参考的真实犯罪案例。

据一位安全工程师透露,目前人脸数据泄露并没有产生大规模黑产,虽然已经有些已知的case,但整体来看,人脸识别数据直接导致的案例量级很小。

我们应该从哪个角度来看待?

在终于有人愿意用时间和金钱成本都极高的法律手段来维护自己的隐私权的当下,我相信这位教授站出来的终极目的不是为了要回那1000多块的卡费,而是用这起诉讼来引起法律界朋友们的重视。

我们必须承认一个残酷现实——发展人工智能,需要大量数据,而要想获得这些数据,必然会牺牲一部分隐私。

三四年前,大家都在关注人工智能底层技术的发展,这个矛盾尚处于蠢蠢欲动阶段,而在技术逐渐被大规模推广和使用过程中,如今矛盾已经在中国大众隐私意识觉醒的过程中被逐渐激化。

所以,我们是放弃发展这项技术而保护隐私?还是让出隐私来发展技术?

都不是。

我们要做的是在隐私与技术发展中间划一条线,需要集体讨论到底需要割让多少公众隐私,来达到一个整体的社会效益。

而画这条线的标准只有一个:如何在我们可以接受的隐私损失范围内,来获得更多好处。

譬如,如果有医学专家告诉一位癌症患者,医院需要他提供一部分个人身体数据来做更多分析以便更好控制病情,你认为他说“不”的几率会有多大?

实际上,我们在很多场景下并非不愿意把自己的一些数据“贡献”出来,而是我们担心,这些数据是否会被非法使用。

因此,解决“如何让数据不被非法使用”这个问题就好了。

然而,事情往往没有那么简单。

1个月前,就有热搜爆出有人在网络商城中公然售卖“人脸数据”,量级高达17万条。有意思的是,这些数据是完全被标注好的,除了人脸位置信息,还有性别、表情情绪、颜值等其他信息。

而这些照片对应的被拍摄者,很多都不知道自己的脸竟然被非法采集过;买家,则是一些做计算机视觉或做人脸模型训练的开发者。

如果是考虑到安防公共安全,人脸数据被使用还尚可进一步讨论,那么医院、商场超市、学校以及各种商业场所,值得我们足够信任吗?

历史告诉我们,一旦一项技术变得无处不在,即使安全问题还没有得到充分解决,人们也开始学着去接受它。

而这意味着,我们需要去更多关注“开发和部署人脸识别技术的公司和使用这项技术的商铺是否值得信任”,而不是“大众是否会因为隐私问题排斥或接受人脸识别技术”。

那么回到这个案子上,你信任动物园以及给动物园提供系统的信息服务商吗?

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消