可视化人工智能模型的盲点

2019年11月13日 由 TGS 发表

698006

0

随着技术的不断进步,GAN(生成性对抗网络)越来越擅长绘制面孔,它能预测一个人未来的样子,也可以通过模拟法把一个普通人像变成名人像,但它却不适合绘制大的场景。

随着技术的不断进步,GAN(生成性对抗网络)越来越擅长绘制面孔,它能预测一个人未来的样子,也可以通过模拟法把一个普通人像变成名人像,但它却不适合绘制大的场景。麻省理工学院的一个新演示,揭示了在教堂和纪念碑现场受过训练的模型,在绘制场景时做出自我决定,即画什么?放弃什么?而近期的国际计算机视觉会议上,他们提出了一项更大的研究:GAN的盲点。简单来说就是,研究人员想知道GAN不能画出什么。

“研究人员通常专注于描述和提高机器学习系统能做什么?它注重什么?然而,我们则希望研究人员能尽可能多地关注那些系统忽略的数据特征。”麻省理工学院研究生David Bau说。

在GAN中,有一对神经网络协同工作,能根据给定的示例创建出具有超真实感的图像。麻省理工学院教授Antonio Torralba和IBM研究员Hendrik Strobelt在很早之前开发了一种工具,这个工具让识别负责将图像组织成门、树和云等真实世界类别的人工神经元集群成为可能,为后来者奠定了坚实的基础,以至于图像修改软件GANPaint问世,并成为让业余艺术家最喜爱的工具之一。

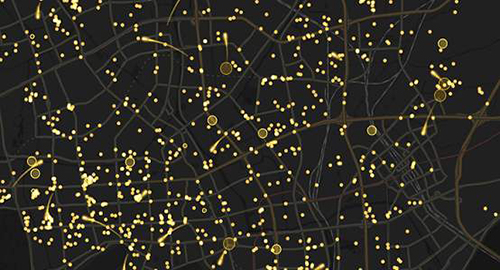

某一天,David Bau在帮助一位艺术家使用GANPaint时,发现了一个问题。当时他像往常一样追踪数字,试图优化照片,在进行到一半的时候,他突然想起自己导师的教诲:不要只看数字,要仔细检查实际的图像。他照做后,诡异的现象出现了,在大场景中,人被选择性排除忽视,这勾起了David Bau的极大兴趣。

某一天,David Bau在帮助一位艺术家使用GANPaint时,发现了一个问题。当时他像往常一样追踪数字,试图优化照片,在进行到一半的时候,他突然想起自己导师的教诲:不要只看数字,要仔细检查实际的图像。他照做后,诡异的现象出现了,在大场景中,人被选择性排除忽视,这勾起了David Bau的极大兴趣。后来,David Bau和他的同事们在室内和室外场景中训练了不同类型的GAN,但无论照片的的背景是什么,GAN始终会忽略重要的细节,例如:一对新婚夫妇在教堂台阶上接吻的场景,在经过GAN重建后,人没了,但教堂的门上却留下了婚纱。

对此,有研究人员怀疑主要原因是机器惰性。尽管GAN训练有素,但通过长期的观察,研究人员发现GAN倾向于忽略一些具有统计意义的细节,并跳过重构起来复杂的图像。

“将一些物体从其表现形式中去除的人工智能,只会实现其数字目标,从而忽略掉对人类来说重要的细节。”David Bau补充道。

简单来说,与其说罪魁祸首是机器的惰性,还不让说,是算法上出了问题——没有人机器理解人的审美。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

下一篇

神经网络的量子优势

热门企业

热门职位

写评论取消

回复取消