2019深度学习语音合成指南(下)

2019年12月22日 由 sunlei 发表

706684

0

前文回顾:2019深度学习语音合成指南(上)

文章链接:https://arxiv.org/abs/1710.07654

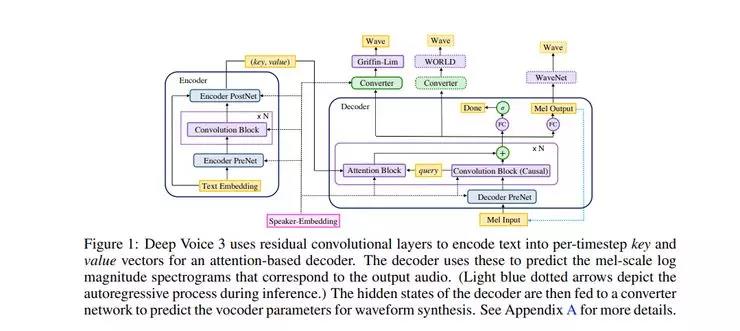

作者提出了一种全卷积字符到谱图的框架,可以实现完全并行计算。该框架是基于注意力的序列到序列模型。这个模型在LibriSpeech ASR数据集上进行训练。

这个模型的结构能够将字符、音素、重音等文本特征转换成不同的声码器参数,其中包括Mel波段光谱图、线性比例对数幅度谱图、基频谱图、谱包络图和非周期性参数。然后将这些声码器参数作为音频波形合成模型的输入。

模型的结构由以下几个部分组成:

对于文本预处理,作者的处理方式包括:大写文本输入字符,删除标点符号,以句号或问号结束每句话,并用表示停顿长度的特殊字符替换空格。

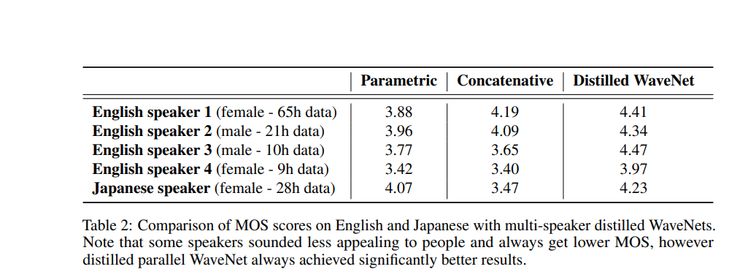

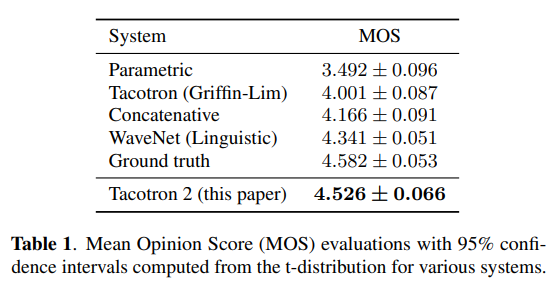

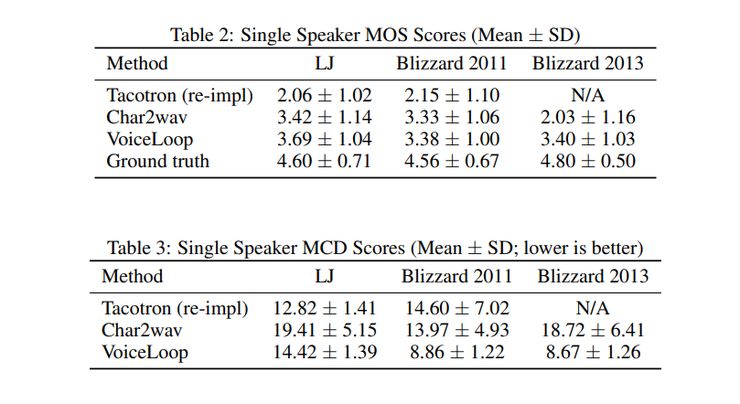

下图是该模型与其他替代模型的性能比较。

文章链接:https://arxiv.org/abs/1711.10433

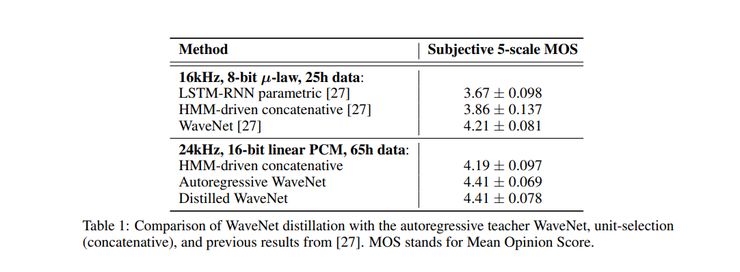

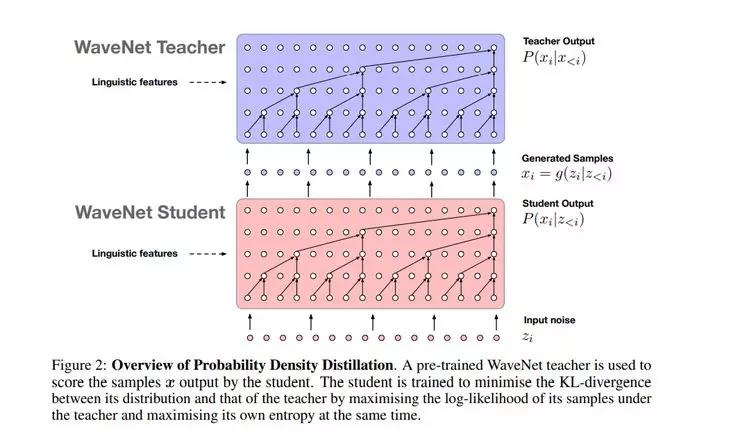

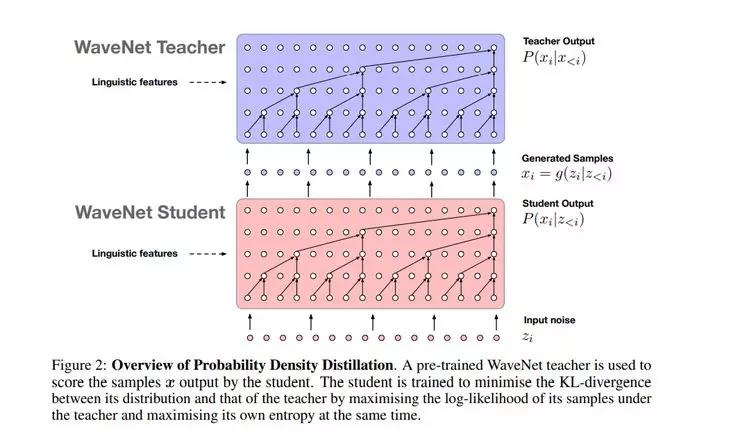

这篇文章的作者来自谷歌。他们引入了一种叫做概率密度蒸馏的方法,它从一个训练过的WaveNet中训练一个并行前馈网络。该方法是通过结合逆自回归流(IAFS)和波形网(WaveNet)的最佳特征构建的。这些特征代表了WaveNet的有效训练和IAF网络的有效采样。

为了进行有效训练,作者使用一个已经训练过的WaveNet作为“老师”,并行WaveNet‘学生’向其学习。目的是为了让学生从老师那里学到的分布中匹配自己样本的概率。

作者还提出了额外的损失函数,以指导学生生成高质量的音频流:

下图显示了这个模型的性能:

文章链接:https://arxiv.org/abs/1802.06006v3

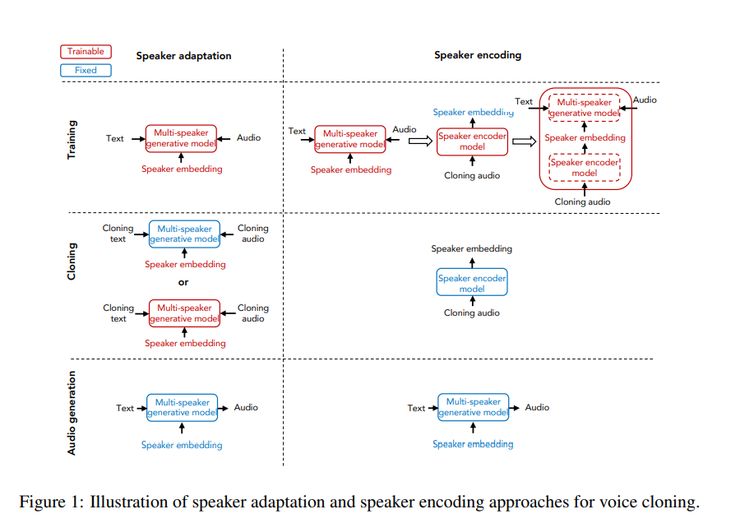

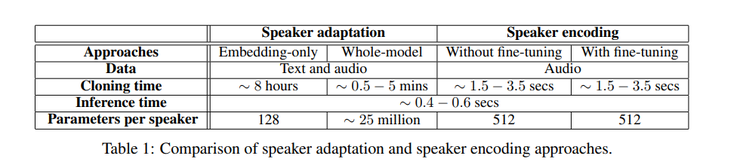

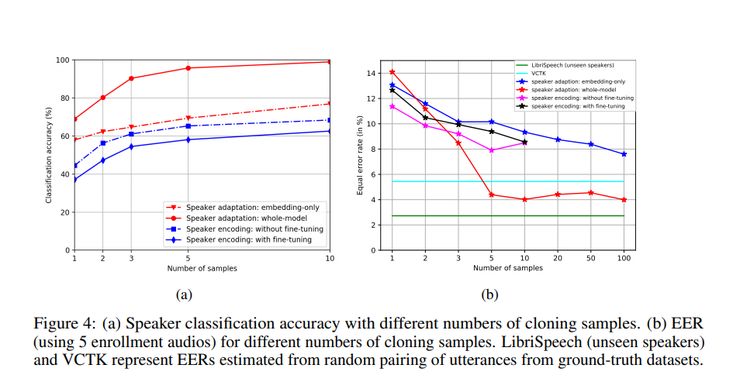

这篇文章的作者来自百度研究院。他们引入了一个神经语音克隆系统,它可以通过学习从少量音频样本合成一个人的声音。

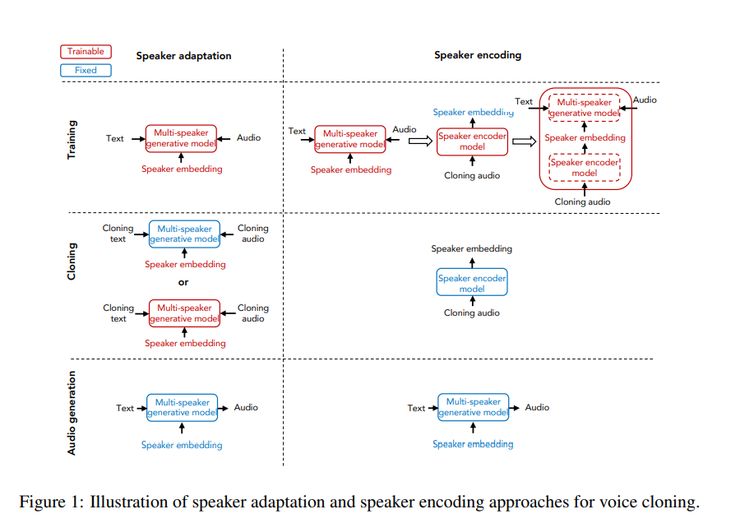

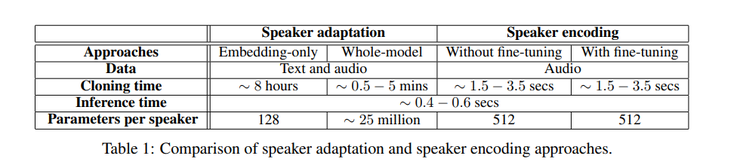

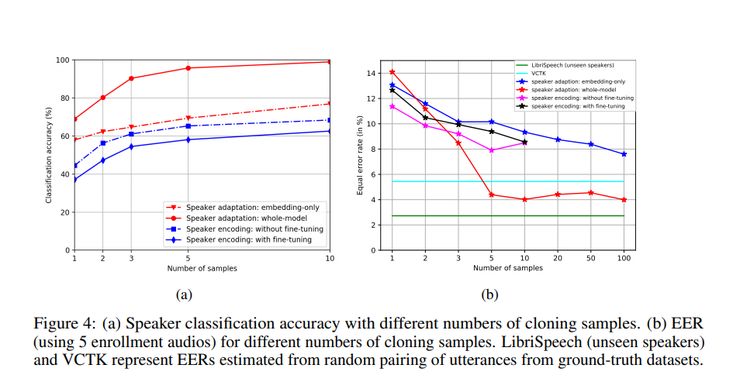

系统使用的两种方法是说话人自适应和说话人编码。说话人自适应是通过对多个说话人的声音生成模型进行微调来实现的,而说话人编码则是通过训练一个单独的模型来直接推断一个新的嵌入到多个说话人语音生成模型。

本文采用Deep Voice 3作为多说话人模型的基线。所谓声音克隆,即提取一个说话人的声音特征,并根据这些特征来生成给定的文本所对应的音频。

生成音频的性能指标决定于语音的自然度和说话人声音的相似度。作者提出了一种说话人编码方法,该方法能够从未曾见过的说话人音频样本中预测说话人声音嵌入。

下面是声音克隆的性能:

文章链接:https://arxiv.org/abs/1707.06588

这篇文章的作者来自Facebook AI研究院。他们引入了一种神经文本到语音(TTS)技术,可以将文本从野外采集的声音转换为语音。

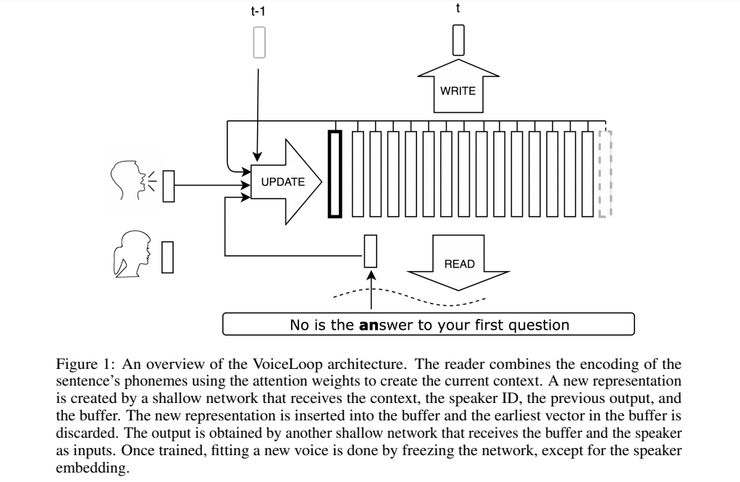

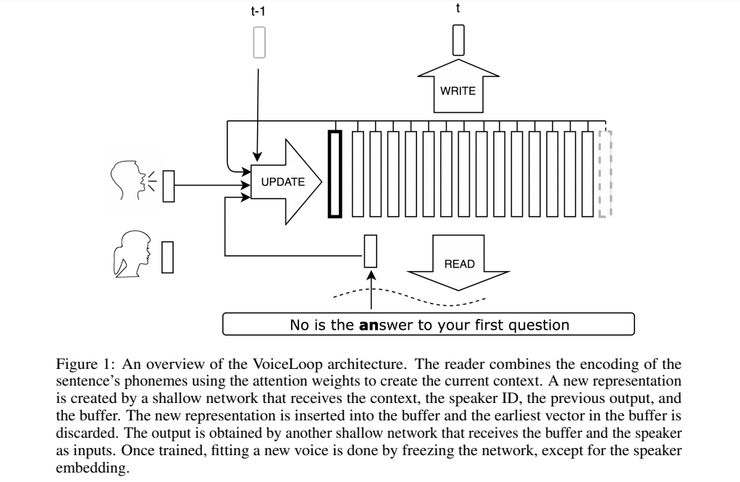

VoiceLoop的灵感来源于一种称为语音循环的工作记忆模型,它能在短时间内保存语言信息。它由两部分组成,其一是一个不断被替换的语音存储(phonological store),其二是一个在语音存储中保持长期表达(longer-term representations)的预演过程。

Voiceloop将移动缓冲区视作矩阵,从而来构造语音存储。句子表示为音素列表。然后从每个音素解码一个短向量。通过对音素的编码进行加权并在每个时间点对它们求和来生成当前的上下文向量。

使VoiceLoop脱颖而出的一些属性包括:使用内存缓冲区而不是传统的RNN,所有进程之间的内存共享,以及使用浅层、全连接的网络进行所有计算。

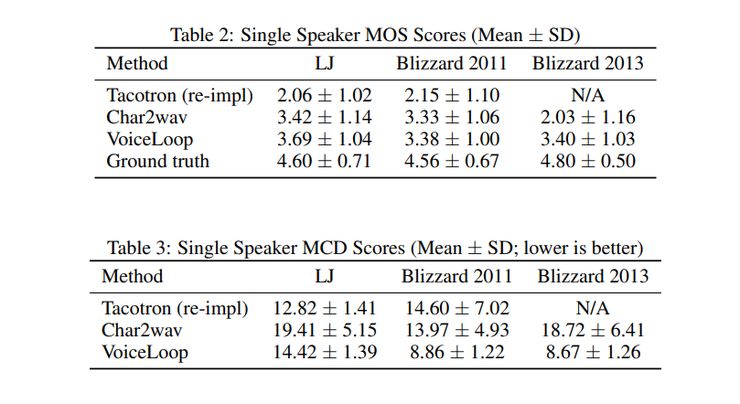

下图显示了模型与其他替代方案相比的性能表现

文章链接:https://arxiv.org/abs/1712.05884

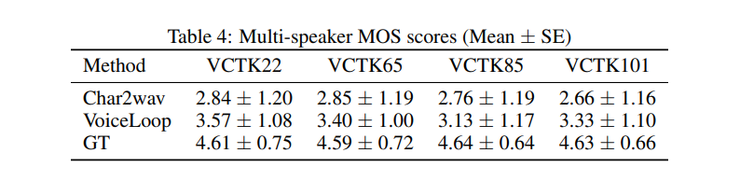

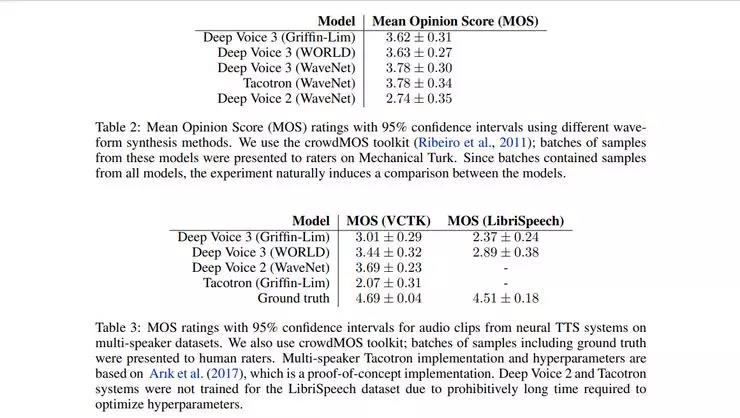

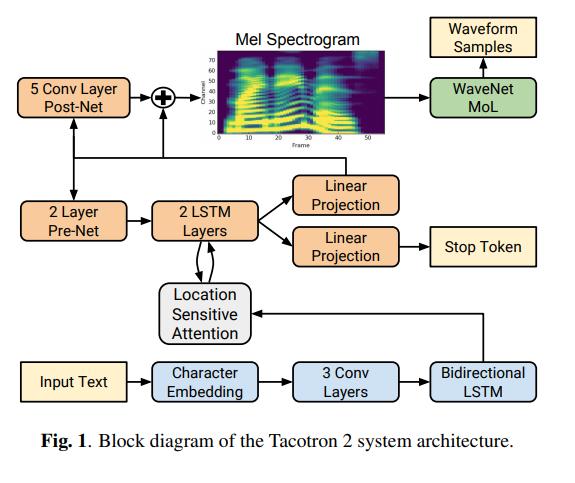

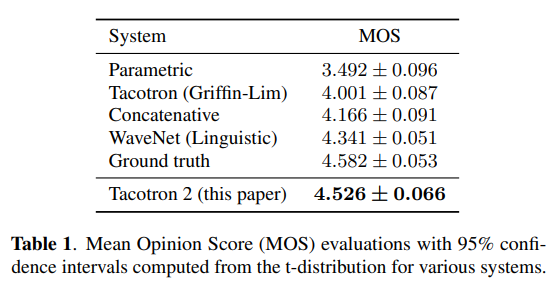

作者来自谷歌和加州大学伯克利分校。他们引入了Tacotron 2,这是一种用于文本语音合成的神经网络架构。

它由一个循环的的序列到序列特征预测网络组成,该网络将字符嵌入到梅尔标度图谱中。然后是一个修改后的WaveNet模型,这个模型充当声码器,利用频谱图来合成时域波。模型的平均意见评分(MOS)为4.53分。

这个模型结合了Tacconon和WaveNet的最佳特点。下面是它与其他模型的性能对比:

这个模型结合了Tacconon和WaveNet的最佳特点。下面是它与其他模型的性能对比:

现在的语音合成技术发展很快,我们希望能够尽快追赶上最前沿的研究。以上这几篇文章是当前语音合成领域最重要的进展代表,论文、以及其代码实现都可在网上找到,期待你能去下载下来进行测试,并能够获得期望的结果。

让我们一起创造一个丰富多彩的语音世界。

原文链接:https://heartbeat.fritz.ai/a-2019-guide-to-speech-synthesis-with-deep-learning-630afcafb9dd

Deep Voice 3: 利用卷积序列学习将文本转换为语音

文章链接:https://arxiv.org/abs/1710.07654

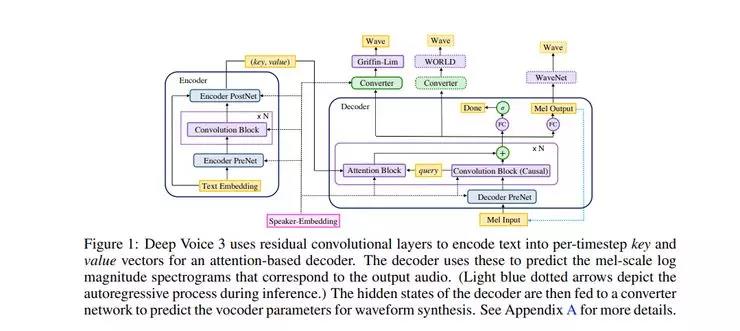

作者提出了一种全卷积字符到谱图的框架,可以实现完全并行计算。该框架是基于注意力的序列到序列模型。这个模型在LibriSpeech ASR数据集上进行训练。

这个模型的结构能够将字符、音素、重音等文本特征转换成不同的声码器参数,其中包括Mel波段光谱图、线性比例对数幅度谱图、基频谱图、谱包络图和非周期性参数。然后将这些声码器参数作为音频波形合成模型的输入。

模型的结构由以下几个部分组成:

- 编码器:一种全卷积编码器,可将文本特征转换为内部学习表示。

- 解码器:一种全卷积因果解码器,以自回归的方式解码学习表示。

- 转换器:一种全卷积后处理网络,可预测最终的声码器参数。

对于文本预处理,作者的处理方式包括:大写文本输入字符,删除标点符号,以句号或问号结束每句话,并用表示停顿长度的特殊字符替换空格。

下图是该模型与其他替代模型的性能比较。

Parallel WaveNet: 快速高保真语音合成

文章链接:https://arxiv.org/abs/1711.10433

这篇文章的作者来自谷歌。他们引入了一种叫做概率密度蒸馏的方法,它从一个训练过的WaveNet中训练一个并行前馈网络。该方法是通过结合逆自回归流(IAFS)和波形网(WaveNet)的最佳特征构建的。这些特征代表了WaveNet的有效训练和IAF网络的有效采样。

为了进行有效训练,作者使用一个已经训练过的WaveNet作为“老师”,并行WaveNet‘学生’向其学习。目的是为了让学生从老师那里学到的分布中匹配自己样本的概率。

作者还提出了额外的损失函数,以指导学生生成高质量的音频流:

- 功率损失函数:确保使用语音不同频带的功率,就像人在说话一样。

- 感知损失函数:针对这种损失函数,作者尝试了特征重构损失函数(分类器中特征图之间的欧氏距离)和风格损失函数(Gram矩阵之间的欧氏距离)。他们发现风格损失函数会产生更好的效果。

- 无论条件向量如何,对比度损失会惩罚有高可能性的波形。

下图显示了这个模型的性能:

利用小样本的神经网络语音克隆

文章链接:https://arxiv.org/abs/1802.06006v3

这篇文章的作者来自百度研究院。他们引入了一个神经语音克隆系统,它可以通过学习从少量音频样本合成一个人的声音。

系统使用的两种方法是说话人自适应和说话人编码。说话人自适应是通过对多个说话人的声音生成模型进行微调来实现的,而说话人编码则是通过训练一个单独的模型来直接推断一个新的嵌入到多个说话人语音生成模型。

本文采用Deep Voice 3作为多说话人模型的基线。所谓声音克隆,即提取一个说话人的声音特征,并根据这些特征来生成给定的文本所对应的音频。

生成音频的性能指标决定于语音的自然度和说话人声音的相似度。作者提出了一种说话人编码方法,该方法能够从未曾见过的说话人音频样本中预测说话人声音嵌入。

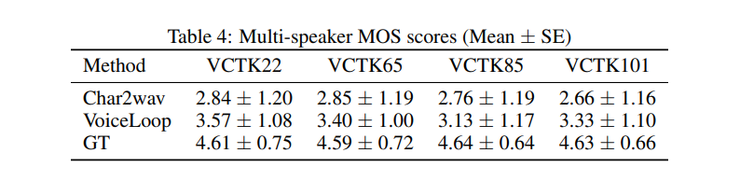

下面是声音克隆的性能:

VoiceLoop: 通过语音循环进行语音拟合与合成

文章链接:https://arxiv.org/abs/1707.06588

这篇文章的作者来自Facebook AI研究院。他们引入了一种神经文本到语音(TTS)技术,可以将文本从野外采集的声音转换为语音。

VoiceLoop的灵感来源于一种称为语音循环的工作记忆模型,它能在短时间内保存语言信息。它由两部分组成,其一是一个不断被替换的语音存储(phonological store),其二是一个在语音存储中保持长期表达(longer-term representations)的预演过程。

Voiceloop将移动缓冲区视作矩阵,从而来构造语音存储。句子表示为音素列表。然后从每个音素解码一个短向量。通过对音素的编码进行加权并在每个时间点对它们求和来生成当前的上下文向量。

使VoiceLoop脱颖而出的一些属性包括:使用内存缓冲区而不是传统的RNN,所有进程之间的内存共享,以及使用浅层、全连接的网络进行所有计算。

下图显示了模型与其他替代方案相比的性能表现

利用梅尔图谱预测上的条件WaveNet进行自然TTS合成

文章链接:https://arxiv.org/abs/1712.05884

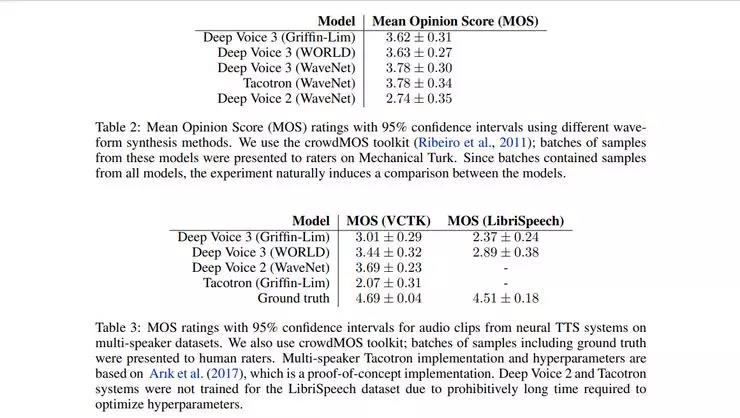

作者来自谷歌和加州大学伯克利分校。他们引入了Tacotron 2,这是一种用于文本语音合成的神经网络架构。

它由一个循环的的序列到序列特征预测网络组成,该网络将字符嵌入到梅尔标度图谱中。然后是一个修改后的WaveNet模型,这个模型充当声码器,利用频谱图来合成时域波。模型的平均意见评分(MOS)为4.53分。

这个模型结合了Tacconon和WaveNet的最佳特点。下面是它与其他模型的性能对比:

这个模型结合了Tacconon和WaveNet的最佳特点。下面是它与其他模型的性能对比:

结论:

现在的语音合成技术发展很快,我们希望能够尽快追赶上最前沿的研究。以上这几篇文章是当前语音合成领域最重要的进展代表,论文、以及其代码实现都可在网上找到,期待你能去下载下来进行测试,并能够获得期望的结果。

让我们一起创造一个丰富多彩的语音世界。

原文链接:https://heartbeat.fritz.ai/a-2019-guide-to-speech-synthesis-with-deep-learning-630afcafb9dd

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

下一篇

普适加密,一种更安全的加密技术

热门企业

热门职位

写评论取消

回复取消