谷歌的Bard现在可以编写并执行代码来回答问题

2023年06月12日 由 Camellia 发表

690946

0

谷歌表示,让一个LLM写代码类似于让人类做长除法。

像ChatGPT和Google Bard这样的大型语言模型(LLM)可以为某些类型的问题提供一些不错的答案,但讽刺的是,这些计算机在计算方面相当糟糕。谷歌有一个新的解决方案,试图让语言模型正确地完成简单的任务,如数学:让AI编写程序。谷歌表示,现在当你问一个像数学或字符串操作这样的“计算”任务时,Bard不是显示语言模型的输出,而是编写一个程序,执行该程序,然后将该程序的输出作为答案展示给用户。

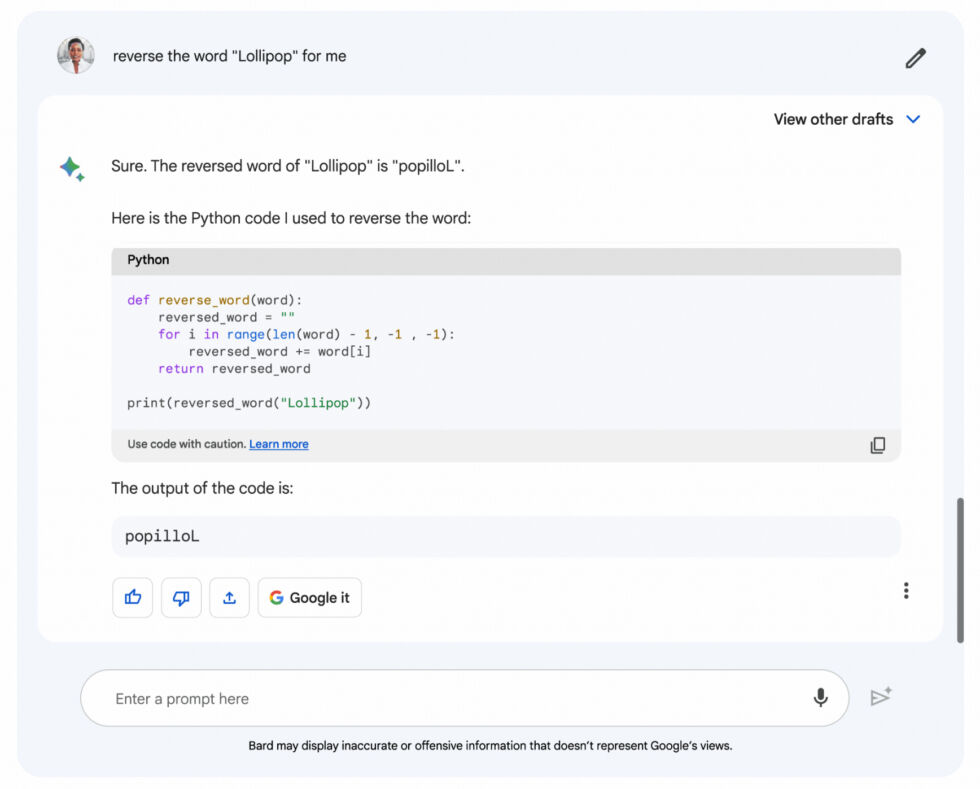

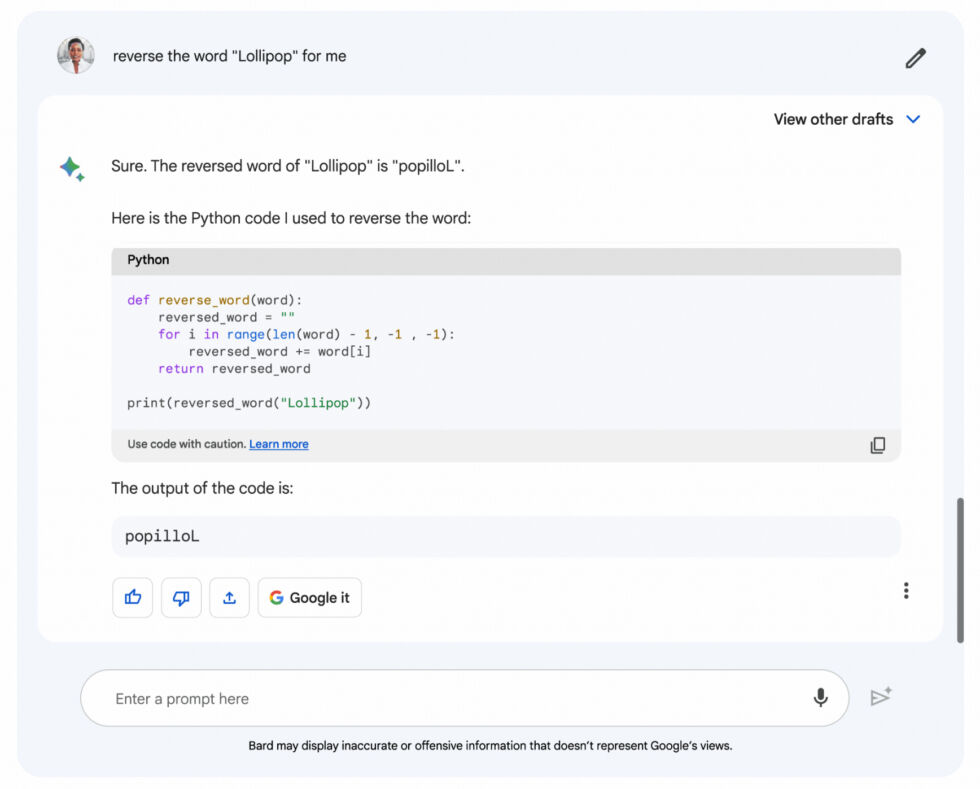

谷歌的博客文章提供了一个输入示例:“为我倒置单词‘Lollipop’”。ChatGPT没能正确回答这个问题,提供了错误的答案“pillopoL”,因为语言模型以大量的单词或“词元”的形式看待世界,它们并不擅长处理此类问题。以下是Bard的输出示例:

它得到了正确的“popilloL”输出,但更有趣的是,它还包含了它为回答这个问题而编写的python代码。这对于对编程感兴趣的人来说很有趣,但对普通人来说,这可能是最可怕的输出。而且这也不是特别相关。想象一下,当你要求Gmail获取电子邮件时,它会显示一段代码,这很奇怪。做你该做的,Bard。

谷歌将AI模型编写程序的行为比作人类做长除法,因为这是一种不同的思维模式:

这种方法的灵感来自于人类智力中一个经过深入研究的二分法,这尤其体现在Daniel Kahneman的书《思考,快与慢》中——“系统1”和“系统2”思维的分离。

系统1思维是快速、直观和毫不费力的。当爵士乐手即兴演奏或打字员考虑一个单词并看它出现在屏幕上时,他们正在使用系统1思维。

相比之下,系统2思维是缓慢、深思熟虑和费力的。当你做长除法或学习演奏乐器时,你正在使用系统2思维。

在这个类比中,LLM可以被认为是纯粹在系统1思维下运行——快速产生文本,但没有深入思考。这带来了一些惊人的能力,但在某些情况下可能会表现不足(想象一下只使用系统1思维解决数学问题——你无法停下来计算,只能选择脑海中第一个答案)。传统的计算方法更符合系统2思维:它是公式化的、不灵活的,但正确的步骤序列可以产生令人印象深刻的结果,比如长除法的解。

谷歌表示,这种“实时编写代码”的方法也将用于类似“15683615的质因数是什么?”和“计算我的储蓄增长率”的问题。该公司表示:“到目前为止,根据内部基准测试,谷歌表示,Bard对基于计算的词语和数学问题的准确性提高了约30%。”谷歌像往常一样警告道,“Bard无法正确回答问题,可能是由于错误理解您的问题,也可能是像我们所有人一样,编写了首次运行就出现错误的代码。”

来源:https://arstechnica.com/google/2023/06/googles-bard-ai-can-now-write-and-execute-code-to-answer-a-question/

像ChatGPT和Google Bard这样的大型语言模型(LLM)可以为某些类型的问题提供一些不错的答案,但讽刺的是,这些计算机在计算方面相当糟糕。谷歌有一个新的解决方案,试图让语言模型正确地完成简单的任务,如数学:让AI编写程序。谷歌表示,现在当你问一个像数学或字符串操作这样的“计算”任务时,Bard不是显示语言模型的输出,而是编写一个程序,执行该程序,然后将该程序的输出作为答案展示给用户。

谷歌的博客文章提供了一个输入示例:“为我倒置单词‘Lollipop’”。ChatGPT没能正确回答这个问题,提供了错误的答案“pillopoL”,因为语言模型以大量的单词或“词元”的形式看待世界,它们并不擅长处理此类问题。以下是Bard的输出示例:

它得到了正确的“popilloL”输出,但更有趣的是,它还包含了它为回答这个问题而编写的python代码。这对于对编程感兴趣的人来说很有趣,但对普通人来说,这可能是最可怕的输出。而且这也不是特别相关。想象一下,当你要求Gmail获取电子邮件时,它会显示一段代码,这很奇怪。做你该做的,Bard。

谷歌将AI模型编写程序的行为比作人类做长除法,因为这是一种不同的思维模式:

这种方法的灵感来自于人类智力中一个经过深入研究的二分法,这尤其体现在Daniel Kahneman的书《思考,快与慢》中——“系统1”和“系统2”思维的分离。

系统1思维是快速、直观和毫不费力的。当爵士乐手即兴演奏或打字员考虑一个单词并看它出现在屏幕上时,他们正在使用系统1思维。

相比之下,系统2思维是缓慢、深思熟虑和费力的。当你做长除法或学习演奏乐器时,你正在使用系统2思维。

在这个类比中,LLM可以被认为是纯粹在系统1思维下运行——快速产生文本,但没有深入思考。这带来了一些惊人的能力,但在某些情况下可能会表现不足(想象一下只使用系统1思维解决数学问题——你无法停下来计算,只能选择脑海中第一个答案)。传统的计算方法更符合系统2思维:它是公式化的、不灵活的,但正确的步骤序列可以产生令人印象深刻的结果,比如长除法的解。

谷歌表示,这种“实时编写代码”的方法也将用于类似“15683615的质因数是什么?”和“计算我的储蓄增长率”的问题。该公司表示:“到目前为止,根据内部基准测试,谷歌表示,Bard对基于计算的词语和数学问题的准确性提高了约30%。”谷歌像往常一样警告道,“Bard无法正确回答问题,可能是由于错误理解您的问题,也可能是像我们所有人一样,编写了首次运行就出现错误的代码。”

来源:https://arstechnica.com/google/2023/06/googles-bard-ai-can-now-write-and-execute-code-to-answer-a-question/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

下一篇

AI如何帮助VR用户避免眩晕症?

热门企业

热门职位

写评论取消

回复取消