谷歌告诉员工远离自己的Bard聊天机器人

2023年06月16日 由 Camellia 发表

991526

0

Alphabet Inc.建议员工不要将机密信息输入OpenAI的ChatGPT或谷歌自己的Bard等聊天机器人,因为担心泄露。

随着谷歌继续完善自己的AI聊天机器人Bard,其母公司Alphabet Inc.对员工有一个明确的指示:小心聊天机器人,即使是Bard。

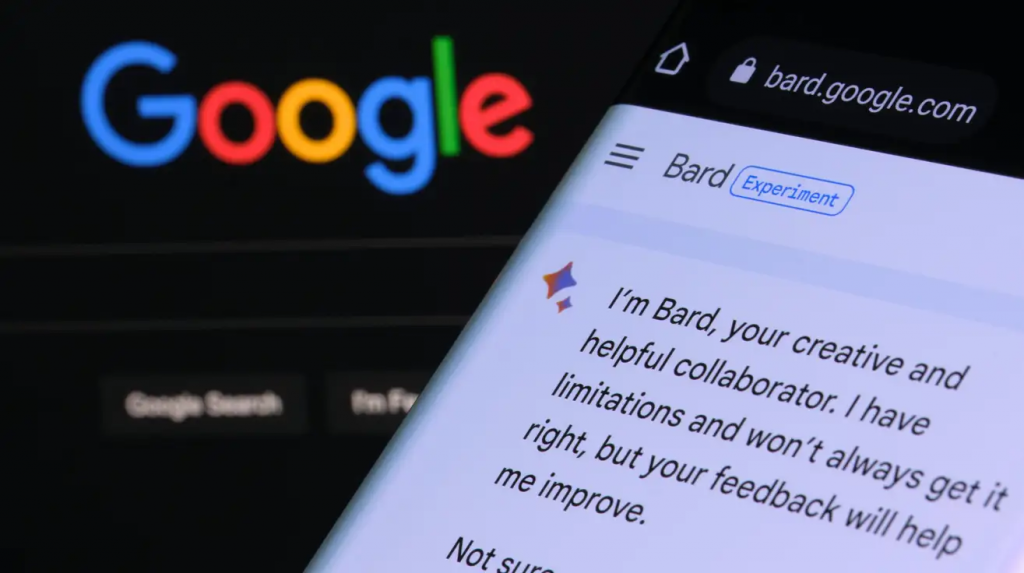

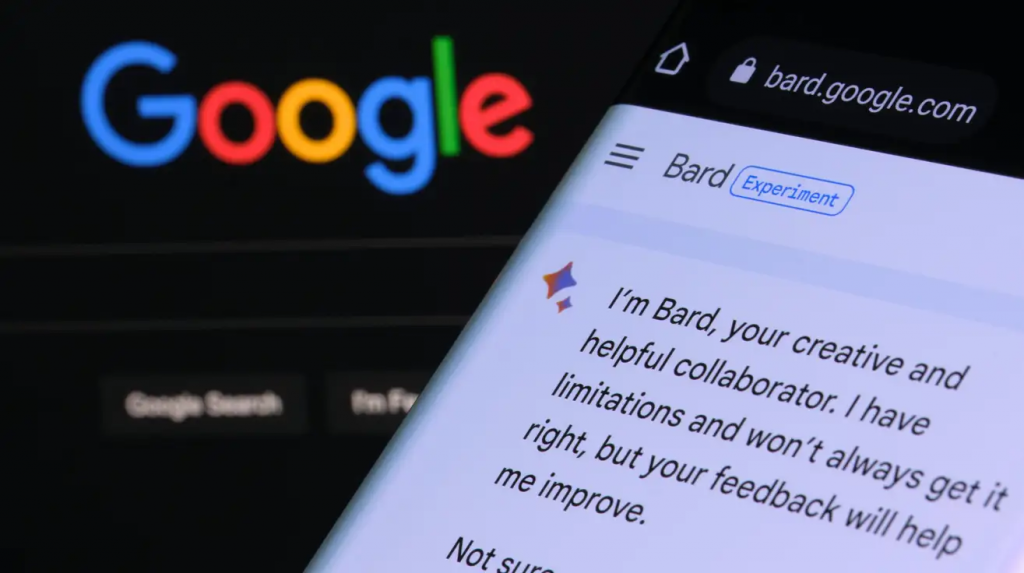

[caption id="attachment_53119" align="aligncenter" width="740"] 图片来源:Ascannio (Shutterstock)[/caption]

图片来源:Ascannio (Shutterstock)[/caption]

据四位知情人士告诉路透社,这家大型科技巨头建议员工不要将机密信息输入OpenAI的ChatGPT或谷歌自己的Bard等聊天机器人,因为担心泄露。据报道,Alphabet担心员工将敏感信息输入这些聊天机器人,因为人类审查员可能会坐在另一端审查聊天记录。这些聊天机器人也可能使用以前的记录来训练自己,这带来了另一种泄露风险。这种风险是有根据的,因为三星上个月证实,在员工使用ChatGPT后,其内部数据遭到泄露。

今年1月,一名亚马逊律师敦促该公司员工不要与ChatGPT共享代码。根据知情人查看的Slack消息截图,律师特别要求员工不要与ChatGPT分享“任何亚马逊机密信息(包括你正在编写的亚马逊代码)”。

上个月,苹果对其员工发布了类似的禁令。《华尔街日报》获得的内部文件显示,苹果禁止员工使用ChatGPT和微软旗下的AI代码编写工具GitHub Copilot。消息人士还告诉该报,苹果像科技领域的其他大公司一样,有意构建自己的大型语言模型,并在2020年分别以2亿美元和5000万美元的价格收购了两家人工智能初创公司。

谷歌在3月份发布了作为ChatGPT竞争对手的Bard。Bard是用谷歌自己的内部人工智能引擎构建的,称为对话应用语言模型(LaMDA)。Bard发布前一个多月,一份泄露的备忘录显示,谷歌首席执行官Sundar Pichai要求全公司的员工每天花费两到四个小时来测试Bard。本周,在爱尔兰监管机构提出隐私问题后,谷歌推迟了Bard在欧盟的发布。爱尔兰数据保护委员会声称,谷歌和Bard不遵守个人数据保护法。

来源:https://gizmodo.com/google-tells-employees-to-stay-away-from-its-bard-chatb-1850542824

随着谷歌继续完善自己的AI聊天机器人Bard,其母公司Alphabet Inc.对员工有一个明确的指示:小心聊天机器人,即使是Bard。

[caption id="attachment_53119" align="aligncenter" width="740"]

图片来源:Ascannio (Shutterstock)[/caption]

图片来源:Ascannio (Shutterstock)[/caption]据四位知情人士告诉路透社,这家大型科技巨头建议员工不要将机密信息输入OpenAI的ChatGPT或谷歌自己的Bard等聊天机器人,因为担心泄露。据报道,Alphabet担心员工将敏感信息输入这些聊天机器人,因为人类审查员可能会坐在另一端审查聊天记录。这些聊天机器人也可能使用以前的记录来训练自己,这带来了另一种泄露风险。这种风险是有根据的,因为三星上个月证实,在员工使用ChatGPT后,其内部数据遭到泄露。

今年1月,一名亚马逊律师敦促该公司员工不要与ChatGPT共享代码。根据知情人查看的Slack消息截图,律师特别要求员工不要与ChatGPT分享“任何亚马逊机密信息(包括你正在编写的亚马逊代码)”。

上个月,苹果对其员工发布了类似的禁令。《华尔街日报》获得的内部文件显示,苹果禁止员工使用ChatGPT和微软旗下的AI代码编写工具GitHub Copilot。消息人士还告诉该报,苹果像科技领域的其他大公司一样,有意构建自己的大型语言模型,并在2020年分别以2亿美元和5000万美元的价格收购了两家人工智能初创公司。

谷歌在3月份发布了作为ChatGPT竞争对手的Bard。Bard是用谷歌自己的内部人工智能引擎构建的,称为对话应用语言模型(LaMDA)。Bard发布前一个多月,一份泄露的备忘录显示,谷歌首席执行官Sundar Pichai要求全公司的员工每天花费两到四个小时来测试Bard。本周,在爱尔兰监管机构提出隐私问题后,谷歌推迟了Bard在欧盟的发布。爱尔兰数据保护委员会声称,谷歌和Bard不遵守个人数据保护法。

来源:https://gizmodo.com/google-tells-employees-to-stay-away-from-its-bard-chatb-1850542824

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消