Meta推出CM3LEON,一个可以生成和理解图像的神奇AI模型

2023年07月17日 由 Neo 发表

976315

0

近日,Meta分享了它最新的关于CM3leon(发音为“变色龙”)的研究,这是一个基于变换器的模型,它在文本到图像生成方面取得了最先进的结果,并展示了多模态AI的新能力。CM3leon标志着自回归模型首次在关键基准上与领先的生成扩散模型的性能相匹配。

近年来,能够从文本提示生成图像的生成式AI模型取得了快速的进步。像Midjourney、DALL-E 2和Stable Diffusion这样的模型可以从简短的文本描述中创造出逼真的场景和肖像。这些模型使用一种叫做扩散的技术——一个逐步减少图片中杂质,并逐渐使其接近期望目标的过程。虽然基于扩散的方法产生了令人印象深刻的结果,但它们的计算强度也带来了挑战,因为它们运行起来很昂贵,而且通常缺乏实时应用所需的速度。

CM3leon采用了不同的方法。作为一个基于变换器的模型,它利用注意力机制的力量来衡量输入数据(无论是文本还是图像)的相关性。这种结构上的区别使CM3leon能够实现更快的训练速度和更好的并行化,使其比传统的基于扩散的方法更有效。

CM3leon使用单个TPU pod高效地在一个许可的图像数据集上进行训练,并在MS-COCO数据集上达到了4.88的FID分数。Meta研究人员说,该模型比普通的变换器架构高效5倍以上。

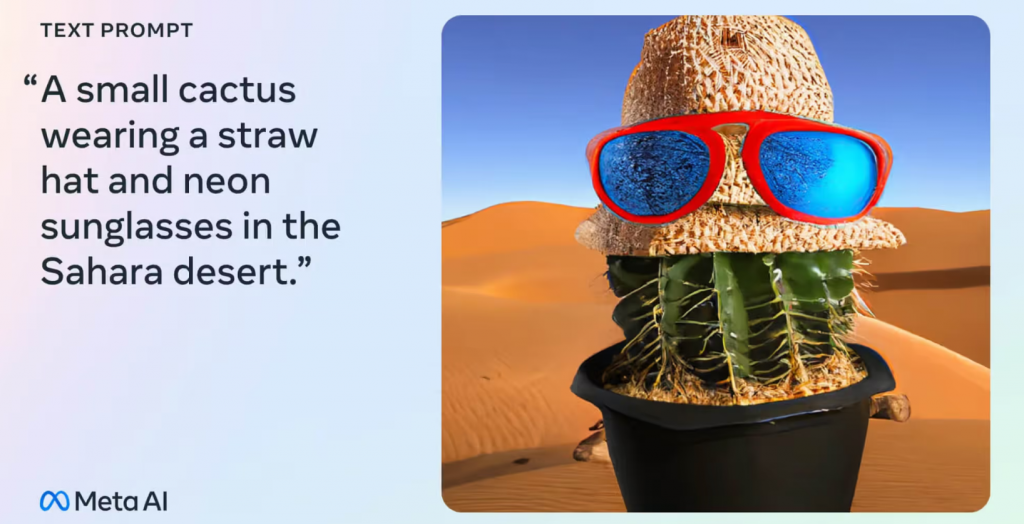

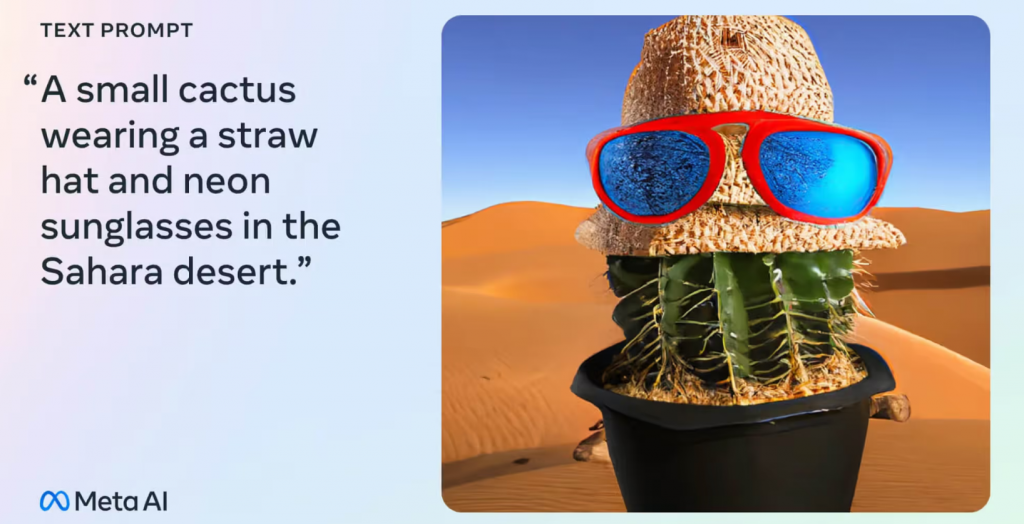

但是原始性能指标并不能完全说明问题。CM3leon真正闪耀的地方是在处理更复杂的提示和图像编辑任务。例如,CM3leon可以准确地根据一个提示如“一株小仙人掌在撒哈拉沙漠中戴着草帽和霓虹太阳镜”渲染出一个图像。

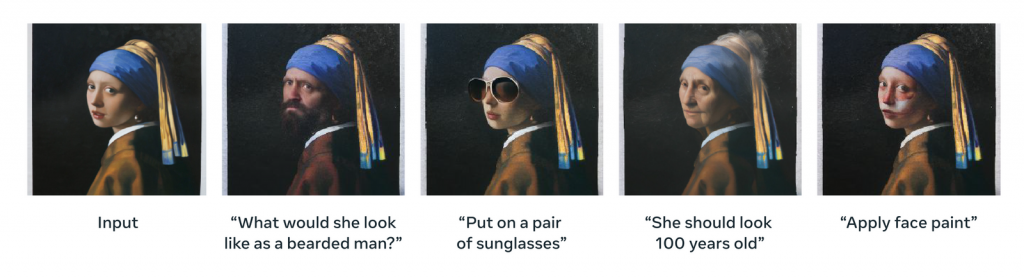

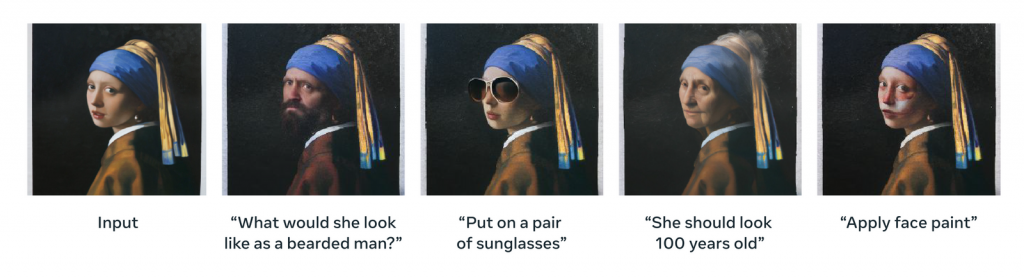

这个模型还擅长根据自由形式的文本指令对现有的图像进行编辑,比如改变天空的颜色或者在特定的位置添加物体。这些能力远远超过了目前领先的DALL-E 2模型。

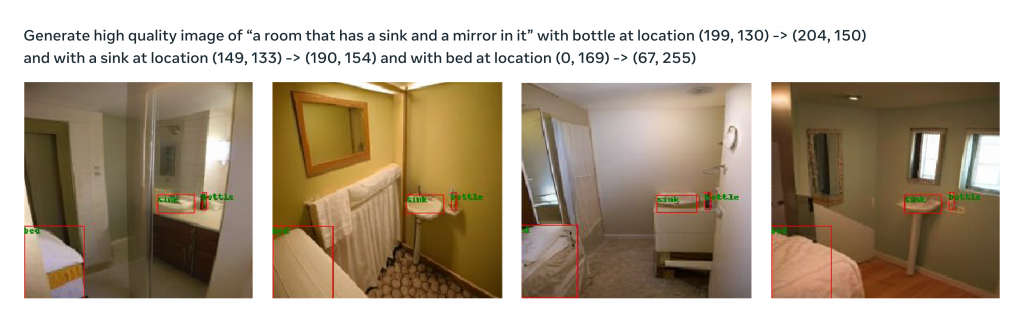

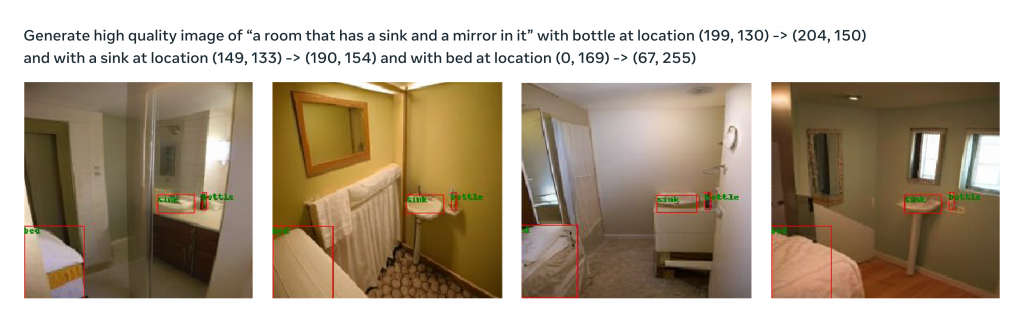

CM3leon的多功能架构使它能够在文本、图像和组合任务之间灵活地转换。除了文本到图像的生成,CM3leon 还可以为图像生成标题,回答有关图像内容的问题,甚至根据边界框和分割图的文本描述创建图像。这种将多种模态结合到一个模型中的能力,在公开披露的AI系统中是前所未有的。

给定一个描述图像边界框分割的文本,CM3leon可以生成一个图像。

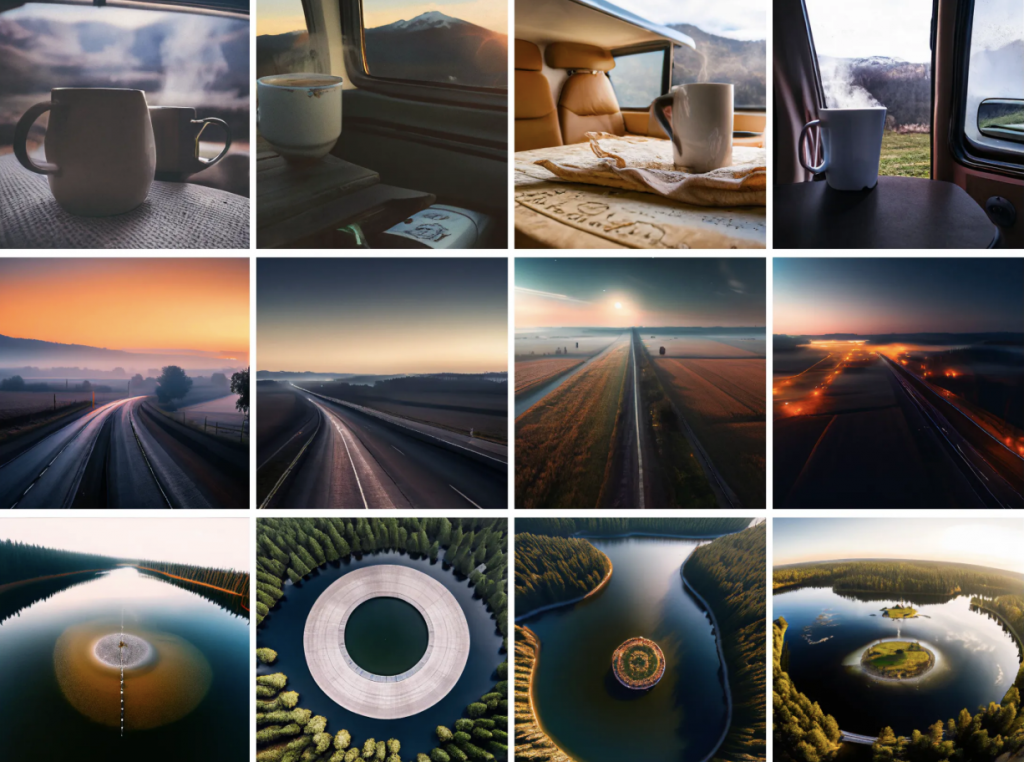

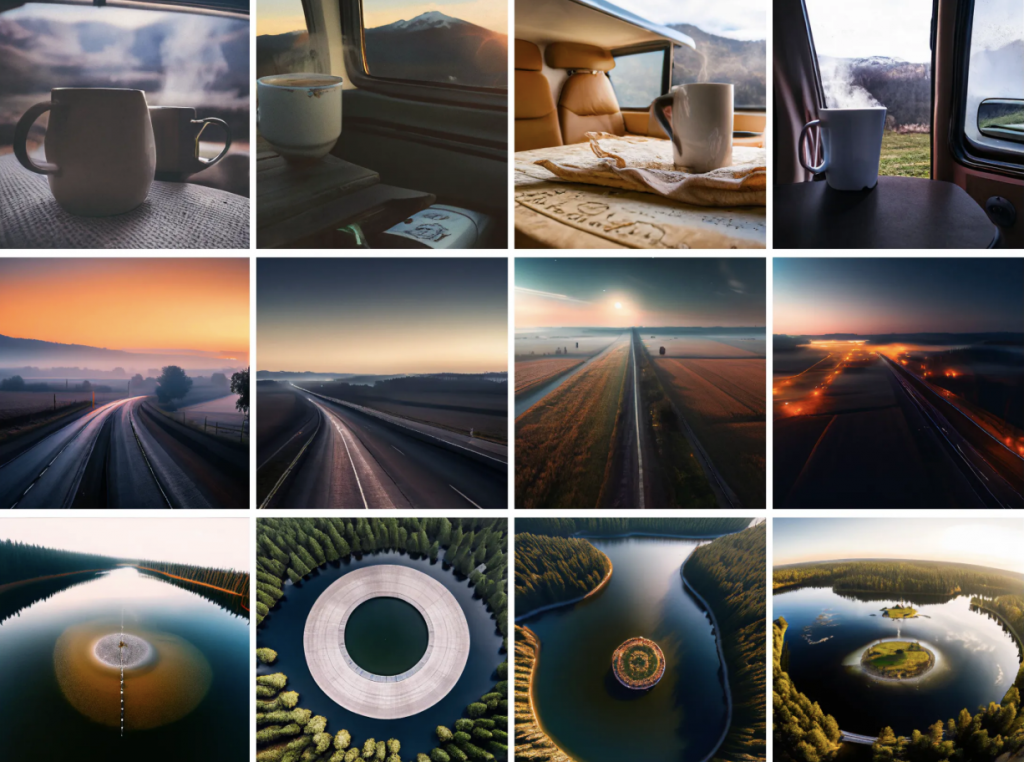

可以将一个单独的超分辨率与CM3leon的输出集成,可显著提高图片分辨率和细节。以下是四个示例图像,对应于以下四个提示:

(1)一杯冒着热气的咖啡,背景是山脉。公路旅行中休息。

(2)美丽而雄伟的日落公路。有审美感。

(3)湖中央的小圆岛。湖周围是森林。高对比度

CM3leon的成功可以归功于它独特的架构和训练方法。该模型采用了一个仅包含解码器的变换器架构,类似于已建立的基于文本的模型,但增加了处理文本和图像的能力。训练涉及检索增强,在该领域的最新工作上进行了建立,并在各种图像和文本生成任务上进行了指令微调。

通过在多种模态上应用一种称为监督微调的技术,Meta能够显著提高CM3leon在图像标题、视觉QA和基于文本的编辑方面的性能。尽管CM3leon只在30亿个文本标记上进行了训练,但它与或超过了其他在多达1000亿个标记上进行训练的模型的结果。

Meta还没有宣布公开发布CM3leon的计划。但该模型为多模态AI定义了一个新的标准,并展示了检索增强和监督微调等技术的力量。这是一个了不起的成就,指向了一个未来,即AI系统可以在理解、编辑和生成图像、视频和文本之间平滑地过渡。

来源:https://www.maginative.com/article/meta-unveils-cm3leon-a-breakthrough-ai-model-for-advanced-text-to-image-generation-and-image-understanding/

近年来,能够从文本提示生成图像的生成式AI模型取得了快速的进步。像Midjourney、DALL-E 2和Stable Diffusion这样的模型可以从简短的文本描述中创造出逼真的场景和肖像。这些模型使用一种叫做扩散的技术——一个逐步减少图片中杂质,并逐渐使其接近期望目标的过程。虽然基于扩散的方法产生了令人印象深刻的结果,但它们的计算强度也带来了挑战,因为它们运行起来很昂贵,而且通常缺乏实时应用所需的速度。

CM3leon采用了不同的方法。作为一个基于变换器的模型,它利用注意力机制的力量来衡量输入数据(无论是文本还是图像)的相关性。这种结构上的区别使CM3leon能够实现更快的训练速度和更好的并行化,使其比传统的基于扩散的方法更有效。

CM3leon使用单个TPU pod高效地在一个许可的图像数据集上进行训练,并在MS-COCO数据集上达到了4.88的FID分数。Meta研究人员说,该模型比普通的变换器架构高效5倍以上。

但是原始性能指标并不能完全说明问题。CM3leon真正闪耀的地方是在处理更复杂的提示和图像编辑任务。例如,CM3leon可以准确地根据一个提示如“一株小仙人掌在撒哈拉沙漠中戴着草帽和霓虹太阳镜”渲染出一个图像。

这个模型还擅长根据自由形式的文本指令对现有的图像进行编辑,比如改变天空的颜色或者在特定的位置添加物体。这些能力远远超过了目前领先的DALL-E 2模型。

文本引导的图像编辑

CM3leon的多功能架构使它能够在文本、图像和组合任务之间灵活地转换。除了文本到图像的生成,CM3leon 还可以为图像生成标题,回答有关图像内容的问题,甚至根据边界框和分割图的文本描述创建图像。这种将多种模态结合到一个模型中的能力,在公开披露的AI系统中是前所未有的。

物体到图像

给定一个描述图像边界框分割的文本,CM3leon可以生成一个图像。

超分辨率结果

可以将一个单独的超分辨率与CM3leon的输出集成,可显著提高图片分辨率和细节。以下是四个示例图像,对应于以下四个提示:

(1)一杯冒着热气的咖啡,背景是山脉。公路旅行中休息。

(2)美丽而雄伟的日落公路。有审美感。

(3)湖中央的小圆岛。湖周围是森林。高对比度

CM3leon的成功可以归功于它独特的架构和训练方法。该模型采用了一个仅包含解码器的变换器架构,类似于已建立的基于文本的模型,但增加了处理文本和图像的能力。训练涉及检索增强,在该领域的最新工作上进行了建立,并在各种图像和文本生成任务上进行了指令微调。

通过在多种模态上应用一种称为监督微调的技术,Meta能够显著提高CM3leon在图像标题、视觉QA和基于文本的编辑方面的性能。尽管CM3leon只在30亿个文本标记上进行了训练,但它与或超过了其他在多达1000亿个标记上进行训练的模型的结果。

Meta还没有宣布公开发布CM3leon的计划。但该模型为多模态AI定义了一个新的标准,并展示了检索增强和监督微调等技术的力量。这是一个了不起的成就,指向了一个未来,即AI系统可以在理解、编辑和生成图像、视频和文本之间平滑地过渡。

来源:https://www.maginative.com/article/meta-unveils-cm3leon-a-breakthrough-ai-model-for-advanced-text-to-image-generation-and-image-understanding/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消