降低人工智能成本的方法收效甚微

人工智能在我们生活的几乎所有方面都有巨大的发展前景,从医学到教育,从工业到金融。

但这是有代价的。OpenAI首席执行官Sam Altman表示,为了训练GPT-4, OpenAI不得不斥资1亿美元。

尽管一些聊天机器人是免费提供的,但据Accubits的一篇博客称,寻求创建聊天机器人服务的小企业需要支付约4000美元。根据人工智能公司Figure Eight的数据,为机器学习创建一个数据集,每项任务的成本可能高达100美元。此外,斯坦福大学的一项研究发现,为机器学习标记单个图像数据集的成本为每张图像3.50美元。所需云计算平台的租金最高可达每小时5美元。

因此,控制成本是潜在用户关注的问题。

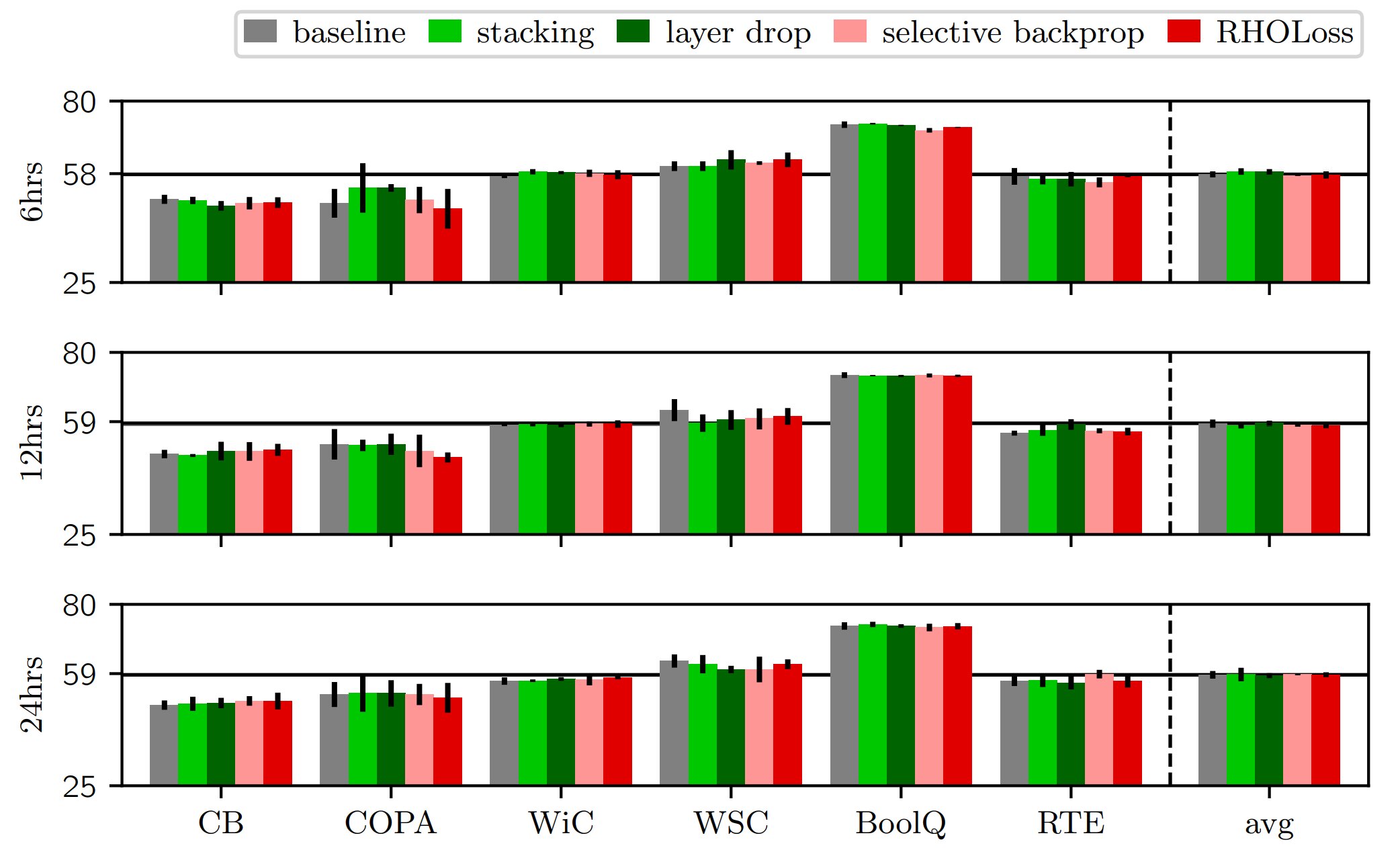

伦敦大学学院(University College London)和爱丁堡大学(University of Edinburgh)的研究人员设计了一种测量系统,将标准机器学习方法的结果与公司认为可以节省成本的替代方法的结果进行比较。他们发现,替代机器训练方法的效果微乎其微。

他们对三大类效率模型的几种变体进行了研究。

“在大多数情况下,在我们的实验中,这些使用的方法往往相当复杂,需要更多的实施努力,所以并没有真正带来显著的改善,”该报告的合著者伦敦大学学院的Oscar Key说。

该团队研究了三个类别:

1、批处理选择,是指处理数据位组而不是单个组件。一个简单的例子是在大量数码照片的文件名后面加上一个单词,以便更清楚地识别它们。批处理可以一次重命名它们,比逐个更改名称更快,也更便宜。

2、层堆叠,是利用多层神经网络单元依次处理数据的方法。它允许模型学习复杂的语言模式和关系。例如,模型使用堆叠来识别语言输入中的语法、语义和情感,并可以实时形成相应的输出。风格、语气和声音根据不同神经网络层的提示进行修改。

3、高效优化器,顾名思义,是一种旨在加速搜索功能,最小化浪费操作,并在理想情况下获得更好解决方案的算法。研究人员使用了相对较新的Sophia优化器,据说它比更常用的Adam优化器快两倍。

尽管这些方法成功地跳过了不相关的数据,忽略了不相关的数据,并优化了有用的和相关的数据,但这些方法导致了较差的输出。

根据该报告,层堆叠是唯一能够产生“训练和验证”收益的过程,尽管很小。但训练时间变长,这种效果就会“消失”。

换句话说,机器学习的优化可能使用更少的计算能力,成本更低,但结果较差,只能通过额外的训练和成本来提高。

该报告的另一位作者Jean Kaddour说:“训练模型达到理想的性能通常是非常昂贵的。”

这份题为“No Train No Gain: Revisitt Efficient Train Algorithm for Transformer-based Language Models”的报告发布在arXiv预印本服务器上。