人们认为人工智能助手应该对结果负责

一项新的研究表明,即使人类将基于人工智能的助手纯粹视为工具,他们也会将决策的部分责任归咎于它们。

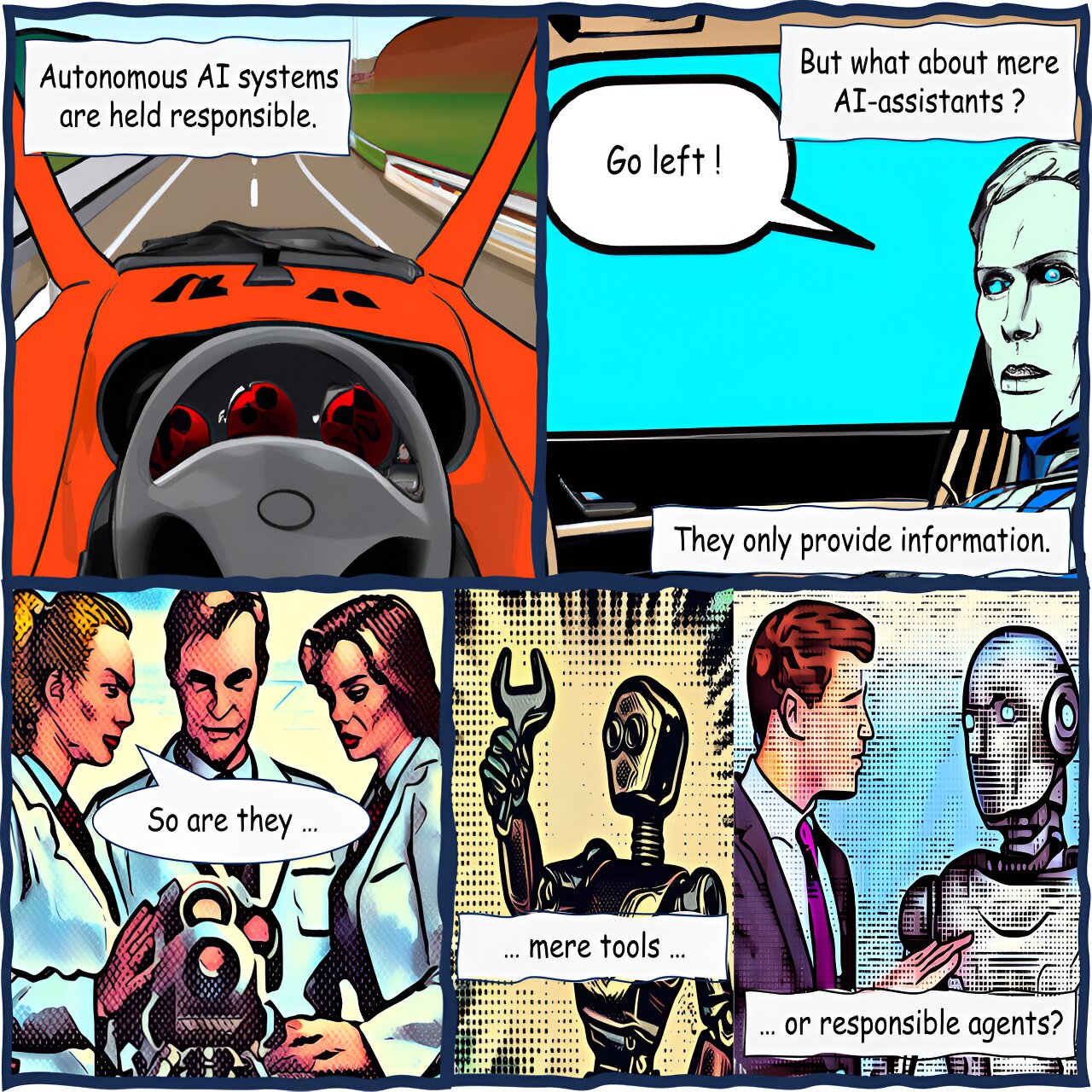

未来基于人工智能的系统可能会在没有人工输入的情况下引导自动驾驶汽车进行驾驶。研究表明,人们认为这种未来的人工智能系统在做出自主交通决策时与人类一样负责任。然而,现实生活中的人工智能助手离这种自主性还很远。它们为人类用户提供导航和驾驶辅助等辅助信息。

那么,在现实生活中,当出现问题时,谁应该负责呢?人类用户?或者人工智能助手?由心理哲学主席Louis Longin领导的一个团队现在调查了人们在这些情况下是如何评估责任的。他们的研究结果发表在iScience杂志上。

“我们口袋里都有智能助手,”Longin说。“然而,我们掌握的大多关于责任的实验证据都集中在机器人或自动驾驶汽车领域,在这些领域,人工智能实际上是坐在驾驶座上,替我们做决定的。但是在仍然由人做最终决定的的情况下,人工智能则更像是一个复杂的工具。”

专门研究人类与人工智能互动的哲学家Longin与同事Bahador Bahrami博士和心灵哲学主席Ophelia Deroy教授合作,调查了940名参与者关于使用智能人工智能语音助手、智能人工智能触觉助手或非人工智能导航仪器的人类司机的看法,他们是否认为导航辅助设备应该负责任,以及人工智能助手在多大程度上是一种工具。

智能助手的矛盾状态

研究结果揭示了一种矛盾的心理:参与者强烈主张智能助手只是工具,但他们认为智能助手对使用它们的人类司机的错误负有部分责任。对于非人工智能驱动的仪器,则没有这种责任划分。

同样让作者感到惊讶的是,“人们可能会用不同的道德标准来评价赞扬和谴责。当危机得以避免且没有造成伤害时,标准就会放松,这使得人们更容易把功劳归到非人类系统身上,而不是归咎于它,”

语言的作用无关紧要

在这项研究中,作者发现使用语言的智能助手和那些通过触觉震动来警告用户的智能助手没有区别。

Ophelia Deroy说:“在这种情况下,两者提供了相同的信息,‘嘿,小心,前方有东西’,但当然,ChatGPT在实践中提供了更多的信息。”她的研究显示出我们对人工智能的矛盾态度。关于像ChatGPT这样的新型基于语言的AI系统提供的额外信息,Deroy补充说:“互动越丰富,就越容易人格化。”

“总而言之,我们的研究结果支持这样一种观点,即人工智能助手不仅仅被视为工具,但仍远未达到人类的水平,”Longin说。

作者认为,这项新研究的发现将对人工智能助手的设计和社会话语产生深远的影响:“开发和发布智能助手的组织应该考虑如何影响社会和道德规范,”Longin总结道。