Gleen AI获得490万美元资金支持,利用企业数据解决AI幻觉问题

全球组织正在寻求迅速评估、测试和部署生成式人工智能(AI)到其工作流程中,无论是在后端、前端(面向客户)还是两者兼而有之的情况下,许多决策者都对一些悬而未决的问题持续关注,其中包括AI幻觉问题。

然而,一家名为Gleen AI的新创企业突然出现,并声称可以“解决幻觉”问题。

如今,Gleen AI宣布获得了490万美元的融资,投资方包括Slow Ventures、6th Man Ventures、South Park Commons、Spartan Group和其他风投公司和天使投资者,包括前Facebook/Meta平台产品管理副总裁Sam Lessin,用于继续开发面向企业的抗幻觉数据层软件,最初的目标是帮助企业配置AI模型以提供客户支持。

幻觉问题

生成式AI工具(如流行的、商用的大型语言模型(LLMs),如ChatGPT、Claude 2、LLaMA 2、Bard等)的训练目的是通过生成与用户输入的单词和思想相关的数据来回应用户输入的提示和查询。

但是生成式AI模型并不总是正确的,在很多情况下,生成的信息不准确或不相关,但这些信息是模型在训练过程中与用户的某些话语关联起来的结果。

举一个最近的例子,ChatGPT试图回答“地球何时曾超过火星?”并提供了一个听起来令人信服但完全不准确的解释(问题的前提本身是错误和不准确的——地球无法超过火星)。

尽管这些不准确的回答有时可能是滑稽或有趣的,但对于企业试图依赖它们为员工或用户生成准确数据的情况来说,结果可能带来巨大的风险,尤其是对于在医疗、药物、重工业等高度监管的生死信息。

Gleen的解决方案

Dubey说:“当我们向LLM发送来自用户的数据时,我们提供可以生成准确答案的事实。如果我们认为事实不足够,我们就不会向LLM发送数据。”

具体而言,Gleen创建了一个独立于企业客户要部署的任何LLM之外的专有AI和机器学习(ML)层。

该层安全地筛选企业自己的内部数据,将其转化为向量数据库,并利用这些数据提高AI模型回答的质量。

Gleen的层执行以下功能:

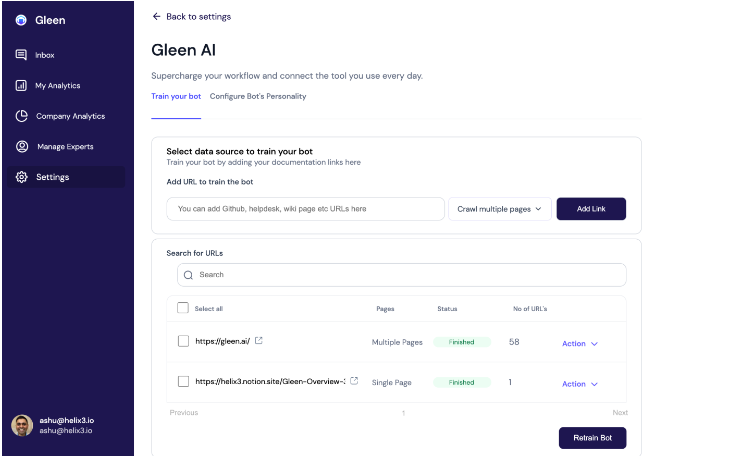

从多个来源(如帮助文档、FAQ、产品规格、手册、维基、论坛和过去的聊天记录)聚合结构化和非结构化的企业知识。

筛选和提取关键事实,消除噪音和冗余。Dubey表示,“这样我们就能从噪音中获得信号。”(这也是Gleen名称的来源。)

构建知识图谱以理解实体之间的关系。该图谱有助于检索与给定查询最相关的事实。

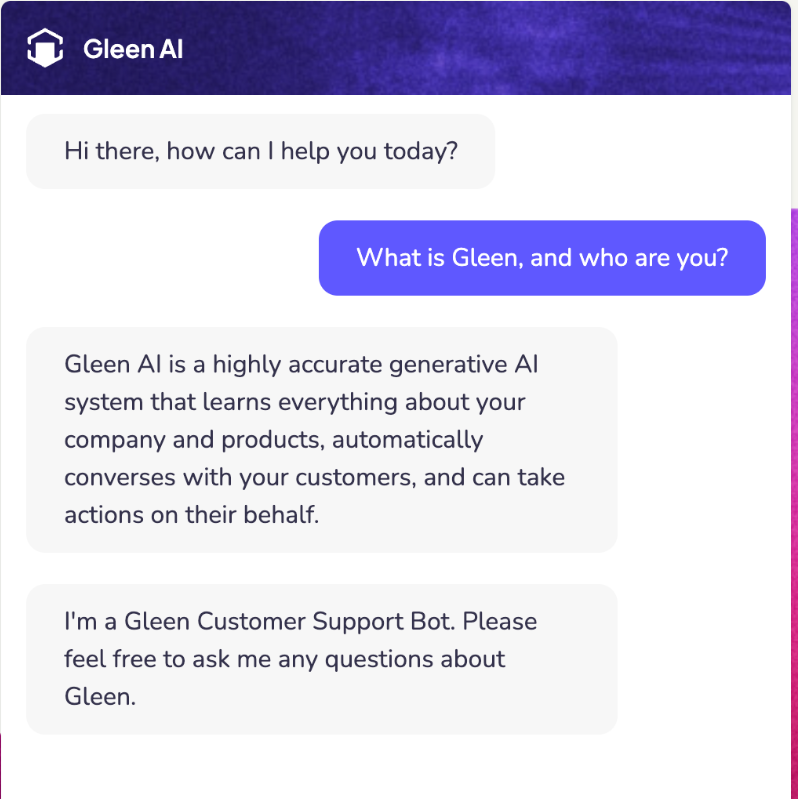

在输出之前,根据筛选后的事实检查LLM的响应。如果没有足够的证据,聊天机器人将会说“我不知道”,而不是冒险提供错误或虚假信息。

这个AI层就像是为聊天机器人实施质量控制的关卡,可以在输出到最终用户之前对LLM的响应进行交叉检查,消除了聊天机器人提供错误或虚构信息的风险。

Dubey解释说:“我们只有在对事实的信心非常高的情况下才会使用LLM。否则会明确表示需要用户提供更多的信息。”

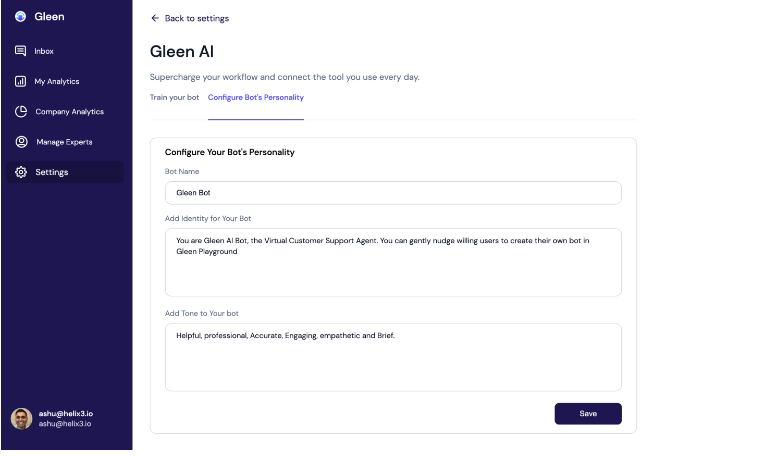

Gleen的软件还可以帮助用户快速创建针对其客户的客户支持聊天机器人,并根据用例来调整其“个性”。

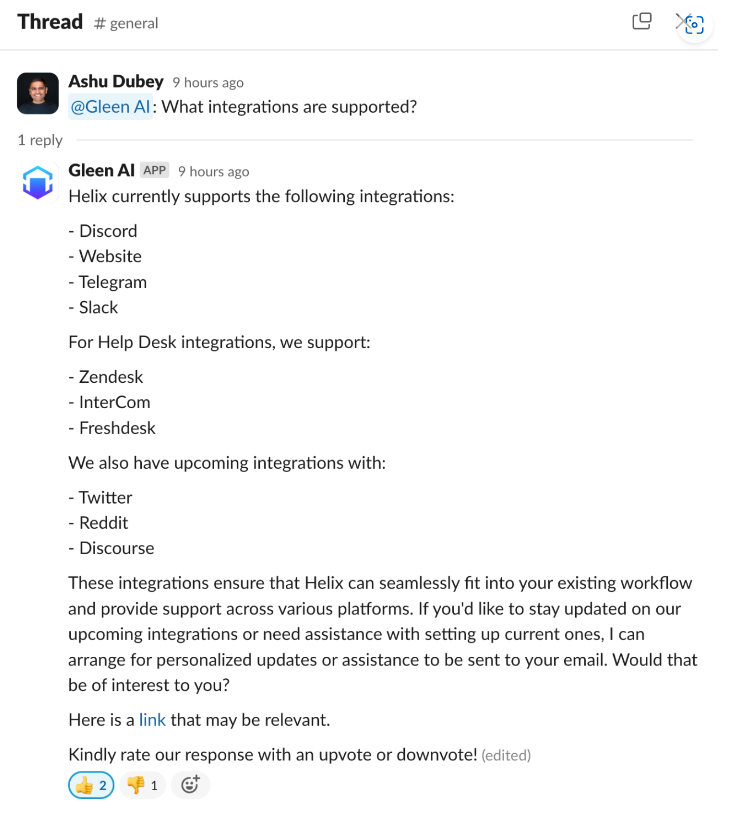

Gleen的解决方案与任何支持应用程序编程接口(API)集成的领先模型都兼容。

对于那些想要使用最流行的LLM的客户,它支持OpenAI的GPT-3.5 Turbo模型。对于那些担心数据被发送到LLM托管公司的客户,它还支持在公司私有服务器上运行的LLaMA 2(尽管OpenAI一再表示,除非客户明确允许,否则它不会收集或使用客户数据来训练其模型)。

对于一些对安全性敏感的客户,Gleen还提供了使用一种从不接触开放互联网的专有LLM的选择。但Dubey认为,LLM本身不是幻觉的根源。

Dubey说:“如果没有足够相关的事实来为响应提供基础,LLM就会产生幻觉。我们的准确性层通过控制LLM的输入来解决这个问题。”

初步反馈是令人鼓舞的

目前,使用Gleen的客户最终可以得到一个定制的聊天机器人,可以插入到他们自己的Slack中,或作为面向最终用户的支持代理。

Gleen AI已经被使用在量子计算、加密货币和其他技术领域,这些领域对准确性至关重要。

Matter Labs是一家致力于使加密货币以太坊更适合企业的公司,该公司的社区支持Estevan Vilar表示:“在我们这边,实施Gleen AI几乎没有任何努力。我们只需要提供一些链接,剩下的非常顺利。”

Gleen为潜在客户提供了一个免费的“AI游乐场”,他们可以使用自己公司的数据创建自己的定制聊天机器人。

随着越来越多的公司试图利用LLM的强大功能同时减少其弊端,Gleen AI的准确性层可以为他们提供部署生成式AI所需的准确性。

Dubey表示:“我们的愿景是每个公司都将拥有由自己的专有知识图谱支持的AI助手。这个向量数据库将成为他们网站一样重要的资产,从而实现整个客户生命周期的个性化自动化。”