Adept AI开源大语言模型Persimmon-8B

总部位于旧金山的人工智能初创公司Adept最近宣布开源发布Persimmon-8B,这是他们的一种具有83亿参数的新语言模型。Persimmon-8B是目前在100亿参数以下最强大的完全开源的人工智能模型。

Persimmon-8B拥有一系列使其在同类产品中脱颖而出的功能。该模型设计灵活,发布时遵循Apache许可证,并且是参数低于100亿时最强大的完全符合许可的语言模型。

其中最引人注目的一个方面是它的上下文大小为16K,是LLaMA2的4倍,也是像GPT-3这样着名模型的8倍。这种增加的上下文大小使得Persimmon-8B能够更加连贯和适用地理解和生成文字,在广泛的用例中发挥作用。尽管训练数据仅占其最接近的竞争对手LLaMA2的37%,但Persimmon-8B的性能是可比较的,表明其具有高效性。

8B的大小对于大多数无计算机大规模计算能力的用户来说非常适用——它们可以在单个GPU上进行微调,在现代MacBook上以较快的速度运行,并且甚至可能适应移动设备。

Persimmon-8B代表了Adept模型扩展计划的早期成果,该计划将支持该公司未来的人工智能产品。Adept的目标是开发一种人工智能代理,以协助人们完成各种计算机任务。

除了模型之外,Adept还发布了定制的高速推断代码,速度与优化的C++实现(如NVIDIA的FasterTransformer)相当,并保留了PyTorch的灵活性。这一创新可能会显著加快应用程序的开发速度。

该公告还涉及了评估语言模型的复杂性,并讨论了常用方法的局限性,这些方法专注于内部知识而不是交互能力。Adept强调他们使用直接答案生成进行评估,更接近用户与语言模型交互的方式。

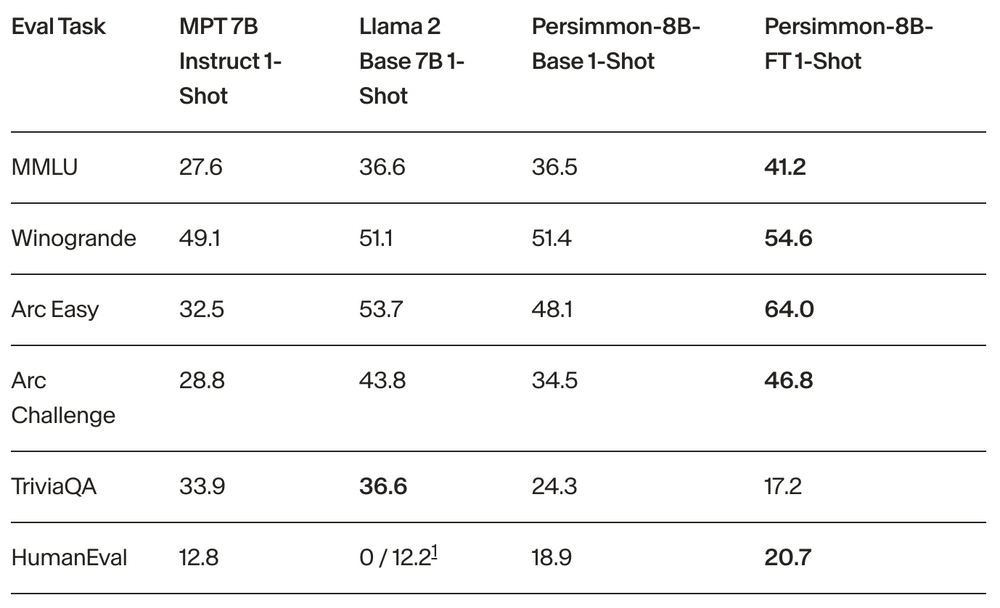

Persimmon-8B在热门人工智能基准测试(如Winogrande、HellaSwag和ARC)上的性能表现超过其他模型的初步测试。Adept注意到,Adept提醒说,作为原始模型发布,尚未采取任何措施来控制有害输出。

此次发布是Adept未来几个月战略的一部分。通过向公众提供这个强大而灵活的语言模型,Adept希望在人工智能领域推动更大的创新。

鉴于其功能和能力,可以肯定这个模型将成为不少突破性应用和研究的基石。Persimmon-8B的代码、权重和文档现已在Adept的GitHub上可用。