Deci开源基础模型,超越Meta的LLaMA和Stable Diffusion

DeepMind日前推出了其生成式AI基础模型,其性能比Meta的算法高出了惊人的15倍。DeciDiffusion、DeciLM 6B以及其新的推理软件开发工具包(SDK)正在为生成式AI领域的性能和成本效益设定新的标准。与闭源API模型不同,Deci提供对其模型的无限制访问权限,可以在任何地方自主托管。

生成式AI模型的训练和推理所需的计算要求妨碍了团队以具有成本效益的方式启动和扩展生成式AI应用。这家总部位于以色列的公司通过最新发布的产品直接解决了这一难题,使推理的扩展变得高效、具有成本效益,并且适用于企业级集成。

更好和更准确

通过使用Deci的开源模型和Infery LLM,AI研究人员可以将推理计算成本降低高达80%。他们可以使用已经存在且广泛可用的GPU,如NVIDIA A10。Deci的模型适用于各种应用,包括内容和代码生成、图像创建和聊天应用等等。

其中一个模型,“DeciDiffusion 1.0”,是一个高速的文本到图像模型。它可以在不到一秒的时间内生成高质量的图像,其性能超过竞争对手的Stable Diffusion 1.5模型三倍。

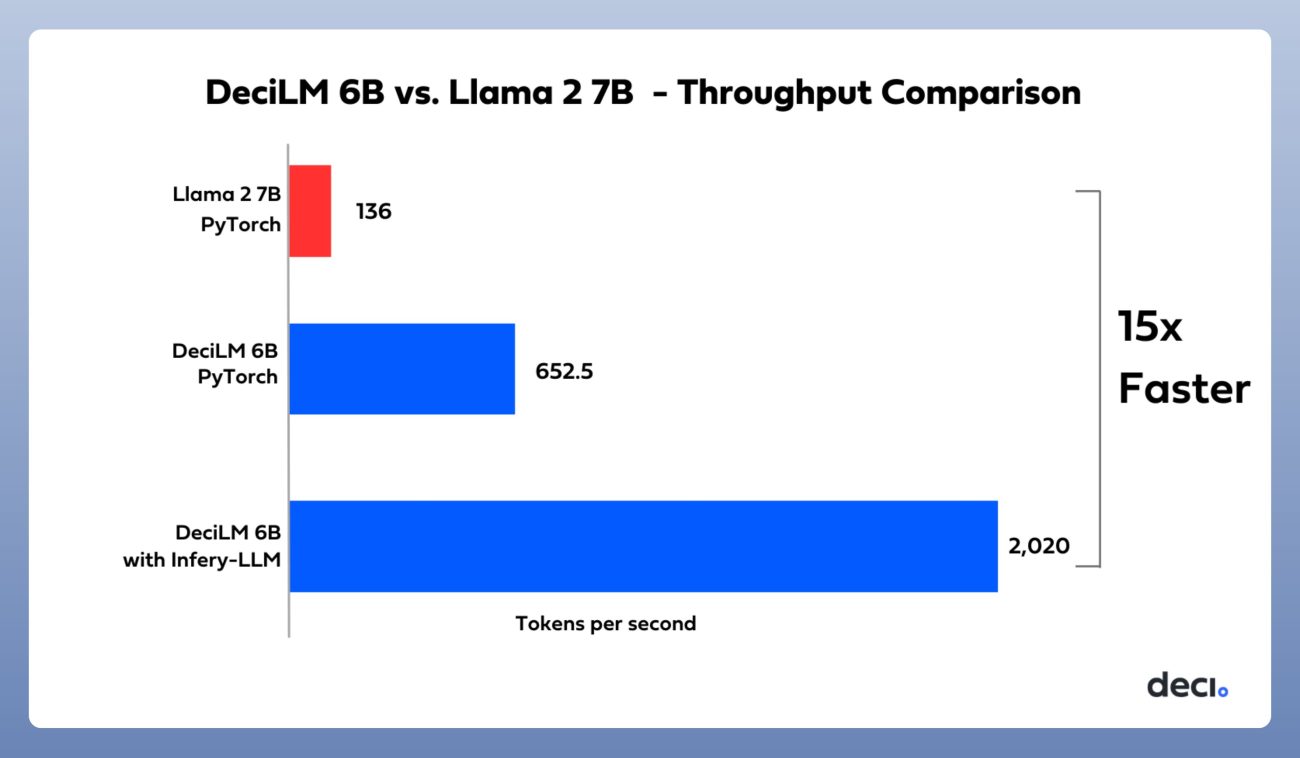

拥有57亿个参数的DeciLM 6B以其高速的推理速度脱颖而出,比Meta LLaMA 2 7B快15倍。此外还有“DeciCoder”,一个拥有10亿个参数的代码生成LLM,不仅具有出色的推理速度,而且还保持或超过了准确性标准。

Deci的首席执行官兼联合创始人Yonatan Geifman强调了在生成式AI领域中对模型质量、推理过程和成本的掌控的必要性。

这些模型是使用Deci专有的神经架构搜索(AutoNAC)技术打造的。除了基础模型之外,Deci还推出了Infery LLM - 一款推理SDK,使开发人员能够在保持所需准确性的同时显著提高现有LLM的性能。

Deci的首席科学家兼联合创始人Ran El Yaniv教授表示:“通过Deci的解决方案,公司不仅获得企业级的质量和控制能力,还能根据自己的需求灵活定制模型和推理过程。”

“DeciLM-6B已经树立了一个新的黄金标准,其吞吐量比Llama 2 7B惊人地高出15倍。这一成就归功于Deci的尖端神经架构搜索引擎AutoNAC。”TomTom的首席数据科学家Akshay Pacchar在推特上表示。