消除幻觉:验证链减少LLM的研究

2023年10月13日 由 alex 发表

386

0

LLM 生成的高度可信且令人信服但事实上不正确的信息被称为幻觉。虽然在消除幻觉方面已经取得了显著进展,但从LLM的角度来看,可以将其视为一个未解决的问题。

各种提示引擎技术展示了LLM在提示有效性方面的灵活性。

CoVe方法再次展示了LLMs能够对自己的回答进行思考并纠正错误的能力。

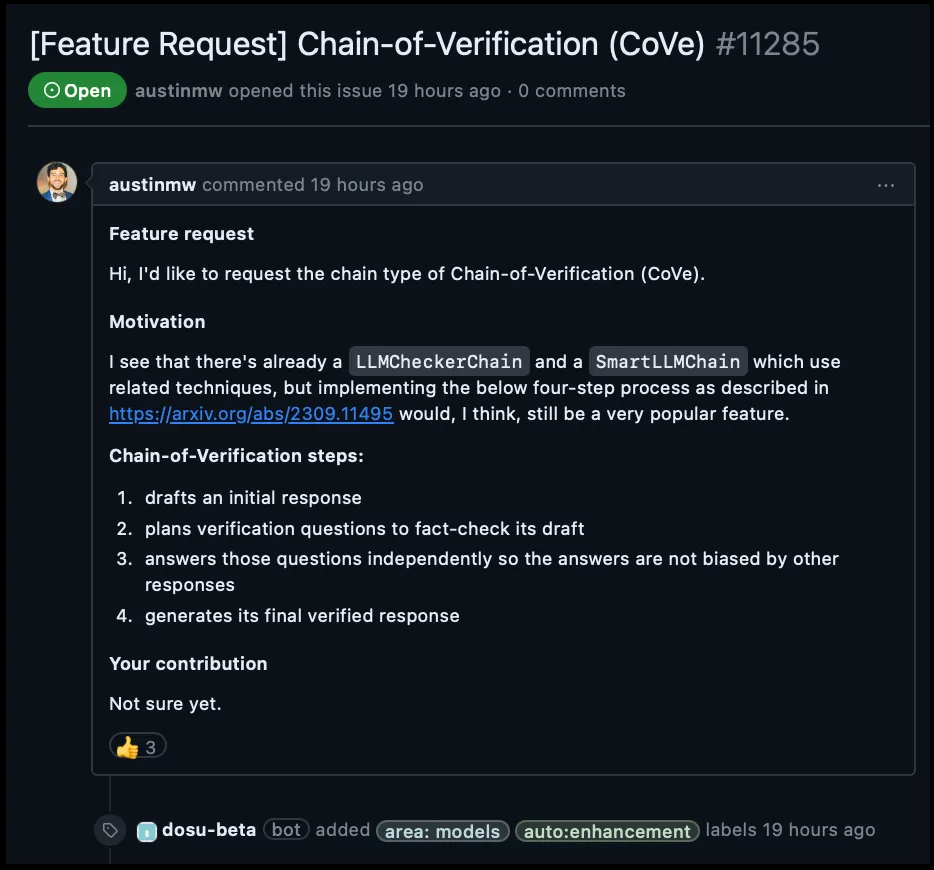

以下是CoVe的一个基本实现的操场示例,该系统的描述是:回答以下问题:然后要求LLM列出在纽约出生的政治家(1)。

返回一个姓名列表(2),使用的模型是gpt-3.5-turbo。尽管我们不知道,但其中一些姓名是错误的,不应该包含在列表中。

真正有见地的是,当逐个查询这些姓名(3,4)时,LLM会生成正确的答案。

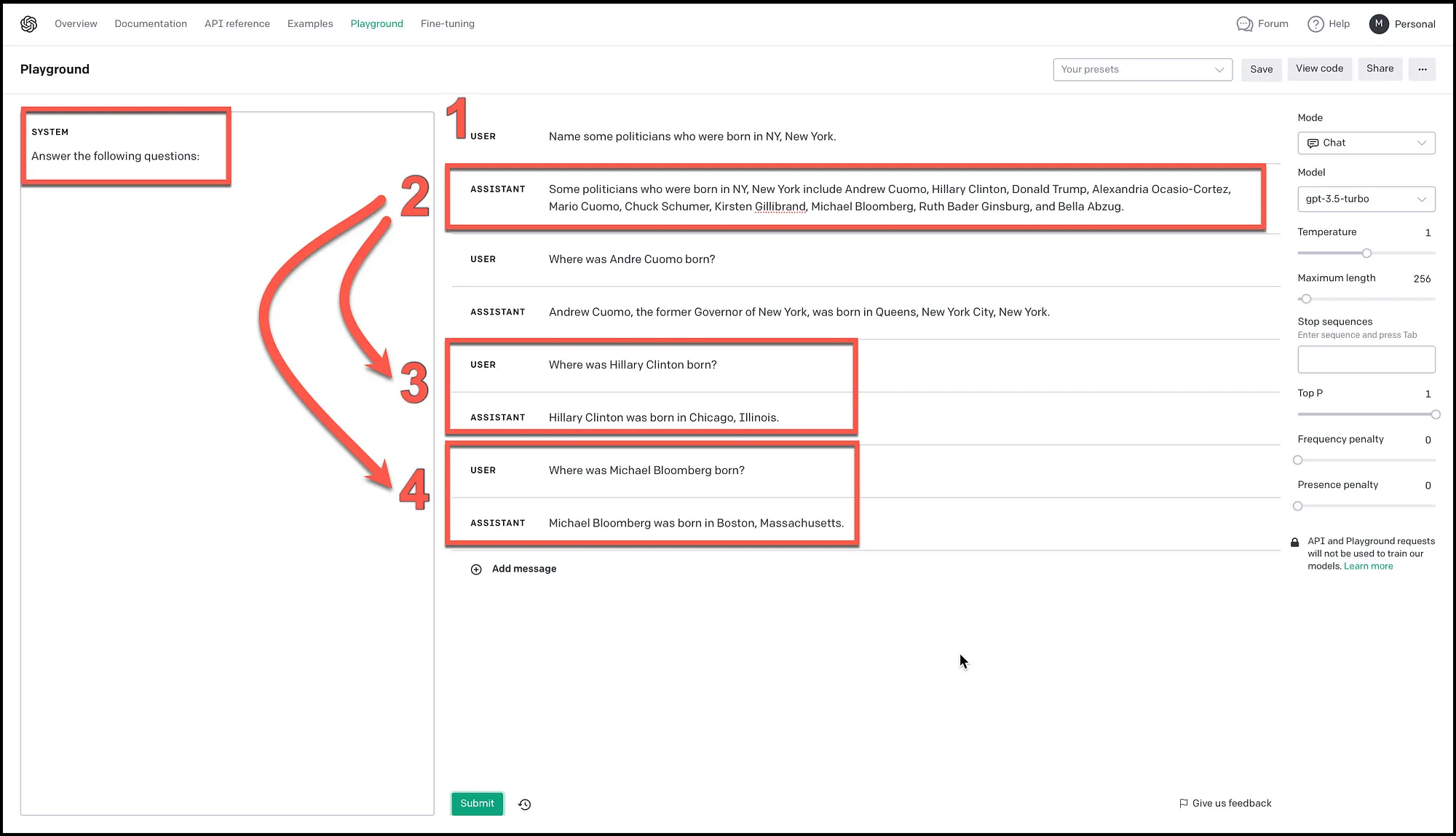

考虑下图,CoVe 的四个步骤在游乐场中展示,其中(1)是初始查询,(2)是基准响应。基准响应在大多数情况下都会被使用,从而引发了级联应用中的级联现象。

基准响应之后使用相同的LLM进行计划验证(3),计划验证用于检查查询生成的答案。然后可以基于基准响应的结果创建最终验证过的响应(4)。

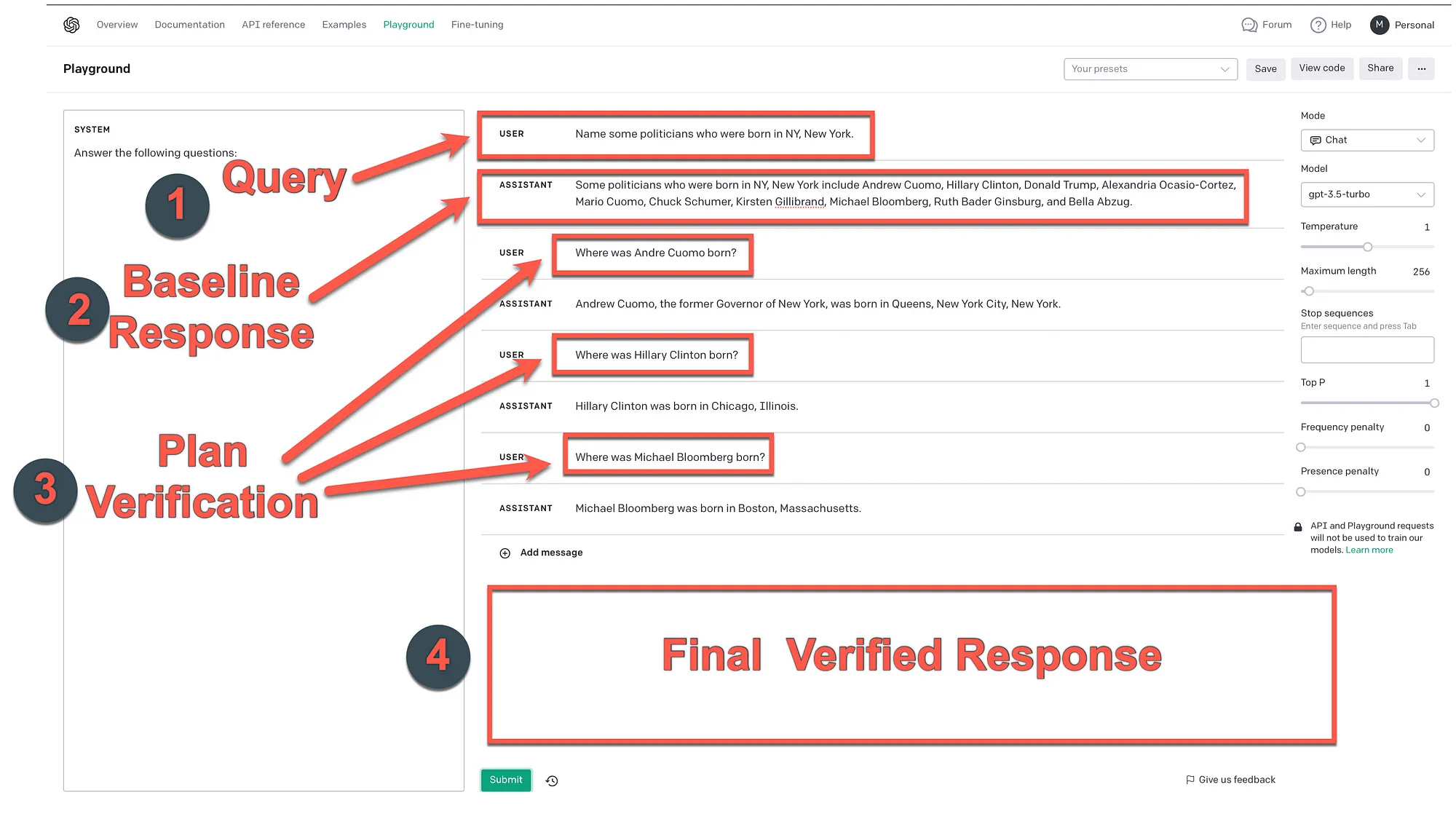

因此,验证链CoVe方法执行四个核心步骤:

1、生成基准回答: 根据查询,使用LLM生成回答。

2、计划验证: 根据查询和基准回答,生成一系列验证问题,以自我分析是否在原始回答中存在错误。

3、执行验证: 依次回答每个验证问题,然后检查答案与原始回答是否存在不一致或错误。

4、生成最终验证的回答: 根据发现的不一致性(如果有),生成一个修订的回答,将验证结果纳入其中。

文章来源:https://medium.com/@cobusgreyling/chain-of-verification-reduces-hallucination-in-llms-20af5ea67672

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消