Greening AI:使应用更具可持续性的7种策略

如今,AI应用具备无与伦比的计算能力,可以以前所未有的速度推动进步。然而,这些工具在运行过程中严重依赖耗能大的数据中心,导致其能源敏感性严重不足,这在很大程度上为其碳排放做出了重要贡献。令人惊讶的是,这些AI应用已经占据了全球温室气体排放量的2.5%到3.7%,超过了航空业的排放量。

不幸的是,这种碳足迹正在快速增长。

目前急需衡量机器学习应用的碳足迹,正如Peter Drucker所强调的,“你无法管理你无法衡量的东西。”目前,我们缺乏在量化AI环境影响方面的清晰度,精确的数据仍然无法得到。

除了衡量碳足迹之外,AI行业的领军人物还必须积极关注优化碳足迹。这种双重方法对于解决围绕AI应用的环境问题、确保更可持续的发展道路至关重要。

哪些因素影响了AI应用的碳足迹?

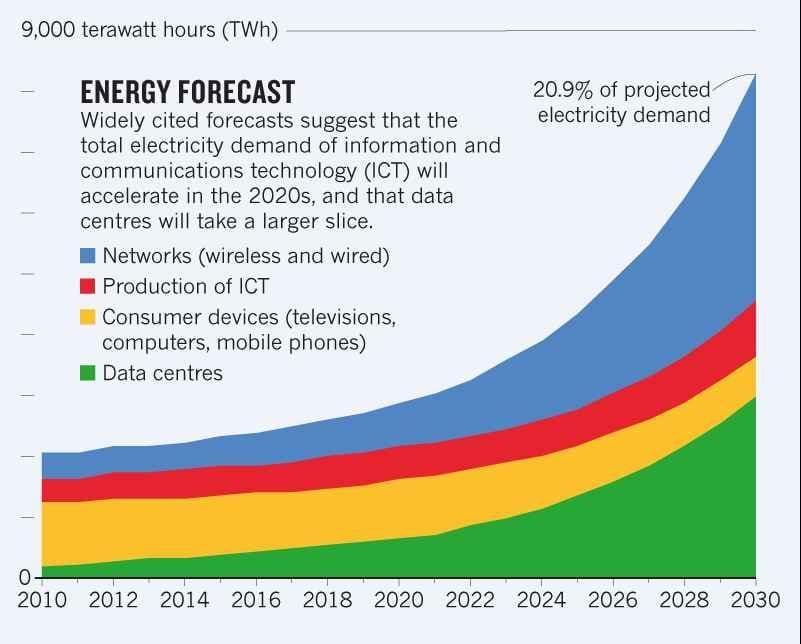

机器学习的增加使用需要更多的数据中心,其中许多数据中心都是耗能大户,因此具有显著的碳足迹。2021年,全球数据中心的电力消耗占到了0.9%到1.3%。

一项2021年的研究估计,到2030年,这一比例可能增加到1.86%。该数据代表了由于数据中心能源需求的不断增加趋势。

数据中心的能源消耗趋势和使用份额

值得注意的是,能源消耗越高,碳足迹就越大。数据中心在处理过程中会发热,过热可能导致损坏甚至停止运行。因此,它们需要冷却,这需要额外的能源。数据中心消耗的电力中约有40%用于空调。

计算AI应用的碳强度

鉴于AI使用的碳足迹不断增加,需要计算这些工具的碳强度。目前,对这个问题的研究仅限于对少数模型的分析,并未充分考虑这些模型的多样性。

下面是一种进化的估算AI系统碳强度的方法和一些有效的工具。

人工智能估算碳强度的方法

软件碳强度(SCI)标准是估算AI系统碳强度的一种有效方法。与传统方法不同,传统方法采用归因碳核算方法,SCI标准采用结果核算方法。

结果核算方法试图计算出一种干预或决策所产生的边际排放变化,例如生成额外单位的决策。而归因则是指对平均强度数据或静态排放清单进行核算。

Jesse Doge等人在《云实例中测量AI的碳强度》一文中采用了这种方法来进行研究。由于重要的AI模型训练是在云计算实例上进行的,这可以成为计算AI模型碳足迹的有效框架。该文章为此估算提炼出了SCI公式:

它是从以下内容中提炼出来的:

其中,C = O + M,O代表E * I。

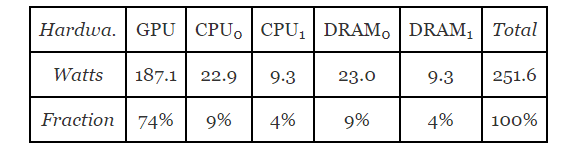

该论文使用该公式估算了单个云实例的电力使用情况。在基于深度学习的ML系统中,主要的电力消耗归功于GPU,在该公式中已经包含了GPU。虽然该结果仍然被文中的作者认为是低估,但包含GPU是朝着正确方向迈出的一步。传统估算技术的焦点没有将GPU纳入考虑,这意味着在估算中忽视了碳足迹的主要贡献者。显然,SCI提供了更全面、可靠的碳强度计算。

衡量云计算实时碳足迹的方法

AI模型训练通常在云计算实例上进行,因为云使得其灵活、可访问并且成本高效。云计算提供了部署和训练规模化AI模型所需的基础设施和资源。因此,在云计算上进行模型训练逐渐增加。

衡量云计算实例的实时碳强度是非常重要的,以确定适合减缓努力的区域。计算每单位能源的基于时间和位置的边际排放量,可以帮助计算运营碳排放,就像2022年的一篇论文所做的那样。

还有一个名为云碳足迹(Cloud Carbon Footprint,CCF)的开源工具可用于计算云实例的影响。

改善AI应用的碳效率

以下是优化AI系统碳强度的7种方法。

1.编写更好、更高效的代码

优化的代码可以通过减少内存和处理器的使用,减少能源消耗约30%。撰写一个碳效率代码涉及优化算法以便更快地执行、减少不必要的计算,并选择能源效率高的硬件来执行任务。

开发人员可以使用性能剖析工具来识别代码中的性能瓶颈和需要优化的领域。这个过程可以导致更节能的软件。此外,考虑实施面向能源的编程技术,其中代码被设计成适应可用资源并优先考虑节能执行路径。

2.选择更高效的模型

选择合适的算法和数据结构至关重要。开发人员应选择能够最小化计算复杂度和能源消耗的算法。如果更复杂的模型只能提供3-5%的改进,而训练时间要增加2-3倍,那么选择简单且训练更快的模型。

模型蒸馏是一种将大型模型压缩成更小版本以提高效率但保留重要知识的技术。可以通过训练一个小型模型来模仿大型模型,或者从神经网络中删除不必要的连接来实现。

3.调节模型参数

使用双目标优化调整模型的超参数,平衡模型性能(例如准确性)和能源消耗。这种双目标方法确保您在性能和能源消耗之间不会牺牲其中之一,使您的模型更高效。

利用诸如参数高效微调(PEFT)的技术,其目标是实现与传统微调类似的性能,但可减少可训练参数的数量。这种方法涉及在大部分预训练的大型语言模型(LLMs)冻结的同时,对少部分模型参数进行微调,从而显著减少计算资源和能源消耗。

4.压缩数据并使用低能源存储

实施数据压缩技术以减少传输的数据量。压缩数据传输所需的能量更少,占用磁盘空间更小。在模型服务阶段,使用缓存可以帮助减少对在线存储层的调用,从而减少能量消耗。

此外,选择合适的存储技术可以带来显著的收益。例如,如果数据不需要频繁访问,AWS Glacier是一种高效的数据归档解决方案,可能比使用S3更可持续。

5.在清洁能源上进行模型训练

如果您将云服务用于模型训练,可以选择区域进行计算。选择一个采用可再生能源的区域,可以将排放量减少多达30倍。AWS的博客文章概述了在业务优化和可持续目标之间的平衡。

另一个选择是选择运行模型的合适时间。在某些特定时间,能源更清洁,可以通过付费服务(如Electricity Map)获取关于不同地区电力碳强度的实时数据和未来预测。

6.使用专门的数据中心和硬件进行模型训练

选择更高效的数据中心和硬件对碳强度会有很大影响。专门用于机器学习的数据中心和硬件的能效比普通的数据中心和硬件高1.4到2倍和2到5倍。

7.使用AWS Lambda、Azure Functions等无服务器部署

传统部署方式需要服务器始终处于开启状态,这意味着24小时全天候的能源消耗。AWS Lambda和Azure Functions等无服务器部署方式可以以更低的碳强度正常工作。

总结

AI行业正在经历指数级增长,渗透到业务的各个方面和日常生活中。然而,这种扩张是以巨大的碳足迹为代价的,这威胁着将全球温度升高限制在仅1°C的目标。这个碳足迹不仅是一个当前的问题,其影响可能延伸到几代人,影响那些对其产生没有责任的人。因此,采取果断行动来减少AI相关的碳排放和探索可持续的利用潜力是至关重要的。重要的是确保AI的好处不是以环境和未来世代的福祉为代价的。