Woodpecker:纠正多模态大语言模型幻觉的创新框架

中国科学技术大学(USTC)和腾讯优图实验室的一组人工智能研究人员开发出一种名为“Woodpecker”的创新框架,旨在纠正多模态大型语言模型(MLLMs)中的幻觉。

这一开创性方法的研究论文已在预印服务器arXiv上发表,题为《Woodpecker: Hallucination Correction for Multimodal Large Language Models》。

“幻觉是困扰迅速发展的多模态大型语言模型(MLLMs)的一大隐患,指生成的文本与图像内容不一致的现象,”研究人员在论文中指出。现有的解决方案主要依靠调整指令的方法,需要使用特定数据对模型进行重新训练,这可能需要大量数据和计算资源。

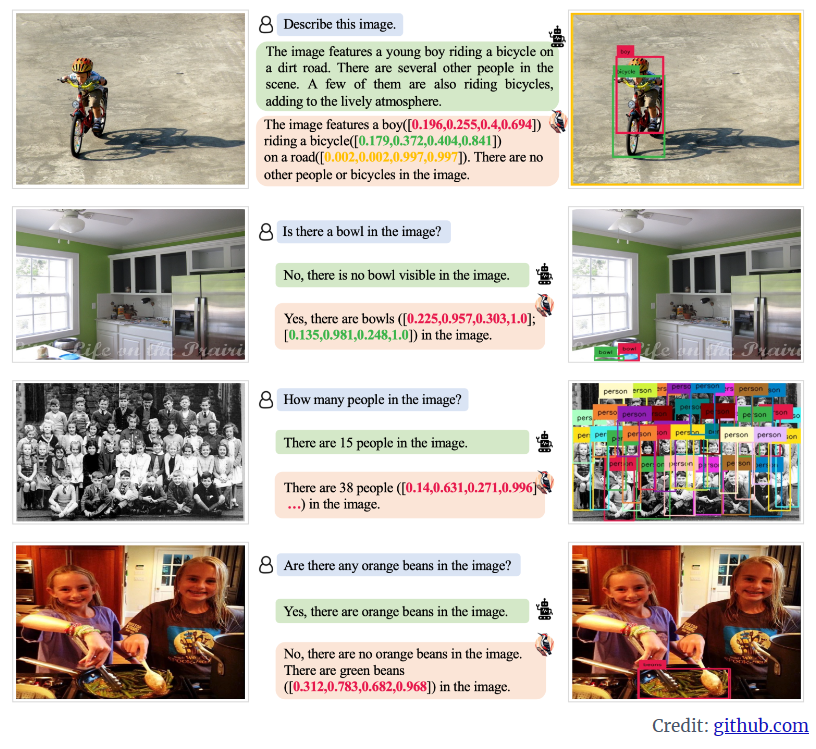

“Woodpecker”框架提供了一种无需训练的方法来纠正从生成的文本中产生的幻觉。该框架在进行彻底的诊断后执行纠正,包括五个阶段:关键概念提取、问题制定、视觉知识验证、视觉要求生成和幻觉修正。

研究人员解释了该框架名称背后的灵感:“就像啄木鸟修复树木一样,它会从生成的文本中挑选出并修正幻觉。”管道中的每个步骤都是清晰透明的,提供了有价值的可解释性。

Woodpecker的各个阶段协同工作,以验证和纠正图像内容与生成文本之间的任何不一致之处。首先,它识别文本中提到的主要对象。然后,它围绕提取的对象提出问题,比如它们的数量和属性。该框架使用专家模型回答这些问题,这个过程称为视觉知识验证。随后,它将问答对转化为一个视觉知识库,其中包含有关图像的对象级和属性级的声明。最后,在视觉知识库的指导下,Woodpecker修改幻觉并添加相应的证据。

研究人员已经发布了Woodpecker的源代码,鼓励更广泛的人工智能社区进一步探索和应用该框架。对于那些有兴趣亲自体验Woodpecker能力的人来说,研究人员提供了该系统的互动演示。这个平台提供了一个了解Woodpecker实时工作原理并观察其幻觉修正能力的机会。

团队进行了全面的定量和定性实验,评估了Woodpecker的有效性,使用了POPE、MME和LLaVA-QA90等各种数据集。“在POPE基准测试中,我们的方法大大提高了基线模型MiniGPT-4/mPLUG-Owl的准确性,从54.67%/62%提高到85.33%/86.33%,”他们报告说。

这一突破性进展正值人工智能越来越多地应用于各个行业的时候。MLLMs具有广泛的应用,包括内容生成和审核、自动化客户服务和数据分析等。然而,幻觉(即AI生成不存在输入数据中的信息)一直是其实际应用中的一个重大障碍。

Woodpecker的开发代表了解决这一问题迈出的关键一步,为更可靠、准确的AI系统铺平了道路。随着MLLMs的不断发展和改进,这类框架在确保其准确性和可靠性方面的重要性不言而喻。

Woodpecker框架以其无需重新训练和高可解释性的纠正幻觉能力,在MLLMs领域具有重要的影响力。它在改善各种应用中AI系统的准确性和可靠性方面具有巨大潜力。