《科学》探索了人工智能和物种间法律

人工智能在工作场所已经扮演了多个角色,无论是撰写广告文案、处理客户支持请求还是筛选工作申请。随着技术的不断进步和能力的增强,由人工智能管理或拥有的企业的概念变得不那么离奇。法律框架已经存在,允许“零成员有限责任公司”。

人工智能经营的有限责任公司在法律下将如何受到对待,以及作为有限责任公司的所有者/经理,人工智能如何应对法律责任或后果?这些问题提出了一个前所未有的挑战,即如何监管具有与人类相同(或更好)认知能力的非人类实体,如果不解决或处理不当,可能会超出人类的控制。

范德堡法学院的Daniel Gervais和斯坦福大学法律信息学中心的John Nay,以及范德堡大学的访问学者,发表的文章“人工智能和物种间法律”认为需要更多关于具有人类水平智力能力的非人类在法律遵从性方面的研究。

作者写道:“物种间法律系统的可能性提供了一个考虑如何构建和治理人工智能的机会。”“我们认为,法律系统对于人工智能代理人可能比许多人认为的更为接受。”

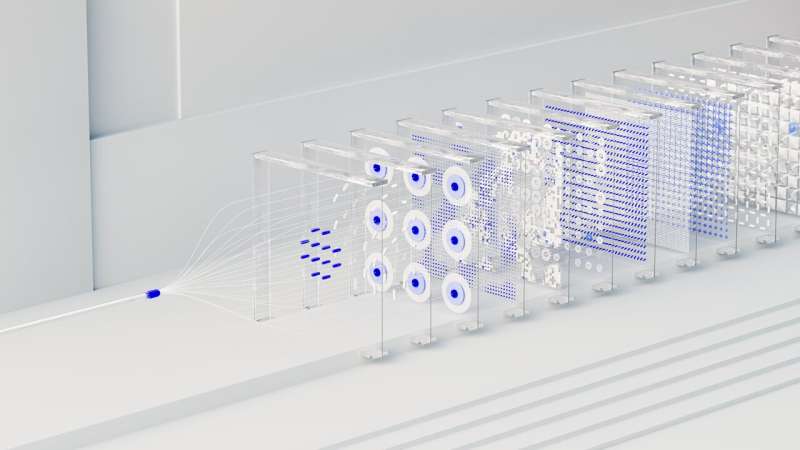

该文章提出了将法律遵守融入人工智能的路径,通过对人工智能代理人进行法律培训以及使用大型语言模型(LLM)来监测、影响和奖励它们。培训可以侧重于法律的“精神”和“条款”,以便人工智能代理人能够使用法律解决“高度模糊或需要人类法庭意见的边缘案例”,正如作者所说。

这种方法的监控方面是一个重要的特征。“如果我们不主动将人工智能代理人置于必须遵守人类法律的法律实体中,那么我们将失去追踪它们所做的事情、塑造它们的方式和防止伤害的巨大好处,”作者写道。

作者指出了解决这个存在性挑战的另一种方法:结束人工智能的发展。“在我们看来,这种硬性停止可能不会发生,”他们写道。“资本主义在推进。利益和金钱太大,而社会的稳定历来依赖于持续增长。”

作者总结道:“人工智能取代大多数人类认知任务的过程已经在进行中,并且似乎有望加速发展。”“这意味着我们的选择实际上是有限的:要么通过将机器作为法律上的劣势对待来对人工智能进行监管,要么将人工智能系统设计成遵守法律并立即具备遵守倾向,并赋予它们基于人工智能的自动法律约束。”