NExT-GPT:实现多模态转换的多功能模型

最近几年,生成AI研究的发展方式已经改变了我们的工作方式。从开发内容、计划工作、寻找答案到创作艺术品,现在都可以通过生成AI实现。然而,每个模型通常只适用于特定的用例,例如,GPT用于文本到文本,Stable Diffusion用于文本到图像,以及其他许多模型。

能够执行多个任务的模型被称为多模态模型。许多最先进的研究都朝着多模态方向发展,因为在许多场景中已经证明它是有用的。这就是为什么关于多模态的令人兴奋的研究之一是NExT-GPT。

NExT-GPT是一个可以将任何东西转化为任何东西的多模态模型。那么它是如何工作的呢?让我们进一步探究。

NExT-GPT介绍

NExT-GPT是一个任意到任意的多模态LLM,可以处理四种不同类型的输入和输出:文本、图像、视频和音频。这项研究是由新加坡国立大学的NExT++研究小组发起的。

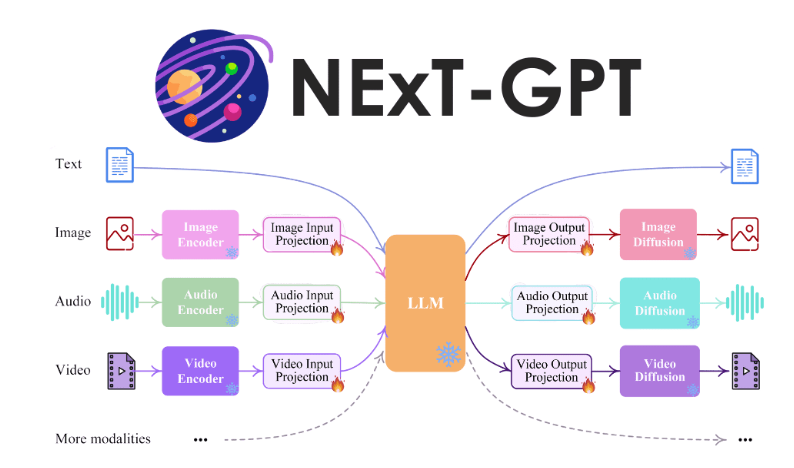

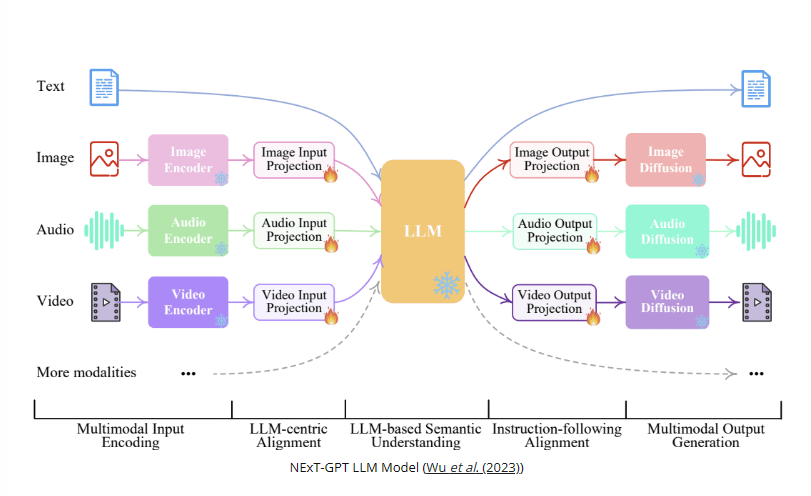

下图显示了NExT-GPT模型的整体表示。

NExT-GPT模型包括三个工作部分:

- 建立各种模态的输入的编码器,并将其表示为LLM可以接受的类似语言的输入

- 利用开源LLM作为核心,处理输入数据进行语义理解和推理,并使用额外的独特模态信号

- 将多模态信号提供到不同的编码器中,并根据适当的模态生成结果

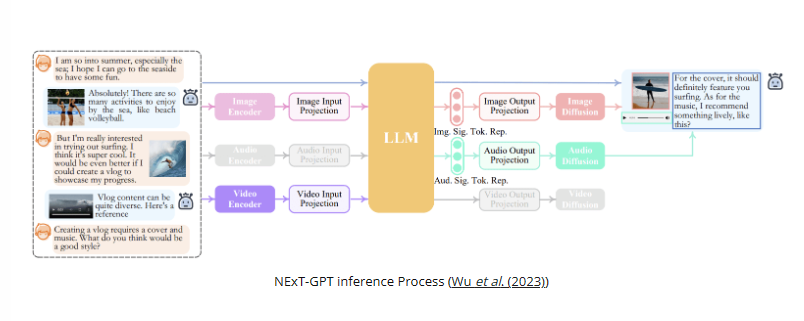

下图展示了NExT-GPT推理过程的一个例子。

我们可以在上图中看到,根据我们想要的,编码器和解码器会切换到适当的模态。这个过程只能发生在NExT-GPT利用了一种叫做模态切换指令调优的概念,使得模型能够符合用户的意图。

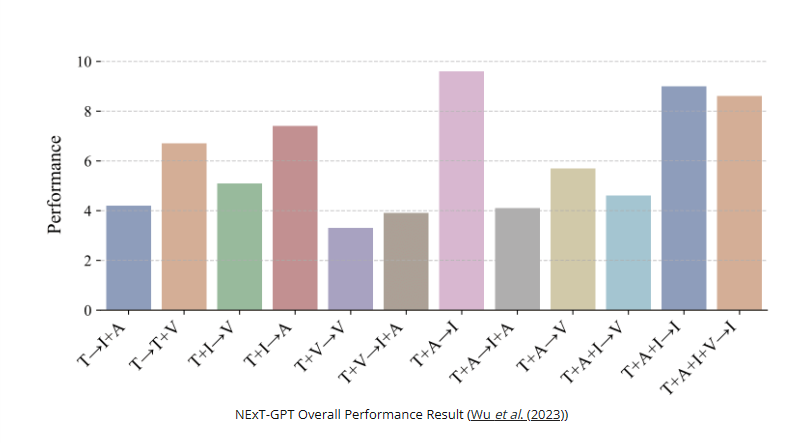

研究人员尝试了各种模态组合进行实验。总的来说,NExT-GPT的性能可以总结如下图所示。

NExT-GPT的最佳性能是文本和音频输入生成图像,其次是文本、音频和图像输入生成图像结果。表现最差的操作是文本和视频输入生成视频输出。

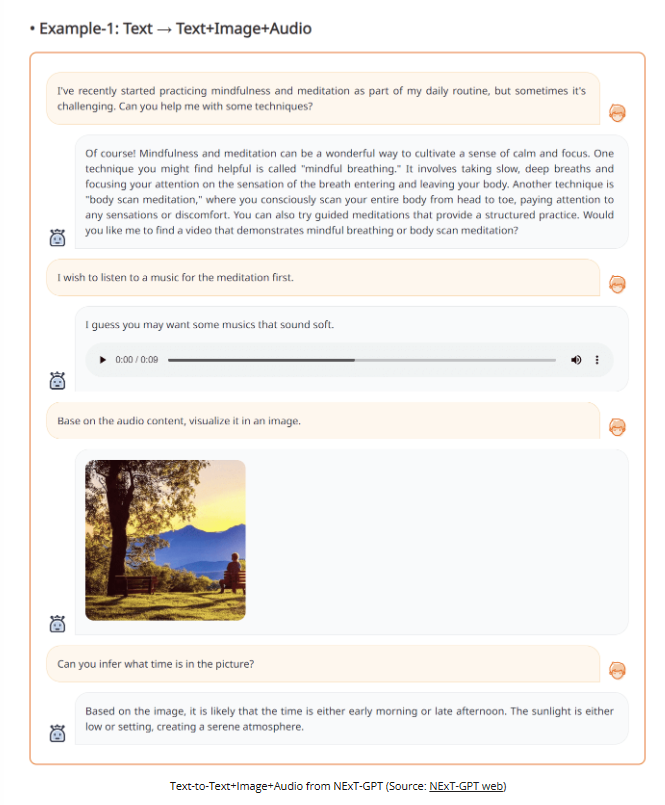

下图展示了NExT-GPT的能力示例。

上面的结果显示,与NExT-GPT进行交互可以产生符合用户意图的音频、文本和图像。这表明NExT-GPT的表现相当良好且可靠。

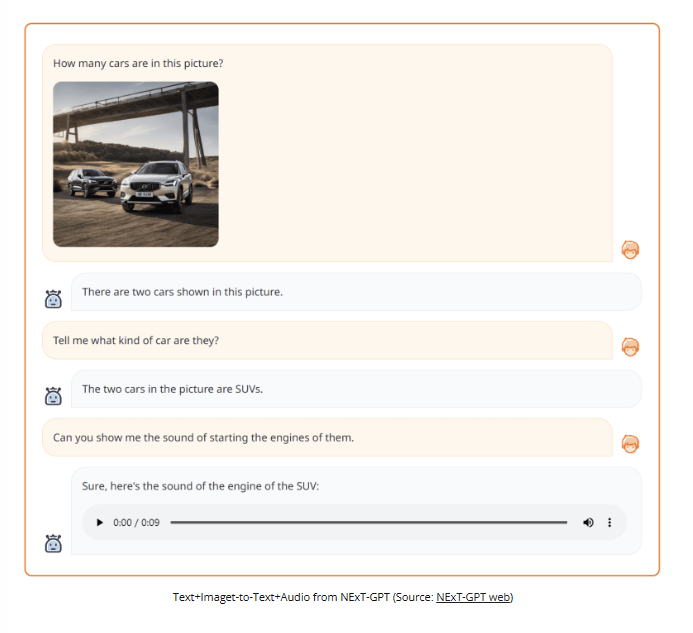

下图展示了NExT-GPT的另一个示例。

上图显示,NExT-GPT可以处理两种类型的模态以生成文本和音频输出。这表明该模型具有足够的灵活性。

结论

NExT-GPT是一个多模态模型,可以接受输入数据并产生文本、图像、音频和视频输出。该模型通过利用特定的编码器来处理模态,并根据用户的意图切换到适当的模态。性能实验结果显示了良好的结果和有前景的工作,可用于许多应用程序。