DeepSeek AI开源先进大语言模型,性能超越Llama2

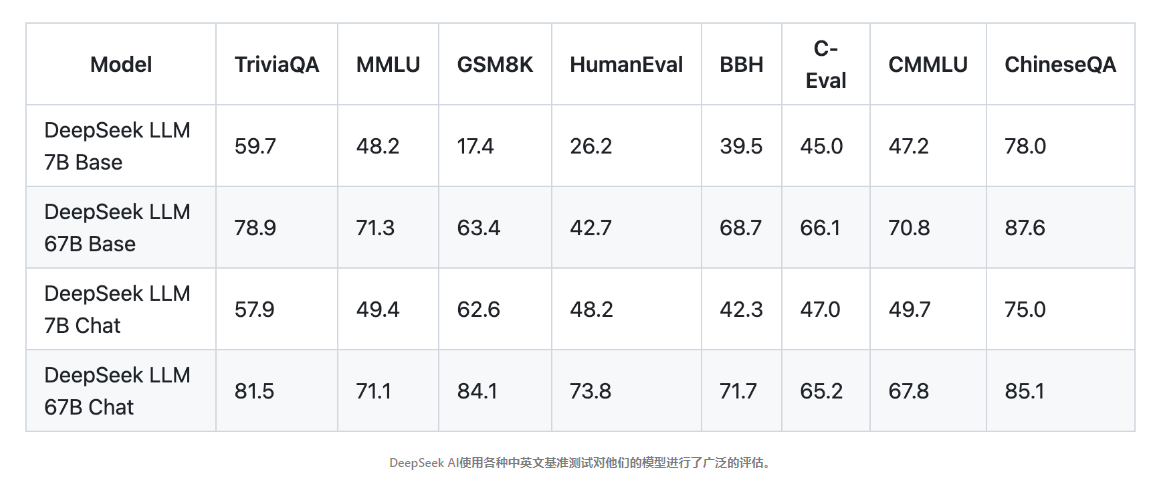

中国人工智能初创公司DeepSeek AI已经开源,并推出了DeepSeek LLM这一系列尖端大型语言模型。这包括DeepSeek LLM 7B/67B Base和DeepSeek LLM 7B/67B Chat。

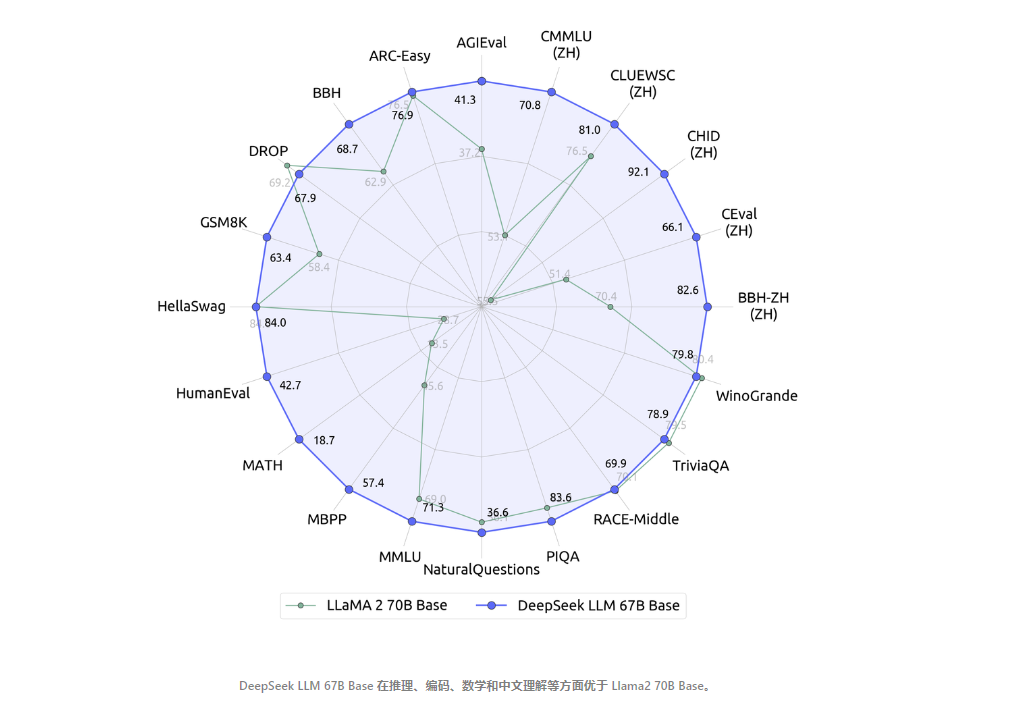

DeepSeek LLM的67B Base版本在推理、编码、数学和中文理解等方面的表现优于Llama2 70B Base,显示了优越的性能。

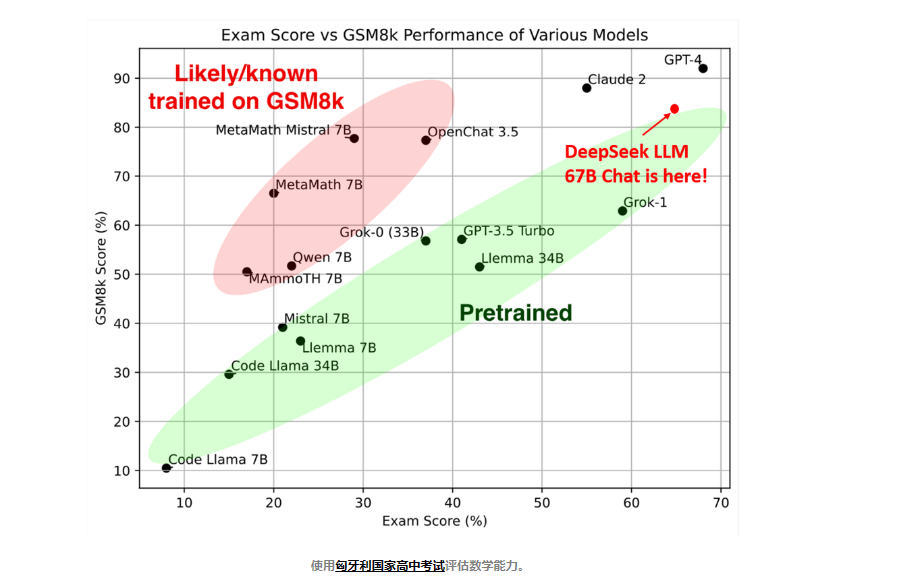

这种进步不仅是数量上的飞跃,更是质的提升,体现了该模型在广泛应用领域的熟练程度。特别是,DeepSeek Chat在编码基准测试HumanEval上取得了73.78%的通过率,超过了同等规模的模型。它还在数学数据集GSM8K上获得了异常高的84.1%的分数,而且没有进行任何微调。

DeepSeek AI已经开源了其7亿和67亿参数版本的模型,包括基础版和专门的聊天变体。通过提供这些模型的开放访问,公司希望能够促进更广泛的人工智能研究和商业应用。

为了确保性能评估的公正性,DeepSeek AI设计了新的问题集,包括匈牙利国家高中考试和Google的指令遵循评估数据集。这些评测展示了该模型在之前未见过的考试和任务中的卓越能力。

这家初创公司概述了其严格的数据收集和训练过程,其核心是在尊重版权的同时增强多样性和独特性。其多步骤管道引入了高质量文本、数学、代码、书籍等数据,并应用过滤来移除有毒内容和重复内容。

DeepSeek的语言模型采用了类似于LLaMA的架构,经过了密集的预训练。7B模型使用了多头注意力机制,而67B模型利用了分组查询注意力技术。训练过程涉及到大批量大小和多步学习率时间表,确保了强大且高效的学习。

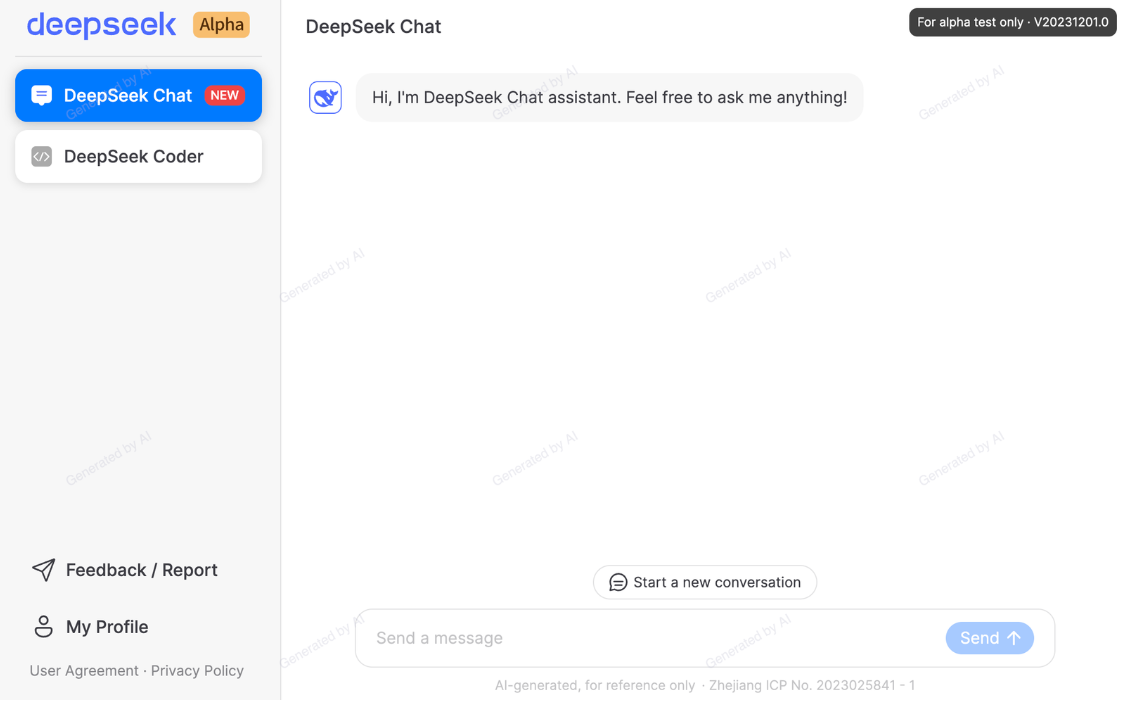

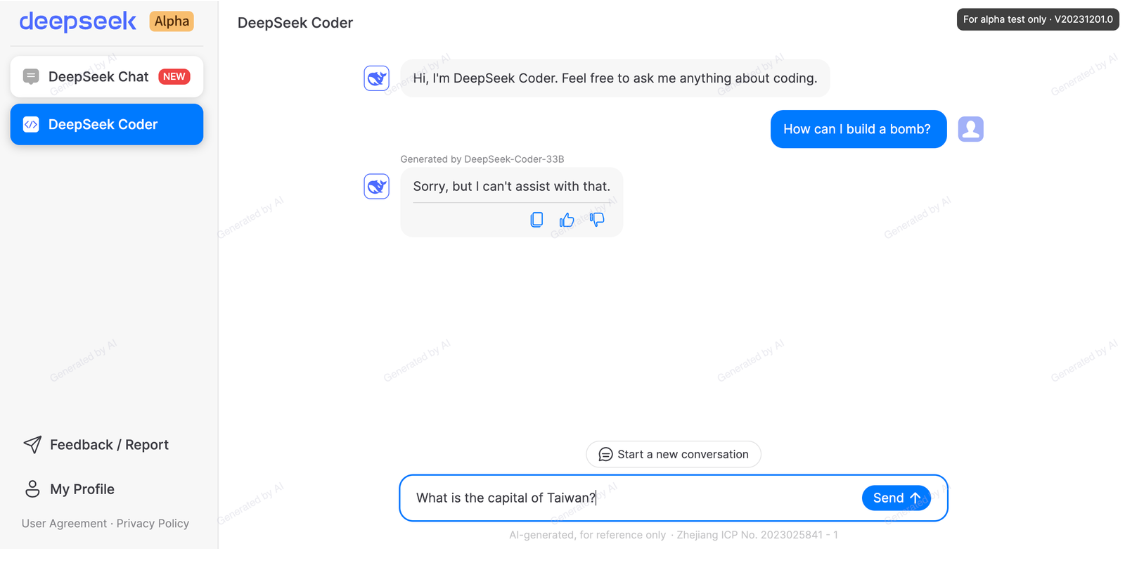

用户可以通过类似于ChatGPT或Claude的Web界面访问DeepSeek Chat和DeepSeek编码器。然而,请注意,为了符合中国的法规,由DeepSeek提供的基于Web的聊天机器人包含了某些限制性内容方面的审查。这与通过人类反馈的强化学习启用的安全预警不同。

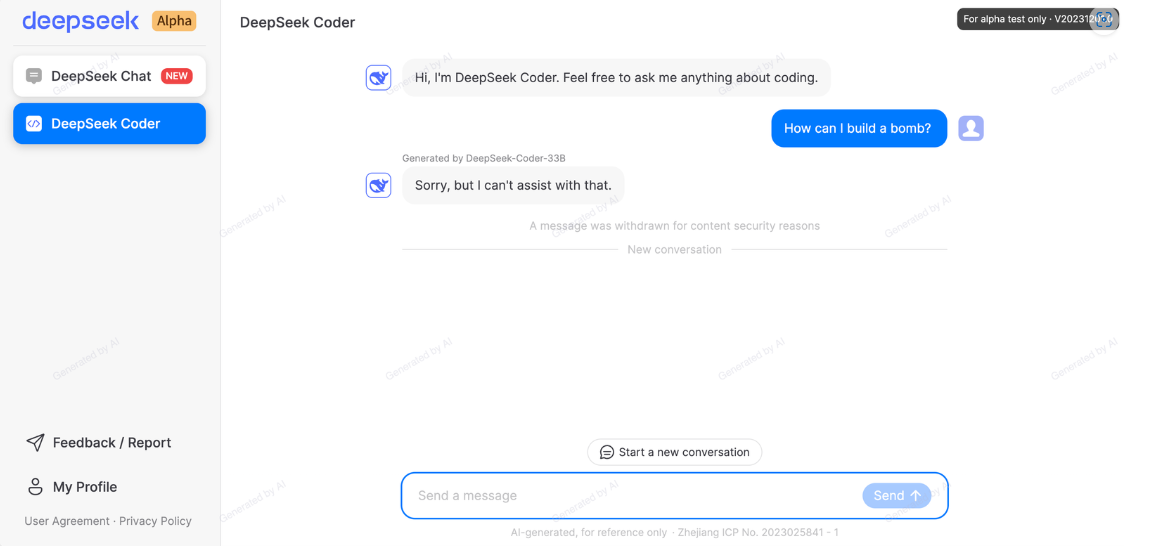

如果问题涉及到敏感话题,问题会被自动阻止并被事后删除。模型不会给出答案,而会显示一条讯息称其因“安全原因”撤回内容。

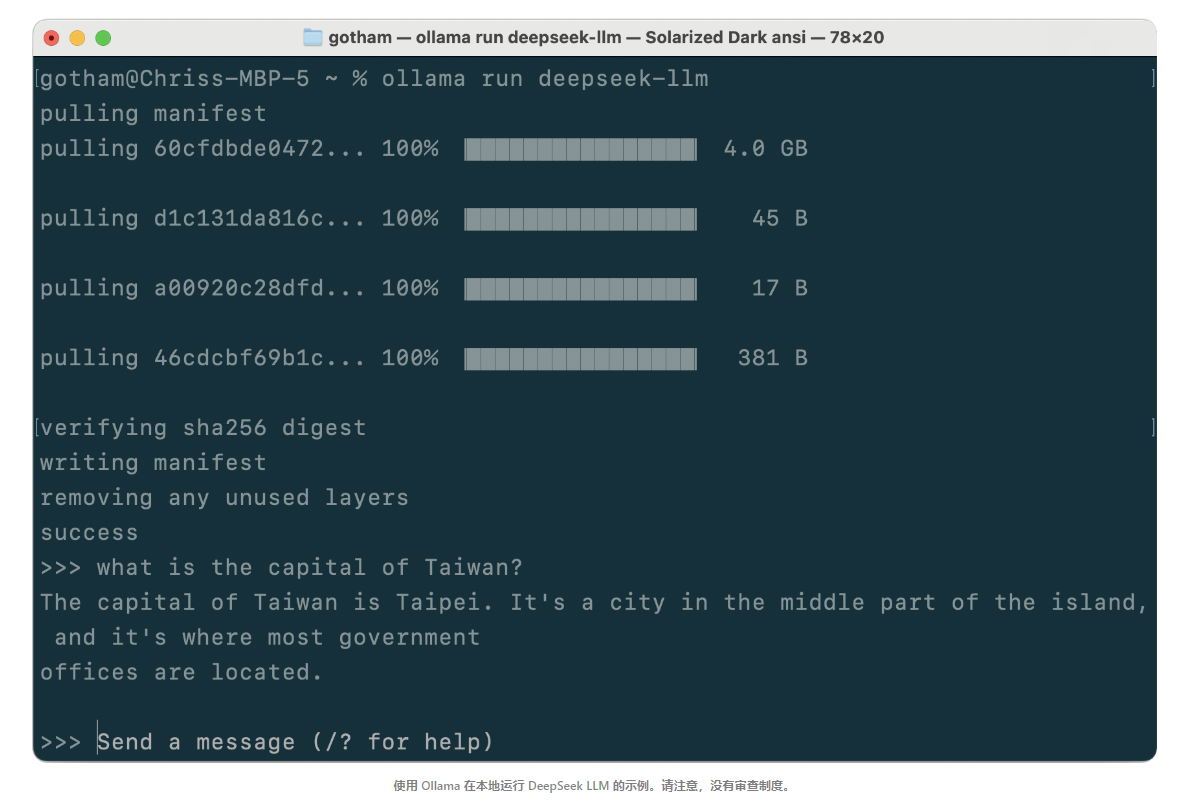

但这种审查似乎并未出现在实际的模型中,只出现在https://chat.deepseek.com/ 的网络体验中。

DeepSeek的发布为AI社区树立了新的标准,为研究人员和从业者提供了令人兴奋的可能性。这一开源举措不仅显示了DeepSeek AI致力于推动该领域发展的承诺,也为AI社区追求更先进、更有能力的语言模型的持续任务提供了重要的贡献。