研究显示:谷歌Gemini Pro不敌OpenAI旧模型

不到一个月前,谷歌在一段华丽的演示视频中向世界展示了它早有传闻的ChatGPT竞争对手Gemini,但新研究发现,目前对消费者开放的最强大的Gemini版本,Gemini Pro,在大多数任务上表现落后于OpenAI的GPT-3.5 Turbo大型语言模型(LLM)。

这是根据卡内基梅隆大学的一个研究团队和一个名为BerriAI的企业团队的研究成果。

他们的论文《Gemini语言能力的深入研究》在arXiv.org上发布。正如论文指出的:“我们发现,在所有任务中,截至本文写作之时(2023年12月19日),Gemini的Pro模型在准确性上与OpenAI当前版本的GPT 3.5 Turbo相当,且略有不足。”

对于那些花费大量时间在Gemini上工作的谷歌研究人员和他们的领导来说,这个结论无疑是一个打击。在这篇报道发布后,谷歌一位发言人做出了回应,坚称谷歌自己的研究显示Gemini Pro的表现胜过GPT-3.5,并且即将在2024年初推出的更强大版本Gemini Ultra,在谷歌的内部研究中得分高于GPT-4。以下是他们的完整回应:

“在我们的技术论文中,我们比较了Gemini Pro和Ultra与一系列外部LLM和我们以前最好的模型PaLM 2,覆盖了推理、阅读理解、STEM和编码等基于文本的学术基准。

这些结果[报告第7页的表2]显示,Gemini Pro的性能胜过了像GPT-3.5这样的推理优化模型,与几个目前可用的最有能力的模型相当,而Gemini Ultra则胜过了所有当前的模型。

具体来说,在MMLU上,它可以胜过所有现有的模型,准确率达到90.04%。它还是第一个超过这一门槛的模型,之前的最高状态为86.4%。

“另外,值得阅读Gemini作者在论文中对这些评估微妙性的讨论(也在同一页上),为了方便我摘录出来:

‘在这些基准上的评估是具有挑战性的,可能会受到数据污染的影响。我们在训练后进行了广泛的泄露数据分析,以确保我们在这里报告的结果尽可能科学可靠,但仍然发现了一些小问题,并决定不报告诸如LAMBADA等结果(Paperno等人,2016)。

作为评估过程的一部分,在一个受欢迎的基准——HellaSwag(Zellers等人,2019)上,我们发现在特定网站摘录上额外进行一百步的微调,在HellaSwag训练集中有所改善(这些摘录并未包含在Gemini预训练集中),Gemini Pro的验证准确度提高到89.6%,而Gemini Ultra提高到96.0%,使用一次性提示进行衡量(我们测量得到通过API进行一次性评估的GPT-4得到92.3%)。

这表明基准结果容易受到预训练数据集合成的影响。我们选择在10次评估设置中只报告去污染的HellaSwag结果。我们认为需要更多强大和细致的标准化评估基准,没有泄露数据。因此,我们在几个新发布的保持外部评估数据集上评估Gemini模型,例如WMT23和Math-AMC 2022-2023问题,或从非Web来源内部生成,例如Natural2Code。

我们建议读者参考附录以获取我们评估基准的全面列表。即使如此,模型在这些基准上的性能给我们一个模型能力的指示,并且可能在真实世界任务中提供影响。

例如,Gemini Ultra令人印象深刻的推理和STEM能力为LLM在教育领域的进步铺平了道路。处理复杂的数学和科学概念的能力为个性化学习和智能辅导系统带来了令人兴奋的可能性。'”

研究人员测试的内容

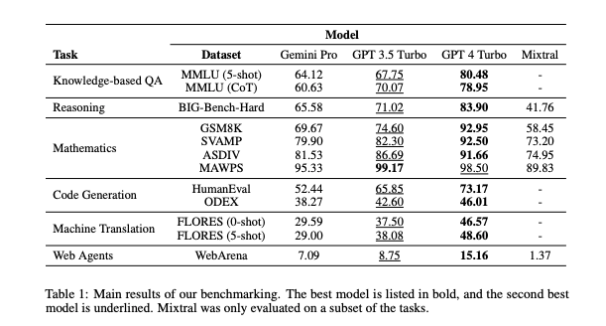

来自CMU和BerriAI研究人员的新论文继续指出,他们实际上测试了四种不同的LLM:谷歌Gemini Pro,OpenAI GPT-3.5 Turbo,GPT-4 Turbo,以及初创公司Mistral的新开源模型Mixtral 8x7B。

研究人员在一个AI聚合网站LiteLLM上使用了4天的时间,从2023年12月11日到15日,并运行所有模型通过一系列不同的提示,包括要求他们回答57个不同的多项选择题,“跨越STEM、人文、社会科学”,作为一个“基于知识的QA”测试的一部分。

在那项测试中,“Gemini Pro的准确率低于GPT 3.5 Turbo,且远低于GPT 4 Turbo”,具体来说是64.12/60.63(满分100/100)相比于GPT-3.5 Turbo的67.75/70.07,和GPT-4 Turbo的80.48/78.95。

有趣的是,研究人员发现,在引导不同的LLM选择标记为A、B、C或D的答案时,Gemini不成比例地多次选择了“D”,而不考虑它是否是正确答案。

“Gemini有一个非常倾斜的标签分布,偏向于选择最后的选项‘D’,这与GPT模型的结果形成对比,后者更加平衡。”论文中写道。“这可能表明Gemini没有大量的指令调整以解决多项选择题,这可能导致模型在答案顺序上有偏见。”

此外,研究人员观察到,在几个具体类别的问题上,Gemini比GPT-3.5 Turbo表现更差,特别是在人类性、形式逻辑、初等数学和专业医学方面。研究人员表示,这在很大程度上是因为Gemini拒绝回答一些问题,声称它不能遵守其安全和内容限制,研究人员将这些计为他们评分/基准测试中的错误响应。

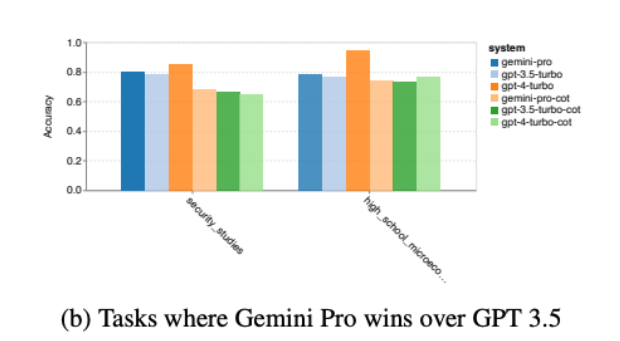

Gemini Pro在两类多项选择题中表现胜过GPT-3.5 Turbo - 安全和高中微观经济学,但“对于Gemini Pro表现优于GPT 3.5 Turbo的两项任务,收益很小”,研究人员指出。同时,GPT-4仍然在所有测试的模型中占据王者地位。

公平地说,研究人员小心地指出,在测试超过900个标记的LLM输出时,Gemini的表现胜过了GPT-3.5(标记是分配给不同单词、字母组合和符号的不同数值,反映了模型对不同概念的内部组织)。

研究人员在另一类问题上测试了模型,“通用目的推理”,其中没有提供答案选项。相反,要求LLM阅读一个逻辑问题并用它们认为是正确答案的内容作为回应。

再一次,研究人员发现“Gemini Pro的准确率略低于GPT 3.5 Turbo,并且远远低于GPT 4 Turbo...Gemini Pro在更长、更复杂的问题上表现欠佳,而GPT模型对此更为坚韧。特别是对于GPT 4 Turbo,即使是更长的问题,它也显示出了令人印象深刻的能力,几乎没有任何衰退表现,表明了对长期和更复杂查询的强大理解能力。”

然而,Gemini确实在以下两个子类别中胜过了“所有GPT模型”,包括GPT-4:词语排序和符号操纵(Dyck语言任务)。正如研究人员所说:“Gemini特别擅长于单词重排和以正确顺序产生符号。”

在数学和数学推理方面,研究人员发现与测试其他学科内容类似的结果:“Gemini Pro的准确率略低于GPT 3.5 Turbo,且远远低于GPT 4 Turbo。”

认为Gemini在编程方面可能会挽回面子?再想想吧。当给定两个不同的不完整的Python代码串要求完成时,Gemini在“两项任务上的表现都低于GPT 3.5 Turbo,而且远低于GPT 4 Turbo。”

以及当被询问充当“网络代理”,根据提示说明代表用户在公共互联网上导航和完成任务时,“Gemini-Pro的表现可比但略低于GPT-3.5-Turbo。”

Gemini在一个区域上确实优于所有其他模型,那就是谷歌以前的技能集中的翻译内容:在20种语言中,“Gemini Pro在8种语言上胜过了GPT 3.5 Turbo和GPT 4 Turbo,并在4种语言上取得了最好的表现。”

但即便是这个结果也被“Gemini Pro在大约10种语言对中显示了强烈的倾向于阻止回应”的事实玷污了,这表明了一个过于热衷的内容审查/安全系统。

这对于谷歌的AI抱负意味着什么,对于用户呢?

结果显然是对谷歌的抱负,即在生成AI竞赛中与OpenAI正面对抗,造成了打击,而且更强大的谷歌Gemini Ultra模型在明年之前不会面世,这可能意味着谷歌至少要到那时才会在AI性能方面跟上。

有趣的是,该研究还展示了Mistral的热门新LLM Mixtral 8x7B——它采用了“专家混合”方法,其中几种不同的较小AI模型被链接在一起,每个模型都处理最适合它们专业化的不同任务集——在大多数情况下,它的性能也远远落后于OpenAI的GPT-3.5 Turbo。而Gemini Pro“在我们检查的每项任务上都表现优于Mixtral”,根据研究人员的说法。

这表明了谷歌AI工作的一个亮点:它仍然优于前沿的开源解决方案。

然而,总体而言,很难不从这项研究中得出这样的印象:就目前而言,OpenAI仍是消费者和企业面向的生成式AI领域的王者。

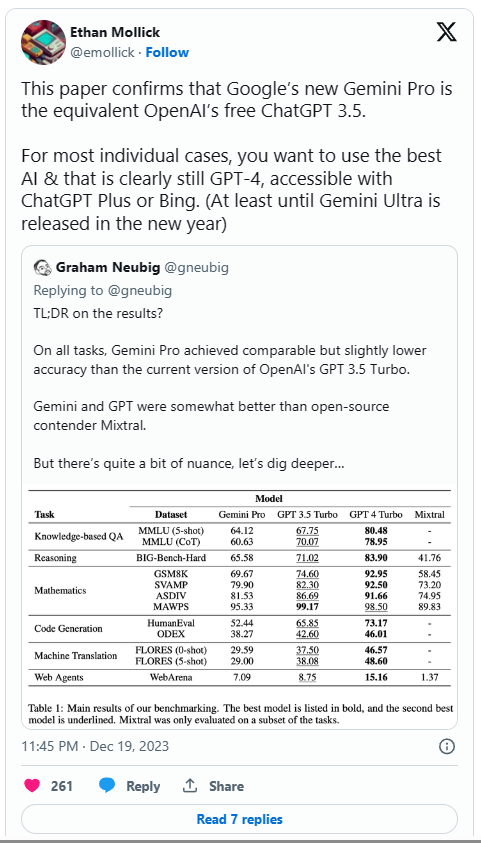

像宾夕法尼亚大学沃顿商学院教授Ethan Mollick这样的AI影响者似乎也基本同意这一点。正如Mollick在X上发布的内容:“对于大多数个别案例,你想使用最好的AI&那显然仍然是GPT-4……至少在明年新年Gemini Ultra发布之前。”