MyShell推出OpenVoice:开源AI即时语音克隆模型

初创企业包括越来越知名的ElevenLabs已经筹集了数百万美元来开发它们自己的专有算法和人工智能软件,用于制作语音克隆——一种模仿用户声音的音频程序。

然而,一个新的解决方案OpenVoice出现了,由麻省理工学院(MIT)、中国北京的清华大学以及加拿大人工智能初创企业MyShell的成员所开发,提供开源的语音克隆,这几乎是即时的,并且提供了在其他语音克隆平台上未发现的精细控制功能。

MyShell在其官方公司账户X上的帖子中写道:“使用极致准确的克隆声音,仅用一小段音频片段即可精细控制音调,从情感到口音、节奏、停顿和语调。”

该公司还在帖子中附上了一篇经过预审的研究论文的链接,描述了他们是如何开发OpenVoice的,以及用户可以访问和尝试它的几个地方的链接,包括MyShell的网页应用界面(需要用户账号访问)和HuggingFace(可以不用账号公开访问)。

MyShell的首席研究员之一秦增益表示:“MyShell希望造福整个研究社区。OpenVoice只是一个开始。未来,我们甚至将提供资金援助、数据集和计算能力来支持开源研究社区。MyShell的核心共鸣是‘人人都能用的AI’。”

关于为何MyShell起初选择开源语音克隆人工智能模型,秦增益写道:“语言、视觉和声音是未来人工通用智能(AGI)的三个主要方式。在研究领域,虽然语言和视觉已有一些不错的开源模型,但对于声音尤其是能让每个人自定义生成的声音的即时强大语音克隆模型却还缺乏一个好模型。所以,我们决定这么做。”

使用OpenVoice

在对HuggingFace上的新声音克隆模型进行的非科学测试中,可以只用几秒钟的时间,使用完全随机的语音快速生成一个相对令人信服的——如果有点机械感的——自己声音的克隆版本。

与其他声音克隆应用程序不同的是,OpenVoice克隆人的声音时,不必读出一个特定的文本块。简单地即兴说几秒钟,然后模型就生成了一个声音克隆,几乎可以立即播放。

还能够通过下拉菜单调整“风格”,在几个默认设置之间(例如愉快、悲伤、友好、愤怒等)进行选择,并听到语调随这些不同情感的明显变化。

OpenVoice是如何制作的

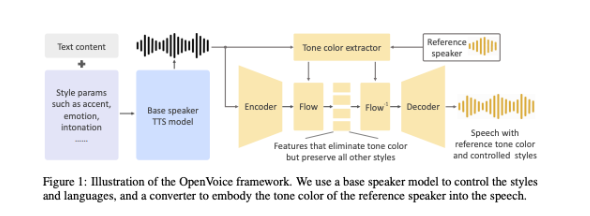

OpenVoice包括两种不同的人工智能模型:一种文本到语音(TTS)模型和一个“音调转换器”。

第一个模型控制“风格参数和语言”,并且在标注了其中所表达情感的“30,000句两种英语口音(美国和英国口音)、一种中文口音和一种日语口音”的音频样本上进行了训练。它还从这些剪辑中学习了语调、节奏和停顿。

同时,音调转换器模型是在来自超过20,000名不同发言者的300,000多个音频样本上训练的。

在这两种情况下,人类语音的音频都被转换成音素——特定的声音将一个词与另一个词区分开来——并以向量嵌入的方式表示。

通过使用一个"基础说话者"作为TTS模型,然后将其与用户提供的录音音频中的音调结合,这两个模型一起可以再现用户的声音,以及改变他们的“音调色彩”,或说出文本的情感表达。这是OpenVoice团队论文中包含的一张图表,说明了这两个模型是如何一起工作的:

该团队指出他们的方法在概念上相当简单。尽管如此,它的工作效果很好,并且与其他方法(包括Meta的竞争对手人工智能声音克隆模型Voicebox)相比,它使用的计算资源要少得多。

“我们想要开发迄今为止最灵活的即时语音克隆模型。”秦在一封电子邮件中指出。“灵活性在这里意味着对风格/情感/口音等的灵活控制,并且可以适应任何语言。以前没有人能做到这一点,因为这太困难了。我领导着一群有经验的AI科学家,花了几个月的时间才找出解决方案。我们发现有一种非常优雅的方式来将这个艰巨的任务分解为一些可行的子任务,以实现看似整体太难的事情。这个分解的流水线事实证明非常有效但也非常简单。”

谁在背后支持OpenVoice?

成立于2023年的MyShell,位于加拿大省份阿尔伯塔省的卡尔加里,已经得到了由INCE Capital领投、Folius Ventures、Hashkey Capital、SevenX Ventures、TSVC和OP Crypto等额外投资的560万美元种子轮资金,并且据The Saas News所称,已经拥有超过400,000名用户。

这家初创公司将自己描述为一个“去中心化且全面的平台,用于发现、创建和质押AI原生应用程序”。

除了提供OpenVoice之外,该公司的网页应用还包括许多不同“个性”的基于文本的AI角色和机器人——类似于Character.AI。它还包括一个动画GIF制作者和用户生成的基于文本的RPGs,其中一些特色像哈利波特和漫威特许权。

如果MyShell将OpenVoice做成开源,它计划如何盈利?该公司对其网页应用的用户以及希望在应用程序中推广其产品的第三方机器人开发者收取月费。它还收取人工智能训练数据费用。