AI2推出OLMo:“第一个真正开放”的大型语言模型

艾伦人工智能研究院(AI2)公布了一项开创性的开源AI生态系统新贡献 - OLMo,这是一种大型语言模型(LLM),其内部工作原理具有前所未有的透明度。

AI2称OLMo为“首个真正开放的大型语言模型”,其特点是不仅提供模型代码和权重,还公布了完整的训练数据、训练代码、评估基准和用于开发OLMo的工具包。这种程度的开放性使AI研究人员能够深入分析模型的构建方式,从而增进我们对大型语言模型的理解。

OLMo的透明度解决了许多流行AI模型如今被视为“黑盒子”的问题,因为这些模型使用未公开的方法和数据集进行训练。正如OLMo的项目负责人Hanna Hajishirzi所说:“如果没有训练数据,研究人员就无法科学地理解模型是如何工作的。”OLMo最终提供了这种可见性。

该模型建立在AI2的Dolma数据集上,该数据集包含一个用于语言模型预训练的三万亿令牌开放语料库,其中包括生成训练数据的代码。它提供了四种规模为7B的模型变体的完整模型权重,每种都经过至少2T令牌的训练,同时还有推理代码、训练指标和日志。此外,OLMo的评价套件在Catwalk和Paloma项目下发布,包括每个模型在训练过程中每1000步的500多个检查点。

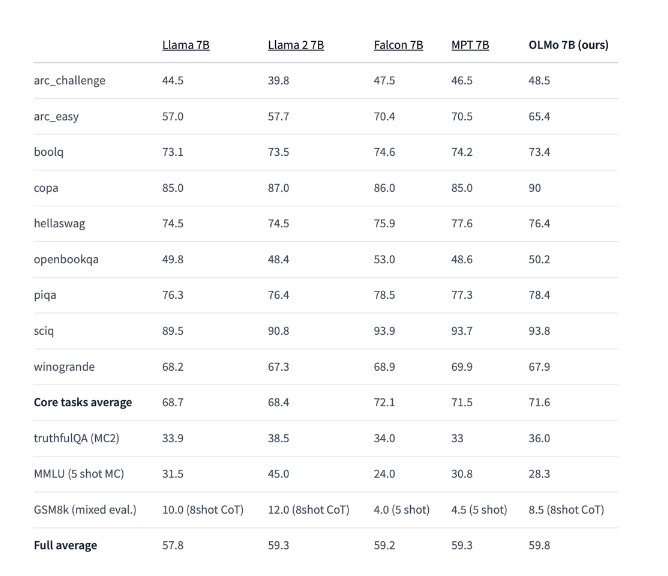

而且OLMo不仅仅是一个学术练习 - 它展示了与商业产品相媲美的尖端性能。在与Meta的LLama和TII的Falcon等模型进行基准测试时,OLMo表现出色,甚至在某些自然语言任务上超越了它们。

OLMo的出色亮相开启了AI2迭代构建“世界上最好的开放语言模型”的目标。该机构计划随着时间的推移,通过增加模型大小、模态和功能来继续增强OLMo。

通过开放源代码开发OLMo的整个框架,AI2为人工智能研究领域的透明度设定了新的标准。微软首席科学家Eric Horvitz赞扬了这种前所未有的开放程度,称其“将在全球社区中推动人工智能领域的众多进步”。

OLMo的发布不仅仅是为了提供工具;它还为更深入理解AI模型奠定了基础。正如Meta的首席AI科学家Yann LeCun所说,开放基础模型在推动生成AI的创新方面发挥了重要作用。开源项目产生的充满活力的社区对于加速未来AI技术的发展至关重要。

与哈佛大学肯普纳研究所(Kempner Institute)和AMD、CSC(Lumi超级计算机)、华盛顿大学保罗·G·艾伦计算机科学与工程学院的合作以及Databricks等机构与合作伙伴的合作对于实现OLMo至关重要。这些合作突显了OLMo所体现的协作精神,旨在促进全球范围内的AI实验和创新。

OLMo背后的协作精神可以追溯到人工智能作为开放学术学科的早期阶段。随着人工智能采用率的加速,像OLMo这样的计划对于在开放而非保密的基础上推动技术的进步至关重要。如果人工智能要造福人类,我们必须了解它是如何工作的-而OLMo在这方面发挥着强大的推动作用。