Stability AI发布第三代图像生成模型Stable Diffusion 3

Stability AI 发布了 Stable Diffusion 3.0 的早期预览版,这是其下一代文本到图像生成人工智能模型,旨在显著提高图像质量、拼写能力和多主题提示的性能。

在过去的一年中,公司通过多次模型迭代,稳步提升了图像合成能力。Stable Diffusion 3.0 是一次重大升级,它采用了新的扩散变压器架构和流匹配(一种用于训练模型的无模拟方法),有望加快扩散模型的性能。

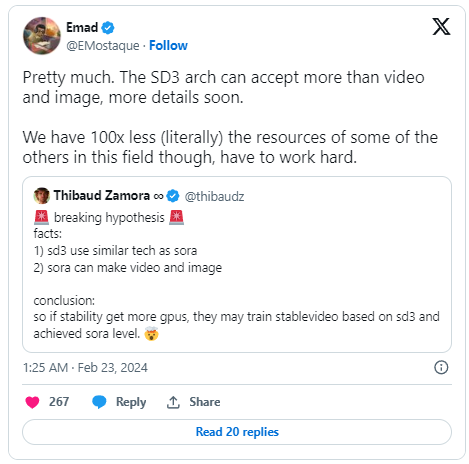

Stability AI 首席执行官埃马德-莫斯塔克(Emad Mostaque)在 X 上说:"Stable Diffusion 3 是一种扩散变压器,是一种新型架构,类似于最近 OpenAI Sora 模型中使用的架构。""它是原始 Stable Diffusion 的真正继承者。"

变换器已成为自然语言模型的主力,但扩散变换器通过对潜在图像补丁进行操作,专门针对图像生成。结合流匹配,Stability AI 指出这些方法能够提高训练速度、采样效率和整体输出质量。

准确的文本渲染一直是图像合成模型面临的挑战(不过 DALLE-3 在这方面表现不俗)。Mostaque 强调了新模型在拼写方面的改进,这些改进源于其转换器架构和额外的文本编码器。"他说:"现在可以实现完整的句子,并且风格连贯。”

该公司表示,Stable Diffusion 3 系列模型的参数范围从 800M 到 8B,为用户提供了一系列质量和可扩展性选项,并承诺将很快发布详细的技术报告。

虽然被介绍为文本到图像模型,但 Mostaque 表示 Stable Diffusion 3.0 将成为 Stability AI 即将推出的视频、3D 和多模态生成型 AI 系统的基础。“我们制作开放模型,可以在任何地方使用并适应任何需求。”他说道。

Mostaque 还抽空分享了公司即将推出的编辑和控制功能。在演示视频中,他展示了用户在修改图像特定部分时将拥有的各种高级粒度控制功能。