Cerebras称AI超算Condor Galaxy 3取得突破,性能可达8 exaFLOPs

Cerebras与G42共同宣布,他们已经开始打造一款名为Condor Galaxy 3的人工智能超级计算机,其性能将高达8 exaFLOPs。

总部位于美国加利福尼亚州桑尼维尔的Cerebras公司首席执行官安德鲁·费尔德曼表示,这一强大的性能将由5800万个经过人工智能优化的核心提供。他还透露,Condor Galaxy 3将成为世界上最大的人工智能超级计算机之一,归位于阿拉伯联合酋长国阿布扎比的国家级云和生成式人工智能赋能者G42所有。

Condor Galaxy 3将装备64套Cerebras最新发布的CS-3系统,这些系统全部由费尔德曼所说的业内最快的人工智能芯片——晶圆级引擎3(WSE-3)驱动,能够提供8 exaFLOPs的AI性能,并拥有5800万个经过AI优化的核心。

“我们建造了大型、快速的人工智能超级计算机。随着集群的不断构建和扩大,我们开始在这些集群上训练大型模型。”费尔德曼说。

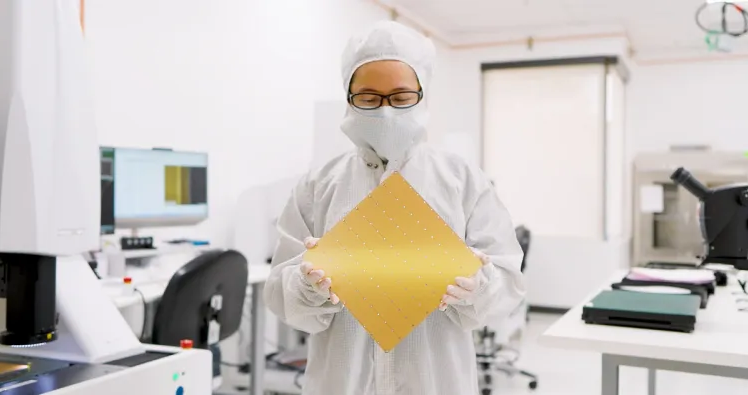

在“芯片”方面,Cerebras有着相当独特的方法。该公司设计的核心虽小,但分布在整个半导体晶圆上——通常用于制造数百个芯片。通过使用相同的基板制造芯片,它提高了通信速度和处理效率。这就是为什么它能在单个芯片(或更准确地说是一个相当大的晶圆)上安装90万个核心的原因。

位于美国德克萨斯州达拉斯的Condor Galaxy 3是Condor Galaxy人工智能超级计算机网络的第三台设备。Cerebras和G42的战略合作伙伴关系已经通过Condor Galaxy 1和Condor Galaxy 2提供了8 exaFLOPs的人工智能超级计算性能,这两台计算机都是世界上最大的人工智能超级计算机之一。

Condor Galaxy 3的建成使得Condor Galaxy网络目前的总性能达到了16 exaFLOPs。到2024年底,Condor Galaxy将提供超过55 exaFLOPs的人工智能计算能力。总体而言,Cerebras将为G42建造九台人工智能超级计算机。

G42集团首席技术官基里尔·埃夫季莫夫在一份声明中表示:“通过Condor Galaxy 3,我们持续实现通过开发世界上最大、最快的人工智能超级计算机,来改造全球人工智能计算库存的共同愿景。现有的Condor Galaxy网络已经训练了一些业界领先的开源模型,下载量达数百万次,我们期待看到Condor Galaxy超级计算机能以两倍的性能开启下一波创新。”

Condor Galaxy 3由64套Cerebras CS-3系统组成,其核心是新型WSE-3 5纳米芯片,该芯片在相同功耗和成本下实现了两倍的性能提升。专为训练业界最大的人工智能模型而设计的WSE-3拥有四万亿个晶体管,每块芯片拥有90万个经过AI优化的核心,可提供惊人的125 petaflops的峰值AI性能。

费尔德曼表示:“我们很荣幸地宣布,我们新推出的CS-3系统将在我们与G42开创性的战略合作中发挥关键作用。从Condor Galaxy 3到Condor Galaxy 9,每台都将使用64台新的CS-3,这将使我们将提供的计算能力从36 exaFLOPs扩展到超过55 exaFLOPs。这标志着人工智能计算领域的一个重大里程碑,提供了无与伦比的处理能力和效率。”

Condor Galaxy已经训练了生成式人工智能模型,包括Jais-30B、Med42、Crystal-Coder-7B和BTLM-3B-8K。其中,Jais 13B和Jais30B是世界上最好的双语阿拉伯语模型,现已在Azure Cloud上提供。BTLM-3B-8K是HuggingFace上排名第一的3B模型,该模型在轻量级3B参数模型中提供7B参数性能,适用于推理,公司表示。

Med42是与M42和Core42合作开发的领先临床LLM,它在Condor Galaxy 1上仅用了一个周末就训练完成,其性能和准确性超过了MedPaLM。

Condor Galaxy 3将于2024年第二季度推出。

晶圆级引擎3

在其他新闻中,Cerebras分享了为超级计算机提供动力的芯片。该公司表示,随着晶圆级引擎3(WSE-3)的推出,其现有的最快人工智能芯片世界纪录已经翻了一番。

WSE-3在相同功耗和价格下,性能是之前的纪录保持者——Cerebras WSE-2的两倍。WSE-3专为训练业界最大的人工智能模型而设计,这款基于5纳米技术、拥有4万亿个晶体管的芯片为Cerebras CS-3人工智能超级计算机提供动力,通过90万个经过AI优化的计算核心,实现125 petaflops的峰值AI性能。

费尔德曼表示,这台强大的计算机将由150个托盘进行运送。

他进一步指出:“我们已宣布了当前一代晶圆级引擎的五纳米部件,这是目前地球上速度最快的芯片。它是在台积电制造的,拥有46000平方毫米的部件。在五纳米节点上,它集成了惊人的4万亿个晶体管,90万个AI核心,并具备125 petaflops的AI计算能力。”

CS-3配备了一个高达1.2 petabytes的庞大内存系统,专门用于训练比GPT-4和Gemini大10倍的新一代前沿模型。无需进行分区或重构,24万亿参数的模型可以存储在一个单一的逻辑内存空间中,极大地简化了训练工作流程,并提高了开发者的生产效率。在CS-3上训练一个万亿参数的模型,就像在GPU上训练一个十亿参数的模型一样简单。

CS-3不仅适用于企业需求,也完全满足超大规模需求。紧凑的四系统配置可以在一天内微调70B模型,而在全规模使用2048个系统时,可以在一天内从零开始训练Llama 70B,这在生成式人工智能领域是一项前所未有的壮举。

最新的Cerebras软件框架为PyTorch 2.0和最新的AI模型及技术(如多模态模型、视觉转换器、专家混合和扩散)提供了原生支持。值得一提的是,Cerebras仍然是唯一为动态和非结构化稀疏性提供原生硬件加速的平台,可以将训练速度提高多达八倍。

费尔德曼兴奋地说:“八年前,当我们开始这个旅程时,每个人都认为晶圆级处理器只是一个遥不可及的梦想。现在,我们非常自豪地推出了我们开创性晶圆级人工智能芯片的第三代产品WSE-3。WSE-3是世界上最快的AI芯片,专为处理最新的尖端AI工作而设计,从专家混合到24万亿参数的模型。我们很高兴将WSE-3和CS-3推向市场,以助力解决当今最大的AI挑战。”

CS-3的每个组件都针对AI工作进行了优化,在占用更少空间和更少电力的同时,提供了比其他系统更高的计算性能。尽管GPU的功耗每一代都在翻倍,但CS-3的性能却翻了一番,同时仍保持在相同的功耗范围内。CS-3还提供了卓越的易用性,对于大型语言模型,其所需的代码量比GPU少97%,并能够在纯数据并行模式下训练从1B到24T参数的模型。值得一提的是,在Cerebras上,实现GPT-3规模的模型标准实现仅需要565行代码,这一数字创下了行业纪录。

费尔德曼表示:“我们的系统支持最多24万亿参数的模型。”

行业合作与客户动力

Cerebras已经收到了来自企业、政府和国际云服务的大量CS-3订单。

阿贡国家实验室计算、环境和生命科学部副主任里克·史蒂文斯在一份声明中表示:“我们从一开始就是Cerebras解决方案的早期客户,由于Cerebras晶圆级技术带来的100倍至300倍的性能提升,我们能够迅速加速我们的科学和医学AI研究。我们非常期待看到CS-3在相同功耗范围内实现双倍性能将为我们带来哪些新的突破。”

高通合作

本周,Cerebras还宣布了与高通开展新的技术和GTM合作,通过Cerebras在CS-3上提供的推理感知训练,实现AI推理性能提升10倍。

高通云计算副总裁拉希德·阿塔尔在一份声明中表示:“我们与Cerebras的技术合作旨在为客户提供最高性能的AI训练解决方案,同时结合最佳的性能/总拥有成本推理解决方案。此外,客户还可以获得完全优化的、可随时部署的模型,从而大幅缩短投资回报时间。”

通过使用Cerebras业界领先的CS-3 AI加速器进行训练,以及使用高通Cloud AI 100 Ultra进行推理,生产级部署可以实现高达10倍的价格性能提升。

费尔德曼指出:“我们很高兴宣布与高通建立全球合作伙伴关系,共同训练针对其推理引擎优化的模型。这一合作使我们能够采用一系列独特的技术和一些更广泛可用的技术,以大幅降低推理成本。因此,我们将训练模型,使它们能够通过多种不同策略加速推理。”

Cerebras拥有超过400名工程师。费尔德曼说:“按计划交付大量计算能力并不容易。我认为在这个领域没有其他公司能做到像我们这样。过去六个月里,没有其他初创公司能够像我们一样交付如此多的计算能力。而且,与高通合作,我们正在推动降低推理成本。”