AI角色与虚拟形象:内容创作的未来

像HeyGen和Argil.ai这样的公司所进行的工作,正在为内容创作与消费的新时代铺平道路,在这个时代,真实世界与虚拟世界的界限将变得越来越模糊。

过去的一年里,AI虚拟形象和合成视频技术飞速发展,HeyGen、Synthesia和D-ID等公司展示了创造栩栩如生的虚拟人物的有趣用例。这些虚拟形象有望彻底改变我们跨行业创建和消费内容的方式。

上周,HeyGen和新兴公司Argil.ai展示了各自技术的下一代成果,并推动了技术的最新发展。

首先,Argil.ai发布了Gesture 1.0,这是他们新的AI虚拟形象系统,让内容创作者能够创建包含手部动作的AI虚拟形象视频。在演示中,Argil.ai展示了AI虚拟形象行走、使用手势以及用多种语言以真实口音讲话的场景。该公司表示,他们即将开放产品和API,并正在寻找早期采用者来探索这项技术的潜力。

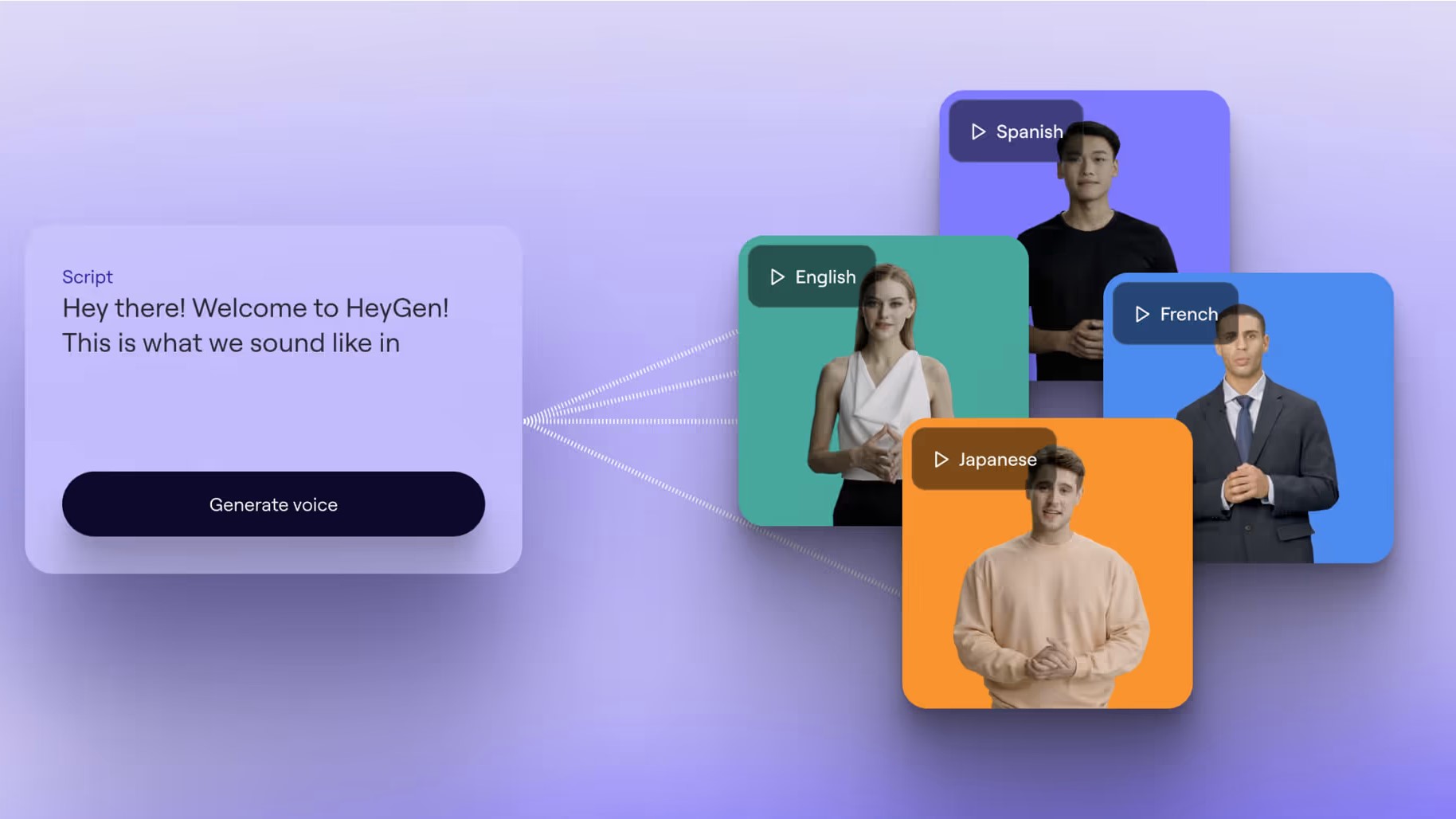

HeyGen也推出了具有类似功能的Avatar in Motion 1.0。HeyGen的虚拟形象已经以逼真的唇部同步和由OpenAI语音引擎支持的语音配音功能而闻名,现在它们可以在场景中移动、做出手势并使用独特的语调。该公司通过社交媒体分享了其“Nik”虚拟形象的示例,并创建了一个演示页面,任何人都可以提供脚本并生成自己的“Nik”视频。

值得注意的是,这些AI虚拟形象平台并不像Sora那样从头开始生成视频。相反,它们似乎正在使用AI来修改实际拍摄的画面,添加诸如唇部同步、AI语音和AI配音技术等功能。这种方法在确保高度真实性的同时,也充分利用了人工智能的力量。

AI虚拟形象的应用潜力巨大,横跨营销、教育、销售和沟通等多个领域。例如,公司可以创建具有AI虚拟形象的个性化营销内容,直接面向目标受众进行讲话。教育机构可以开发具有吸引力的培训材料,其中包含可以用多种语言沟通的虚拟讲师。销售团队可以利用AI虚拟形象创建引人入胜的产品演示和推销词。内容创作者还可以使用AI配音技术轻松地将视频本地化,以适应全球观众。

随着这些AI虚拟形象背后的技术不断发展,我们可以期待在未来不久将看到更加逼真和交互式的虚拟人物。因此,我们必须在社区内提高AI素养,并解决技术发展和使用过程中出现的问题。