苹果推出ReALM系统 可识别屏幕内容并互动

根据最近公布的一篇研究报告,苹果公司研究团队成功开发出了一款全新的人工智能系统。该系统能够识别屏幕上实体的模糊引用,并结合对话和背景上下文,从而与语音助手进行更为自然的互动。

这款名为ReALM(Reference Resolution As Language Modeling)的系统,利用大型语言模型,将复杂的引用解析任务——包括理解屏幕上的视觉元素引用——转化为纯语言建模问题。这种创新方法使得ReALM在性能上相较于现有技术有了显著的提升。

苹果研究团队在报告中写道:“对于对话助手而言,理解上下文和引用至关重要。让用户能够就屏幕上的内容提出问题,是确保语音助手提供真正免提体验的关键步骤。”

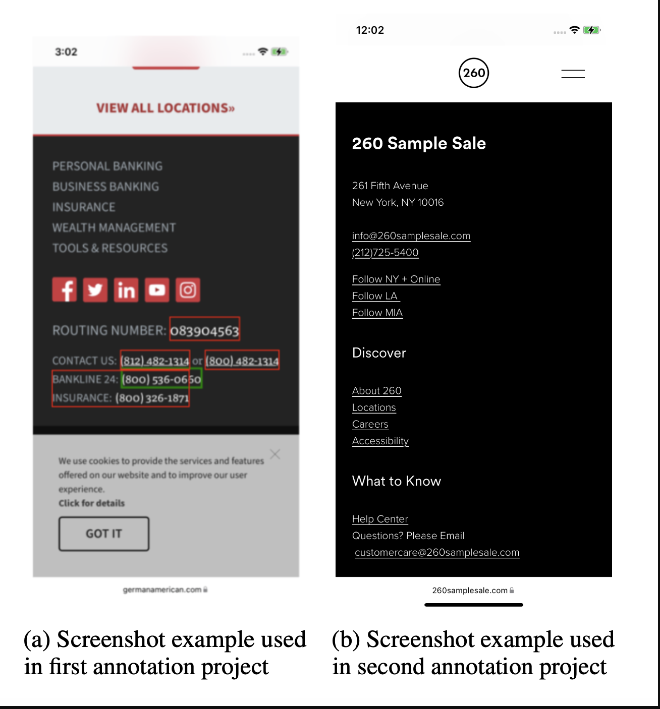

ReALM的一大创新之处在于,它能够通过解析屏幕上的实体及其位置,重构屏幕信息,生成一个能够捕捉视觉布局的文本表示。研究人员发现,这种方法与专门用于引用解析的语言模型微调相结合,在任务表现上超越了GPT-4。

报告指出:“我们在不同类型的引用上展示了与现有系统的巨大改进,我们的最小模型在屏幕引用上获得了超过5%的绝对增益。而我们的大型模型在性能上大幅超越了GPT-4。”

然而,研究人员也提醒说,依赖对屏幕的自动化解析存在局限性。对于更复杂的视觉引用,如区分多张图片,可能还需要结合计算机视觉和多模态技术。

尽管苹果在快速发展的AI领域一度落后于技术竞争对手,但其在人工智能研究方面的进展正悄然加快。

从融合视觉和语言的多模态模型,到AI驱动的动画工具,再到以预算构建高性能专用AI的技术,苹果研究实验室不断取得突破性成果,显示出其AI雄心正在迅速提升。

然而,作为以保密著称的科技巨头,苹果正面临着来自谷歌、微软、亚马逊和OpenAI等公司的激烈竞争。这些公司已在搜索、办公软件、云服务等多个领域积极推出生成式AI产品。

长期以来,苹果一直扮演着快速跟进者的角色,而非开拓者。然而,如今它正面临着一个由人工智能以惊人速度改造的市场。在备受瞩目的6月全球开发者大会上,预计苹果将推出一款新的大型语言模型框架、“苹果GPT”聊天机器人以及其生态系统中其他由AI驱动的功能。

苹果首席执行官蒂姆·库克在最近的财报电话会议上暗示:“我们很高兴在今年晚些时候分享我们在AI领域的持续工作详情。”尽管苹果一直以其保密性著称,但显然其在AI方面的努力正席卷而来,范围广泛。

然而,随着AI霸主地位争夺战的升温,这位iPhone制造商的姗姗来迟已使其处于了一个不常见的弱势地位。虽然雄厚的资金、品牌忠诚度、精英工程师和紧密集成的产品组合为其提供了反击的机会,但在这场高风险的竞赛中,没有什么是绝对的。

一个新时代即将来临,这个时代将充满无处不在、真正智能的计算。到了6月,我们将看到苹果是否做得足够多,以确保其在塑造这一新时代中占据一席之地。