Reka发布多模态语言模型Core,性能领先行业

AI初创公司Reka近期发布了其最新、最尖端的多模态语言模型——Core。这款Core模型与Reka现有的Flash模型(参数达210亿个)和Edge模型(参数达70亿个)共同构成了Reka的模型矩阵。Reka将Core模型誉为前沿水平的模型,它在涉及文本、图像、视频和音频的广泛任务中展现了行业领先的性能。

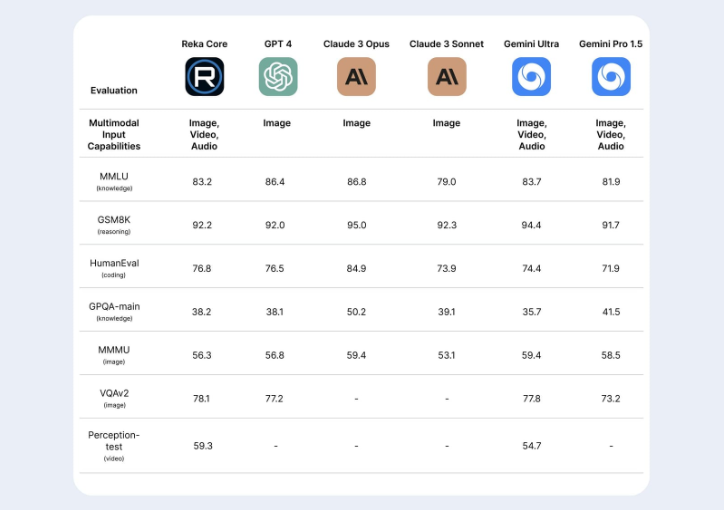

根据Reka的技术报告,Core模型主要在NVIDIA H100s上利用PyTorch进行从零开始的训练。值得注意的是,Reka表示该模型尚未完成训练,仍在持续优化中。然而,从现有的流行基准测试结果来看,该模型的表现与OpenAI、Anthropic和Google的领先模型相当,甚至在某些方面更胜一筹。该模型展现出卓越的推理能力,包括复杂的语言和数学能力,使其成为进行复杂分析和解决问题的理想选择。

Core模型的一个显著特点是其先进的多模态理解能力。与众多主要关注文本的大型语言模型不同,Core模型对图像、视频和音频具有深入且情境化的理解。这使得它成为市面上仅有的两个提供全面多模态支持的商业解决方案之一。

此外,Core模型还拥有令人瞩目的128K上下文窗口,使其能够摄入并准确回忆比许多竞争对手更多的信息。结合其卓越的语言和数学推理能力,这使得Core模型非常适合处理复杂且需要深入分析的任务。

对于开发人员来说,Core模型顶级的代码生成能力为赋能自主化工作流程带来了激动人心的可能性。该模型的多语言技能同样令人印象深刻,能够流利地使用英语以及几种亚洲和欧洲语言,这得益于它对32种语言的文本数据进行的预训练。

与Reka的其他模型一样,Core可以通过API、本地部署或设备端部署来满足客户和合作伙伴的多样化需求。这种灵活性,加上Core令人瞩目的能力,为电子商务、社交媒体、数字内容、医疗保健和机器人技术等行业解锁了广泛的潜在应用场景。

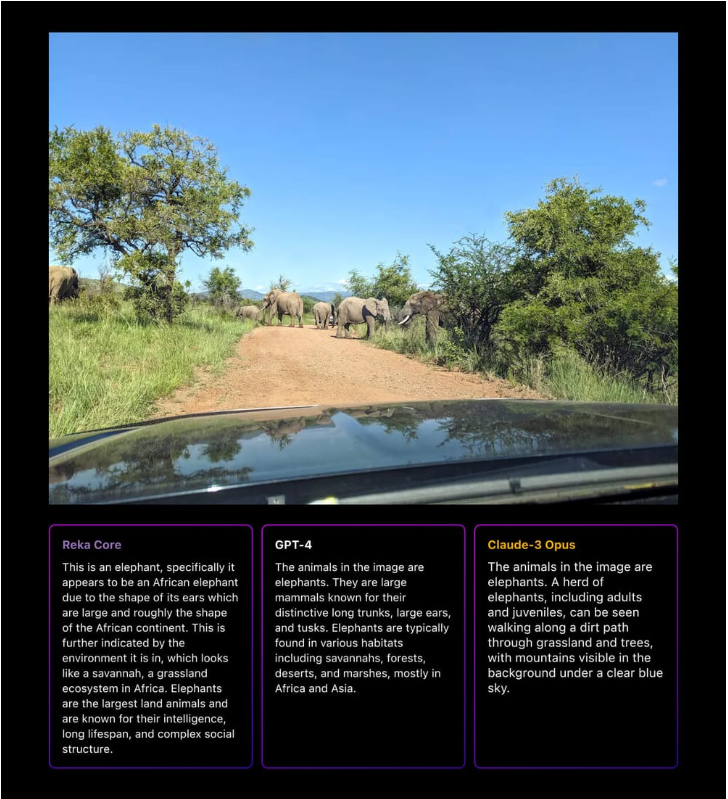

Reka提供了一个页面,其中包含多个示例,比较了Core的输出与GPT-4和Claude 3 Opus的输出。你也可以使用他们的聊天机器人来探索他们这三个模型的能力。