VideoGigaGAN:视频超分辨新突破,8倍放大更清晰

Adobe的科研人员最新推出了名为VideoGigaGAN的生成式人工智能模型,这款模型能够在保持视频精细细节的同时,确保帧间时间的一致性,并成功将视频放大至高达8倍。VideoGigaGAN是在大型图像放大器GigaGAN的成功经验之上进行研发的,其主要目标是将同样出色的细节丰富放大技术应用于视频处理,同时又不牺牲时间稳定性。

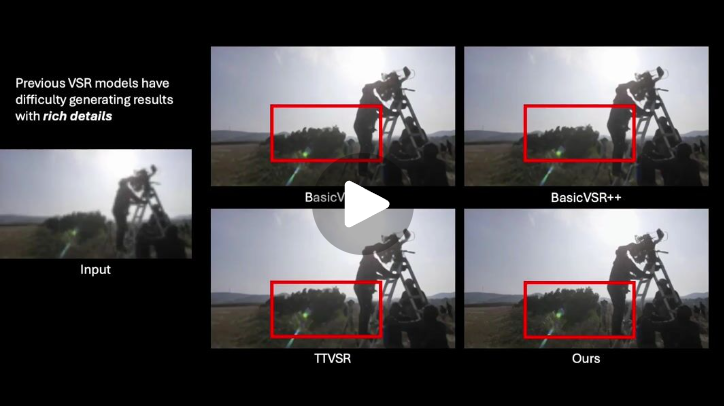

在视频超分辨率(VSR)领域,一个关键挑战是在维持输出帧间一致性的同时,生成高清的细节。虽然过去的VSR方法已经展现出了优秀的时间一致性,但由于其生成能力有限,它们往往会产生比对应图像更为模糊的结果。而VideoGigaGAN通过调整强大的GigaGAN架构以适应视频放大,直接解决了这一问题。

研究人员在实验中发现,仅仅通过在解码器块中添加时间模块将GigaGAN扩展为视频模型,会导致严重的时间闪烁现象。为了解决这一问题,他们深入剖析了多个关键问题,并提出了显著提高放大视频时间一致性的技术。这些技术包括:

- 在解码器块中引入具有时间注意力层的GigaGAN,以加强时间一致性;

- 整合来自流导向传播模块的特征,以增强帧间一致性;

- 在编码器的下采样层中使用抗混叠块,以抑制混叠伪影;

- 通过跳跃连接直接将高频特征传输到解码器层,以补偿BlurPool过程中的细节损失

当然,方法固然重要,但我们更关心的是实际效果。他们的研究显示,与最先进的VSR方法相比,VideoGigaGAN在保持时间一致性的同时,生成的视频外观细节更为精细。研究人员通过对比公共数据集上的VideoGigaGAN与领先的VSR模型,并展示了令人震撼的8倍超分辨率视频结果,验证了VideoGigaGAN的卓越性能。

消融研究还表明,图像GigaGAN强大的生成能力导致了时间闪烁伪影,尤其是在处理低分辨率输入时,混叠现象尤为明显。通过提出的技术手段解决这些问题后,VideoGigaGAN在细节丰富的放大和时间一致性之间实现了显著的平衡。

VideoGigaGAN无疑代表了视频超分辨率领域的重大突破,进一步推动了生成式人工智能的可能性边界。其能够在保持细节和时间稳定性的同时,将视频放大高达8倍,为改善低分辨率视频内容提供了新的可能性。随着各行业对高质量视频需求的不断增长,VideoGigaGAN有望彻底改变我们处理和消费视频媒体的方式。

然而,研究仍在进行中,尚有许多挑战需要克服。例如,VideoGigaGAN在处理超长视频和小物体时仍面临一定的挑战。未来的研究可以集中在改进光流估计和处理诸如文本和字符等小细节上,以进一步提升VideoGigaGAN的性能和适用性。