微软推出轻量级AI模型Phi-3 Mini,可在手机上本地运行

在人工智能领域,微软再次展现其创新实力,今日推出了轻量级AI模型Phi-3 Mini的最新版本,这是该公司计划发布的三个小型模型中的首个,标志着AI技术在小型化、高效化方面取得了新的突破。

Phi-3 Mini拥有38亿参数,相较于市场上的一些大型语言模型如GPT-4,它在较小的数据集上进行了训练,从而实现了更高效的性能。如今,这款先进的模型已可在Azure、Hugging Face和Ollama等平台上使用,为广大开发者提供了更多选择。

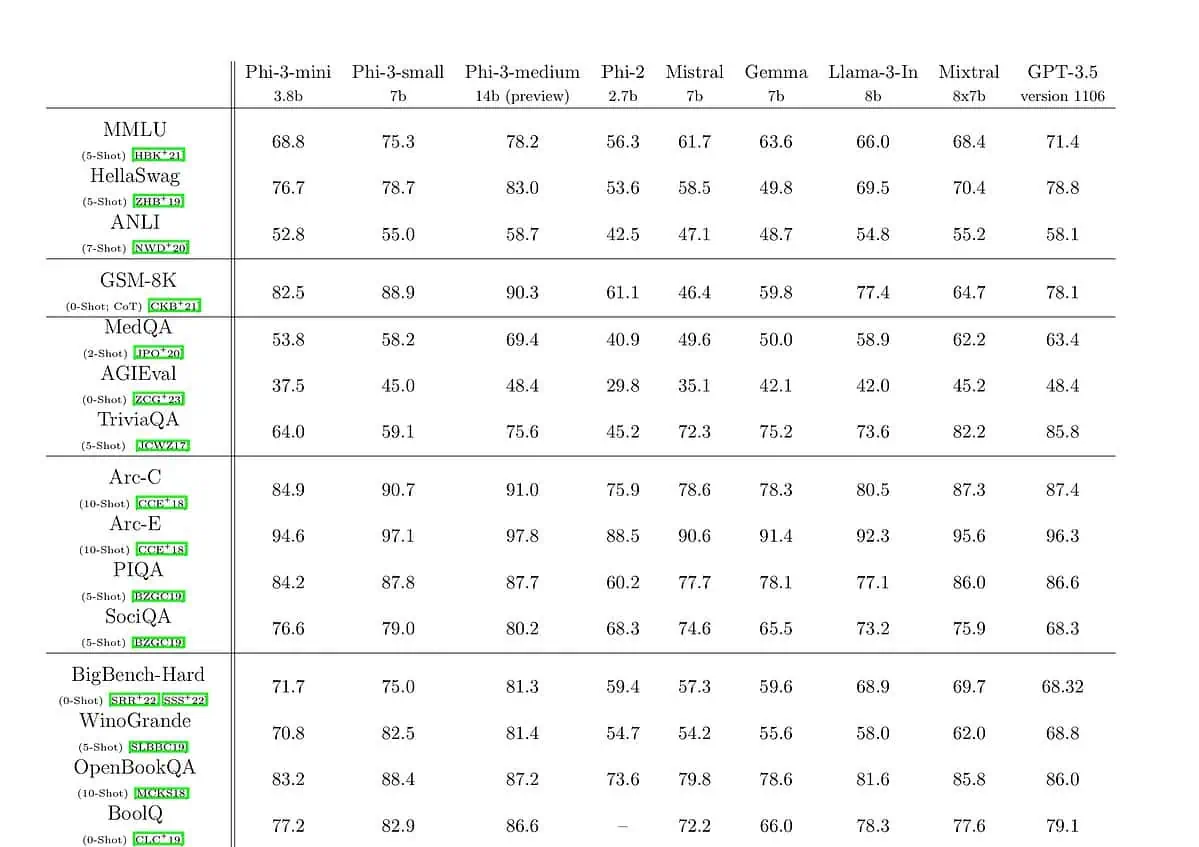

微软对于Phi-3系列的研发有着明确的规划,除了已经发布的Phi-3 Mini,公司还计划推出参数分别为70亿和140亿的Phi-3 Small和Phi-3 Medium。参数数量是衡量模型处理复杂指令能力的重要指标,这三个模型的陆续推出,将满足不同场景和需求的开发者。

值得一提的是,微软在去年推出的Phi-2模型已经展现出了与大型模型相当的性能。而据微软透露,Phi-3的性能相较于前代模型有了显著的提升,其响应能力已接近那些规模比它大10倍的模型,这无疑将为开发者带来更加出色的体验。

微软Azure AI平台的企业副总裁Eric Boyd在接受采访时表示,Phi-3 Mini的能力与大型语言模型相当,但它在更小的形态因素中实现了这一点。这一优势使得Phi-3 Mini在个人设备如手机和笔记本电脑上的运行效果更佳,同时也降低了使用成本。

此外,微软在轻量级AI模型领域的布局远不止于此。外媒今年早些时候报道指出,微软正组建一个专门致力于轻量级AI模型研发的团队。除了Phi系列,微软还开发了Orca-Math等专注于特定领域的模型,进一步丰富了其AI产品线。

在市场竞争方面,微软的竞争对手也推出了各自的小型AI模型。然而,与谷歌、Anthropic和Meta等公司的小型模型相比,Phi-3 Mini在性能和功能方面均表现出色。同时,由于其较小的形态和较低的成本,Phi-3 Mini更适合用于定制应用程序和内部数据集较小的企业。

Boyd还透露了Phi-3的训练过程。开发人员采用了一种创新的“课程”方法,受到儿童如何从睡前故事中学习的启发。这种方法使得Phi-3能够更好地理解复杂主题,并在实际应用中展现出卓越的性能。

展望未来,随着人工智能技术的不断发展,小型化、高效化将成为行业发展的重要趋势。而微软作为AI领域的领军企业,其推出的Phi-3 Mini无疑将为这一趋势注入新的动力。我们期待微软在未来能够继续推出更多创新性的产品和技术,为人工智能领域的发展做出更大的贡献。