微软发布多模态小型AI模型Phi-3-vision

2024年05月22日 由 daydream 发表

343

0

在2024年的Microsoft Build大会上,微软这家科技巨头宣布了其小型开放模型Phi-3家族的新成员。其中,特别引人关注的是Phi-3-vision,这是一个融合了语言和视觉能力的多模态模型。这款拥有42亿参数的模型能从图表和示意图中生成见解,为各种应用提供了强大的工具支持。

重点如下:

- Phi-3-vision:这是一个结合了语言和视觉能力的多模态模型,它能够从文本和图像(包括图表和示意图)中理解并生成见解。

- Phi-3-small和Phi-3-medium:这两款之前宣布的模型现已在Microsoft Azure上上线,为开发人员提供了构建生成式AI应用程序的强大工具。

- Phi-3-mini:作为Phi-3家族的首个模型,现在也已通过Azure AI的模型即服务提供,让用户更容易上手。

Phi-3-vision模型特别擅长处理如光学字符识别(OCR)、图表分析和示意图理解等任务。它被设计用来处理并推理现实世界中的图像,为处理视觉数据的开发人员提供了重要的工具。

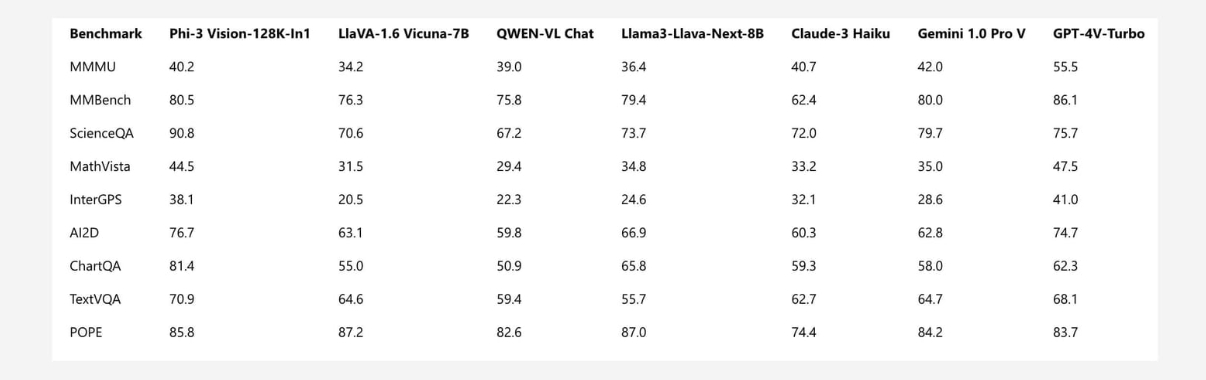

Phi-3模型在性能和成本上都表现出色,相比更大的语言模型有着显著的优势。例如,Phi-3-small的表现超越了其规模两倍的模型,包括GPT-3.5 Plus,尽管它仅有70亿个参数。Phi-3-vision也延续了这一趋势,在视觉推理任务中超越了如Claude-3 Haiku和Gemini 1.0 Pro V等更大的模型。

Phi-3模型的紧凑设计使得它们可以部署在设备上,实现无需网络连接的低延迟AI体验,因此成为了理想的选择。此外,这些模型还具有更高的成本效益。据微软GenAI研究副总裁Sébastien Bubeck表示,Phi-3的成本“大大降低了”。

随着可用模型的不断发展,选择合适的模型将取决于特定的用例和业务需求。Phi-3家族的扩展为开发人员提供了一组多功能的工具,用于构建生成式AI应用程序。Phi-3模型在性能、成本效益和多功能性方面的优势使其成为广泛用例的理想选择,充分展示了小型语言模型在AI领域中的巨大潜力。

文章来源:https://www.maginative.com/article/microsoft-unveils-phi-3-vision-and-expands-phi-3-model-availability-on-azure/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消