SOFTS:利用序列核心融合实现高效的多元时间序列预测

介绍

本文有两个主要贡献: SOFT 和 STAD

SOFT

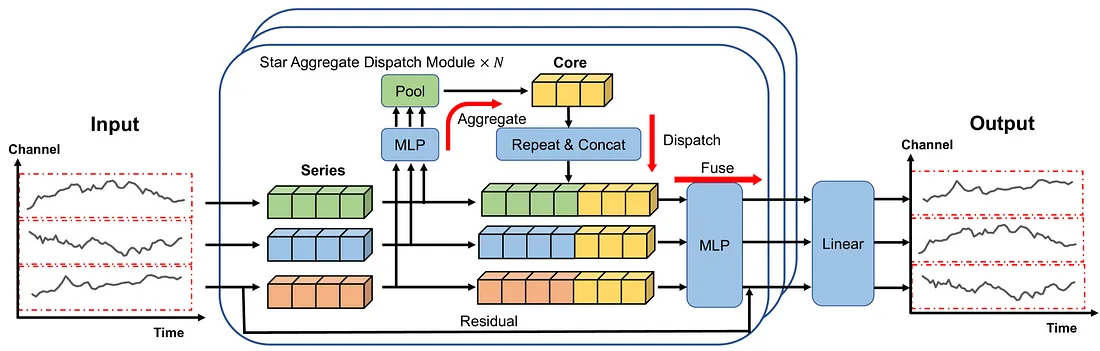

SOFT:Series-cOre 融合时间序列预测器

它专为多变量时间序列预测而设计,使用 STAD 模块来平衡信道独立性和相关性。这有助于通过将信道交互集中到一个全局核心表征中,以线性复杂度实现卓越性能。

STAD

STAD:STar Aggregate Dispatch 模块

STAD 是 SOFT 的基础,而 SOFT 是一个基于 MLP 的简单模型。STAD 是一种集中式结构,可捕捉多变量时间序列中通道之间的依赖关系。结果表明,这种方法既有效又可扩展。

可逆实例规范化

研究人员使用的这种方法改编自 ITRANSFORMER 论文,将归一化视为一个超参数。

iTransformer 中的可逆实例归一化只需在反转维度上应用注意力和前馈网络,从而使模型能够捕捉多变量相关性并有效学习非线性表征。

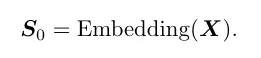

系列嵌入

序列嵌入没有补丁嵌入那么复杂,可以说是将补丁长度设置为整个序列的长度。研究人员使用线性投影将每个通道的序列嵌入到 So 中:

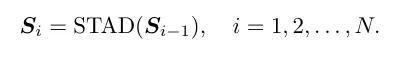

STAR Aggregate Dispatch(STAD)模块

我们通过多个 STAD 模块来完善序列嵌入:

线性预测器

如果 S_N 是第 n 层的输出表示,则预测结果如下:

星形汇总调度模块

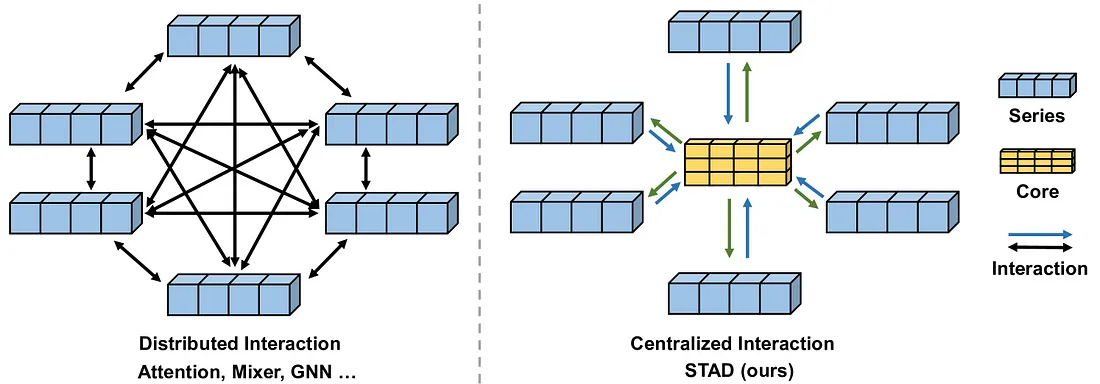

STAR Aggregate Dispatch(STAD)模块是一种集中式机制,旨在捕捉多变量时间序列预测中通道之间的依赖关系。传统的分布式结构(如注意力机制)会直接比较每对通道的特征,从而导致二次复杂性,而 STAD 与之不同,通过采用集中式策略将复杂性降至线性。它将来自所有序列的信息汇总到一个全局核心表征中,然后将核心信息分派回各个序列表征,从而实现高效的信道交互,并提高对异常信道的鲁棒性。

这种集中式结构的灵感来自软件工程中的星形系统,即由中央服务器汇总和交换信息,而不是在客户端之间进行直接的点对点通信。这种设计使 STAD 既能保持信道独立性的优势,又能捕捉必要的相关性以提高预测精度。通过将信道统计汇总到一个单一的核心表示中,STAD 降低了依赖非平稳时间序列中可能不可信的相关性的风险。

实证结果表明,STAD 模块不仅实现了优于现有先进方法的性能,而且大大降低了计算需求。这使得它可以扩展到具有大量通道或较长回看窗口的数据集,而这正是许多其他基于变压器的模型所面临的挑战。此外,STAD 模块的通用性使其可以在各种基于变压器的模型中替代注意力机制,进一步验证了其效率和有效性。

STAD 的输入是每个通道的序列表示,通过 MLP 进行处理,然后进行池化(这里是随机池化):

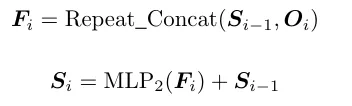

现在,我们计算了核心表示 (O),然后将核心和所有序列的表示融合在一起:

Repeat_Concat 将核心表示 O 与每个序列表示连接起来,得到 Fi。然后,我们将 Fi 交给另一个 MLP,并将输出添加到上一个隐藏维度,以计算下一个隐藏维度。

计算结果

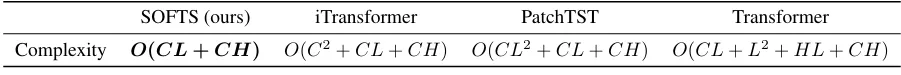

虽然这种方法看起来很简单,但它大大降低了复杂度(从二次方到线性),这非常好。

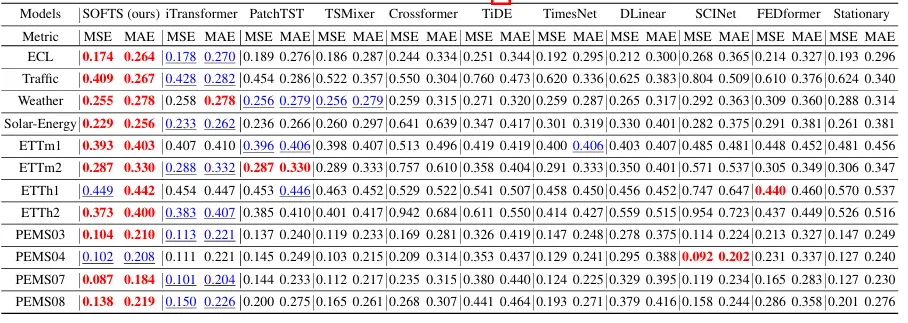

研究人员对各种数据集进行了实验,并与大多数前人进行了比较,如你所见: