Cohere For AI发布Aya-23模型,引领多语言NLP技术新篇章

2024年05月24日 由 neo 发表

626

0

近日,AI领域领军企业Cohere For AI宣布推出革命性的Aya-23模型系列,该系列旨在显著提升自然语言处理(NLP)中的多语言能力,为全球化时代的语言交互带来新可能。

传统模型在处理不同语言时,往往依赖于大量的训练数据和资源,以应对语言间的多样化语法、语义和上下文差异。随着全球化趋势加剧,多语言应用的需求日益增长,这一挑战变得愈发严峻。

在NLP领域,基于变换器的模型如BERT和GPT等,借助深度学习技术,在理解和生成文本方面取得了显著成就。然而,这些模型在跨语言处理方面仍有提升空间,通常需要经过微调才能在不同语言中达到理想性能。但微调过程往往资源密集且耗时,限制了这些模型的可扩展性和普及性。

为了增强NLP中的多语言能力,Cohere For AI的研究人员推出Aya-23模型系列。这一系列包括拥有80亿和350亿参数的模型,是目前最大、最强大的多语言模型之一。它们具有以下特点:

- · Aya-23-8B:拥有80亿参数,是高效的多语言文本生成模型。支持23种语言,包括阿拉伯语、中文、英语、法语、德语和西班牙语等,并针对这些语言进行了优化,以生成准确、上下文相关的文本。

- · Aya-23-35B:包含350亿参数,具有更强大的能力来处理复杂的多语言任务。同样支持23种语言,并在生成文本时保持高度的一致性和连贯性。这使得它特别适用于需要高精度和广泛语言覆盖的应用场景。

Aya-23模型采用了优化的变换器架构,能够根据输入提示生成高精度、连贯的文本。它们还经历了一个独特的指令微调(IFT)过程,使模型更能有效地遵循人类指令,从而在多种语言中产生连贯、上下文适当的响应。这一过程对于提升模型在训练数据较少语言中的性能尤为关键。

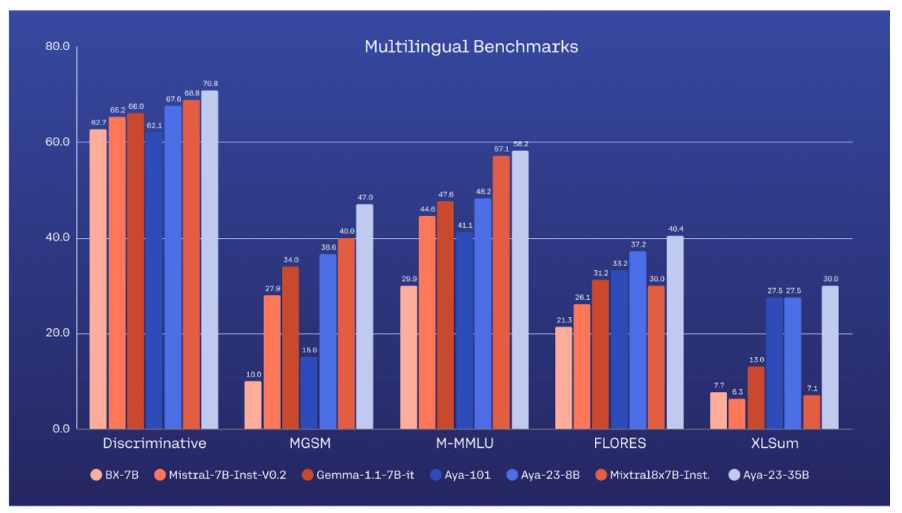

经过全面评估,Aya-23模型在多语言文本生成方面展现出了卓越的性能。无论是80亿参数还是350亿参数的模型,在支持的所有23种语言中,都能生成准确、上下文相关的文本,并在生成的文本中保持了一致性和连贯性。这对于翻译、内容创作、对话代理等应用来说至关重要。

文章来源:https://www.marktechpost.com/2024/05/23/cohere-ai-releases-aya23-models-transformative-multilingual-nlp-with-8b-and-35b-parameter-models/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消