英伟达发布Blackwell架构 加速AI创新

英伟达(Nvidia)首席执行官黄仁勋在Computex展会上宣布,全球领先的计算机制造商已推出搭载英伟达Blackwell架构的系统。该系统集成了Grace CPU、英伟达的网络技术以及基础设施,旨在助力企业构建AI工厂和数据中心。

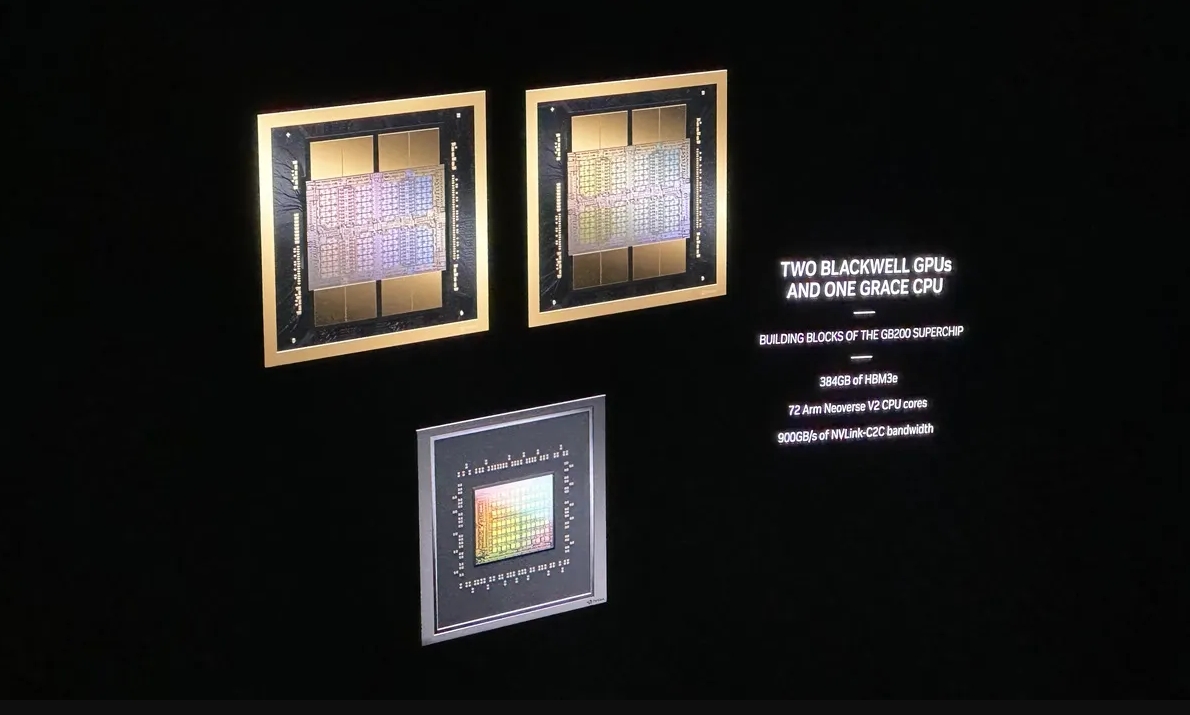

英伟达Blackwell图形处理单元(GPU)在AI处理任务上实现了高达25倍的能效提升,并降低了成本。而英伟达GB200 Grace Blackwell超级芯片,通过在一个封装中集成多个芯片,为大型语言模型(LLM)推理工作负载带来了高达30倍的性能飞跃,相比前代产品有着显著的突破。

黄仁勋表示,为推动下一轮生成式AI的快速发展,包括ASRock Rack、华硕(Asus)、技嘉(Gigabyte)、英业达(Ingrasys)、英业达集团(Inventec)、和硕(Pegatron)、广达(QCT)、超微(Supermicro)、纬创(Wistron)和纬颖(Wiwynn)在内的多家企业,将利用英伟达GPU和网络技术,提供云、本地、嵌入式和边缘AI系统。

黄仁勋在声明中指出:“新一轮的工业革命已拉开序幕。各大公司和各国正与英伟达携手,将价值万亿美元的传统数据中心转变为加速计算中心,并构建新型的AI工厂,以生产新型商品——人工智能。从服务器、网络和基础设施制造商到软件开发者,整个行业都在为Blackwell的发布做好准备,加速各个领域的AI创新。”

为了满足不同应用的需求,这些产品将覆盖从单个到多GPU、从x86到基于Grace的处理器,以及从风冷到液冷技术的全面选择。

此外,英伟达(Nvidia)的MGX模块化参考设计平台现已支持Blackwell产品,以加快不同大小和配置的系统开发速度。其中,新的英伟达GB200 NVL2平台为主流大型语言模型推理、检索增强生成和数据处理提供了无与伦比的性能。

华硕(Asus)董事长施崇棠在声明中表示:“华硕与英伟达合作,通过我们强大的服务器系列将企业级AI推向新的高度,我们将在COMPUTEX上展示这些产品。借助英伟达的MGX和Blackwell平台,我们能够打造量身定制的数据中心解决方案,以应对客户在训练、推理、数据分析和高性能计算(HPC)方面的工作负载。”

GB200 NVL2特别适用于新兴的市场机会,如数据分析,企业每年在这方面的投入高达数十亿美元。借助Blackwell架构提供的NVLink-C2C互连的高带宽内存性能和专用解压缩引擎,数据处理速度提高了高达18倍,能效相比x86 CPU提升了8倍。

英伟达MGX模块化参考架构旨在满足全球数据中心多样化的加速计算需求。它为计算机制造商提供了一种参考架构,使其能够迅速且经济高效地构建超过100种系统设计配置。

制造商可以从服务器底盘的基本系统架构开始,然后根据不同的工作负载选择GPU、DPU和CPU。迄今为止,已有超过90个系统来自超过25个合作伙伴发布或正在开发中,这些系统均采用了MGX参考架构,而去年仅有来自六个合作伙伴的14个系统。使用MGX可以帮助将开发成本降低多达四分之三,并将开发时间缩短三分之二,仅需六个月。

AMD和英特尔(Intel)也在支持MGX架构,并计划首次推出他们自己的CPU主机处理器模块设计。这包括下一代AMD Turin平台和采用P核(原名Granite Rapids)的Intel® Xeon® 6处理器。任何服务器系统构建者都可以利用这些参考设计来节省开发时间,同时确保设计和性能的一致性。

英伟达最新的GB200 NVL2平台也采用了MGX和Blackwell技术。其可扩展的单节点设计使得各种系统配置和网络选项能够无缝集成到现有的数据中心基础设施中。

GB200 NVL2加入了Blackwell产品线,其中包括英伟达Blackwell Tensor Core GPU、GB200 Grace Blackwell超级芯片和GB200 NVL72,为企业级AI应用提供了强大的硬件支持。