昆仑万维开发新算法Q* 提升大型语言模型推理能力

2024年06月25日 由 daydream 发表

429

0

近日,昆仑万维携手新加坡南洋理工大学宣布了一项重大突破,他们成功开发了一种名为Q*的新型算法,该算法能够显著提升现有大型语言模型(LLMs)的推理能力。这一创新成果不仅打破了OpenAI的技术封锁,还为人工智能的广泛应用开辟了新的道路。

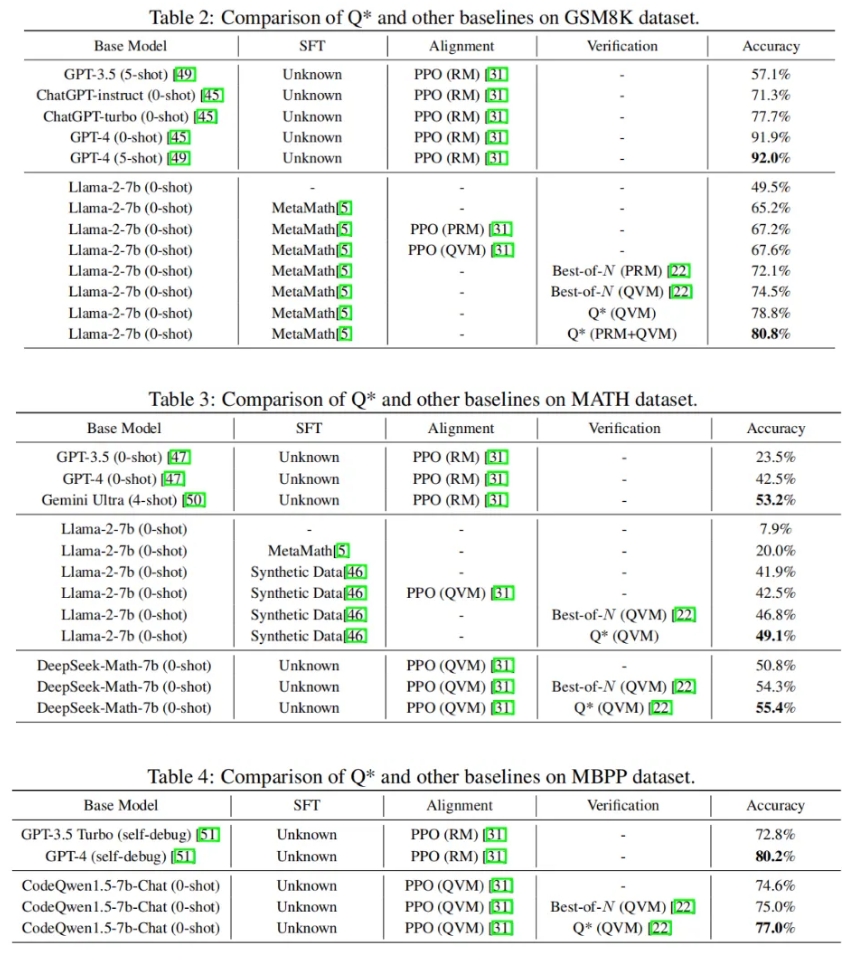

Q算法在多个数据集上展现出了强大的推理性能。在GSM8K数据集上,Q帮助Llama-2-7b模型将准确率提升至80.8%,超越了ChatGPT的表现。在MATH数据集上,Q则助力DeepSeek-Math-7b模型达到了55.4%的准确率,超越了Gemini Ultra。此外,在MBPP数据集上,Q也帮助CodeQwen1.5-7b-Chat模型缩小了与GPT-4在编程水平上的差距,达到了77.0%的准确率。

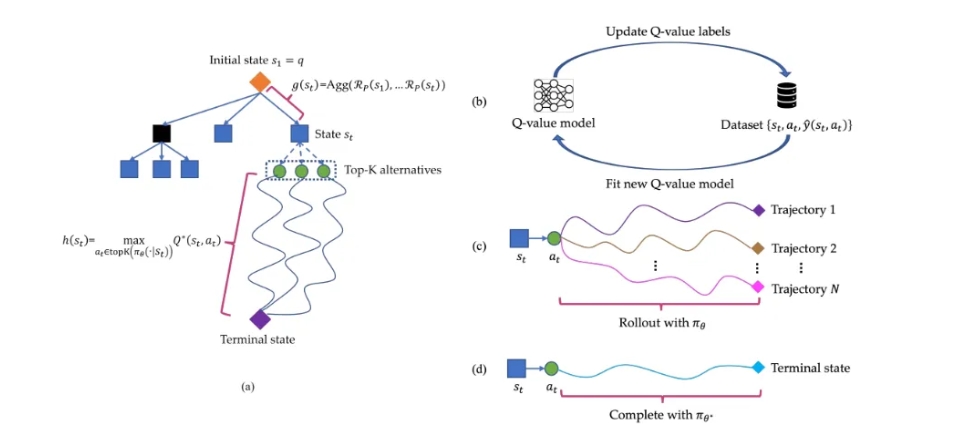

据了解,Q*算法的核心在于将大语言模型的推理轨迹分解为多个状态,并通过集成历史状态收益和未来期望收益的方式,实现对复杂推理任务的全盘规划。这种全新的框架不仅大幅提升了小模型的性能,还显著降低了计算资源的需求,为人工智能的广泛应用带来了全新可能。

在《Q*: Improving Multi-step Reasoning for LLMs with Deliberative Planning》的论文中,研究人员详细阐述了Q算法的工作原理和实验过程。他们通过监督学习的方式训练了一个代理Q值模型,并采用了A搜索算法对状态进行最佳优先搜索,从而实现了对推理任务的高效处理。

昆仑万维的这一突破不仅展示了其在人工智能领域的深厚实力,也为国内开源模型的发展注入了新的活力。随着Q*算法的进一步完善和应用,我们有理由相信,未来国产开源模型将在更多领域展现出强大的竞争力。

文章来源:https://mp.weixin.qq.com/s/oYISyTzk0wn2PvQkaTKrSQ

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消