Mistral发布旗下最新最强小模型 Mistral NeMo

Mistral AI携手NVIDIA震撼推出NeMo,这款拥有120亿参数的模型,以其庞大的128,000个标记的上下文窗口,在同类模型中脱颖而出,自诩在推理能力、世界知识掌握及编码准确性上均达到了行业顶尖水平。

此次Mistral AI与NVIDIA的强强联合,不仅推动了技术性能的极限,还极其注重用户体验的便捷性。Mistral NeMo被精心打造为Mistral 7B系统的无缝升级选项,得益于其兼容标准架构的设计,让转换变得轻而易举。

为了促进技术的广泛应用与深入研究,Mistral AI慷慨地将预训练的基础模型及指令调优的检查点以Apache 2.0许可协议公开,这一开源举措预计会吸引众多研究学者及企业界的目光,有望加速NeMo模型在多样化应用场景中的融合与创新。

尤为值得一提的是,Mistral NeMo在训练过程中融入了量化感知技术,使得模型在采用FP8进行推理时,性能依然保持卓越,这对于追求高效部署大型语言模型的企业而言,无疑是一大福音。

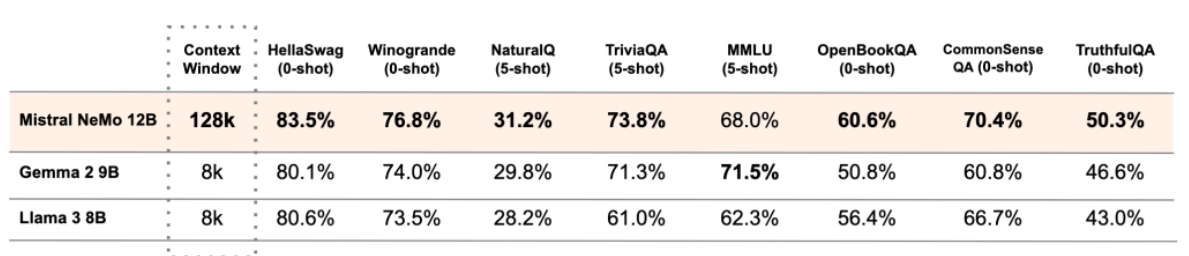

Mistral AI还自信满满地展示了NeMo与Gemma 2 9B及Llama 3 8B等近期热门开源预训练模型的性能比拼结果,进一步彰显了其竞争力。

该模型以全球多语言应用为设计初衷,特别强化了对函数调用、大规模上下文处理的能力,并在英语、法语、德语、西班牙语、意大利语、葡萄牙语、中文、日语、韩语、阿拉伯语及印地语等广泛语言中表现出色。Mistral AI表示,这是推动前沿AI模型普及,覆盖全球人类文化的又一重要里程碑。

此外,Mistral NeMo引入了Tekken这一基于Tiktoken的创新分词器,它经过超过100种语言的训练,相比传统的SentencePiece分词器,在文本和源代码的压缩效率上实现了显著提升,特别是在韩语和阿拉伯语等语言上表现尤为抢眼。Tekken在约85%的语言文本压缩上优于Llama 3分词器,预示着Mistral NeMo在多语言处理领域的强大潜力。

目前,Mistral NeMo的模型权重已登陆HuggingFace平台,包括基础版与指令调优版,供开发者们探索与试用。同时,Mistral AI还提供了mistral-inference和mistral-finetune工具,方便用户快速上手与定制化开发。对于Mistral平台的用户而言,该模型可通过特定名称直接访问。

作为与NVIDIA合作的又一成果,Mistral NeMo还被封装为NVIDIA NIM推理微服务,用户可通过NVIDIA官方网站轻松获取,这一举措无疑为已深耕NVIDIA AI生态系统的企业简化了部署流程,加速了AI技术的落地应用。

Mistral NeMo的发布,标志着高级AI模型民主化进程中的又一重要步伐。凭借其卓越的性能、全面的多语言支持及开放的源代码策略,Mistral AI与NVIDIA正携手将这款模型打造为跨行业、跨领域AI应用的强大基石。