Meta Llama 3.1横空出世,多项跑分超越OpenAI GPT-4o

近日,在备受瞩目的LocalLLaMA子Reddit讨论区内,一位热心的网友揭开了Meta最新力作——Llama 3.1的神秘面纱,分享了这款拥有惊人4050亿参数的AI模型的初步信息。这一爆料迅速在开源人工智能社区内引起轩然大波,标志着开源模型可能正式迈入挑战并超越当前顶尖闭源LLM(大型语言模型)的新纪元。

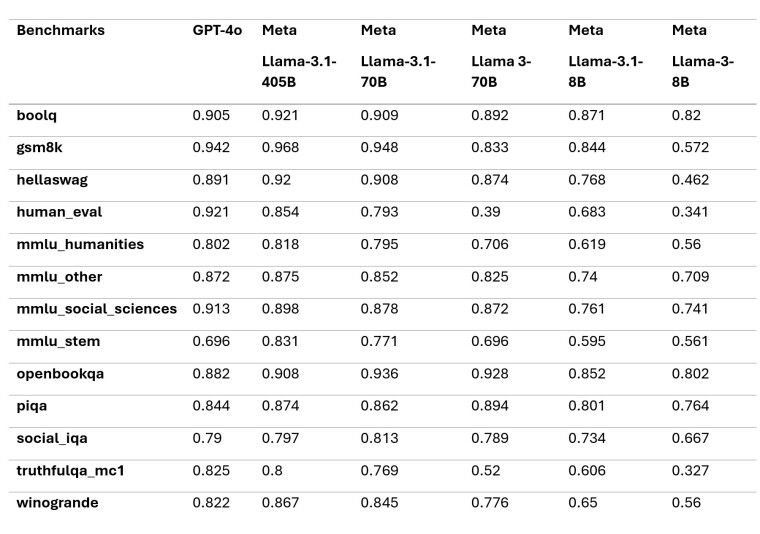

据该网友透露,Meta Llama 3.1在多项关键的AI基准测试中展现出了非凡的实力,成功超越了此前被视为行业标杆的OpenAI GPT-4o。这一突破性成就不仅彰显了Meta在AI技术领域的深厚积累,更为开源模型赢得了前所未有的关注与期待。

具体而言,Llama 3.1在GSM8K数学推理、Hellaswag常识推理、boolq问答系统、MMLU人文社科、MMLU其他领域以及MMLU STEM等多个测试项目中均取得了优于GPT-4o的成绩。这一系列亮眼的表现,无疑为开源AI社区注入了强大的信心与动力,预示着未来将有更多可能性被挖掘。

然而,值得注意的是,尽管Llama 3.1在多个领域大放异彩,但在HumanEval人类评估与MMLU社会科学等特定测试上,它仍暂时落后于GPT-4o。这一发现提醒我们,AI技术的竞争是一场永无止境的探索之旅,每一个进步都伴随着新的挑战与机遇。

尤为引人瞩目的是,当前展示的Llama 3.1性能数据仅基于其基本模型,意味着随着后续进一步的调整与优化,该模型的潜力有望被进一步释放,从而在更多基准测试中达到甚至超越现有最高水平。这对于整个AI行业而言,无疑是一个令人振奋的消息,预示着开源AI技术即将迎来更加辉煌的明天。

随着Meta Llama 3.1的横空出世,开源与闭源AI模型之间的竞争与合作也将迈入一个新的阶段。我们期待看到更多像Llama 3.1这样的优秀模型涌现,共同推动AI技术的不断进步与发展。