2024百度云智大会在京盛大召开,百度重磅升级AI基础设施与应用产品

备受瞩目的2024百度云智大会在北京圆满召开,大会聚焦人工智能领域的最新进展与未来趋势。百度智能云在此次盛会上宣布了对两大核心AI基础设施——百舸AI异构计算平台4.0与千帆大模型平台3.0的全面升级,并同步推出了代码助手、智能客服、数字人等三大AI原生应用产品的全新版本。

百度智能云事业群总裁沈抖在会上表示:“随着大模型技术的日益成熟,其产业应用正以前所未有的速度推进。截至目前,文心大模型在千帆平台上的日均调用量已突破7亿次大关,成功助力用户精调3万个大模型,并开发出超过70万个企业级应用。尤为值得一提的是,过去一年中,文心旗舰大模型的价格降幅超过90%,且主力模型已全面实现免费使用,极大地降低了企业应用AI的门槛。”

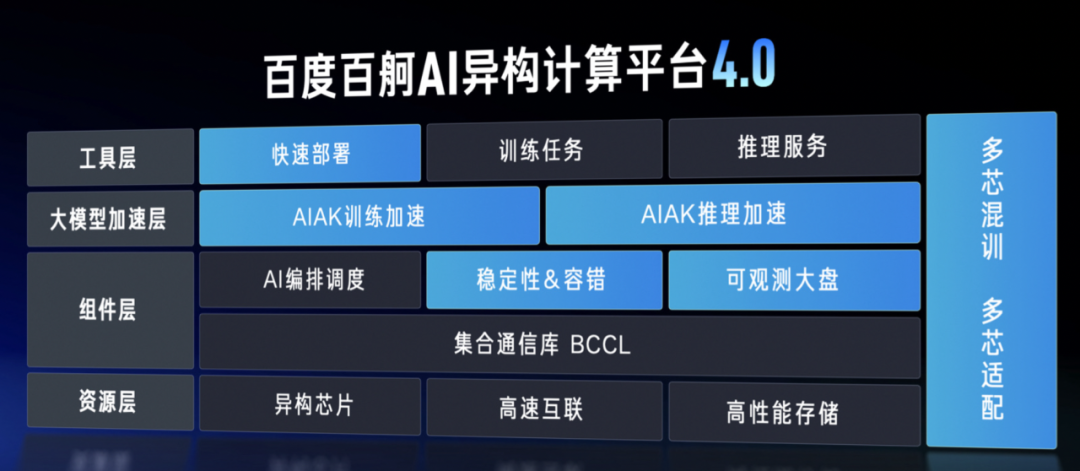

百舸4.0:算力新纪元,赋能大模型全旅程

为全面满足企业在部署大模型过程中的多样化算力需求,百度智能云推出了百舸AI异构计算平台4.0版本。该平台针对万卡乃至十万卡级别的超大规模集群进行了全面优化,实现了从集群创建、开发实验到模型训练、推理的全链条算力管理能力的提升。

在集群创建阶段,百舸4.0预装了主流大模型训练工具,实现了工具层面的秒级部署,将万卡集群的运行准备时间从数周缩短至仅1小时。而在开发实验阶段,其新升级的可观测大盘能够对多芯适配、集群效能、任务自动容错等方面进行全方位监测,助力企业快速制定最佳模型训练策略。

进入模型训练阶段,百舸4.0凭借自动筛查集群状态、预测GPU故障并即时转移工作负载的能力,显著降低了故障发生频次。同时,结合故障秒级感知定位、Flash Checkpoint等技术,进一步缩短了集群故障处置时间。目前,百舸在万卡集群上的有效训练时长占比已超过99.5%,整体性能较业界平均水平提升30%。

在模型推理环节,百舸4.0通过架构分离、KV Cache、负载分配等创新技术,实现了模型推理的降本提效,特别是在长文本推理方面,推理效率提升超过一倍。此外,该平台还构建了十万卡级别的无拥塞HPN高性能网络、10ms级别超高精度网络监控,以及面向十万卡集群的分钟级故障恢复能力,确保大模型应用的稳定性和高效性。

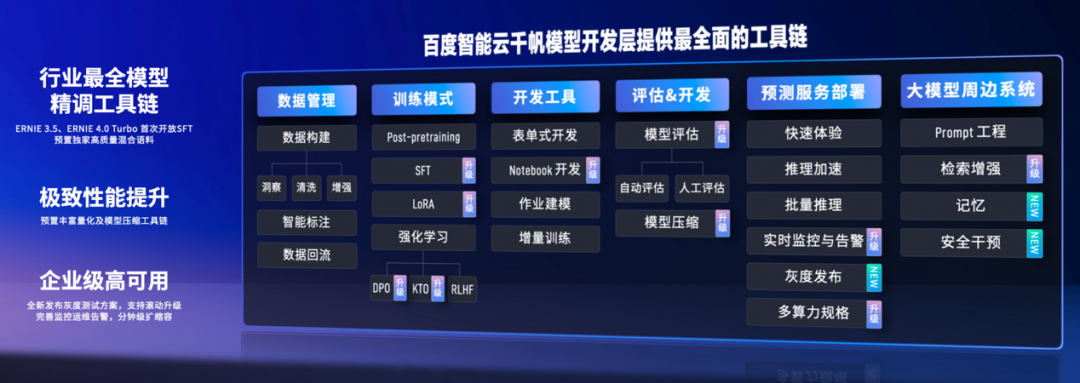

千帆3.0:模型调用、开发、应用全面升级

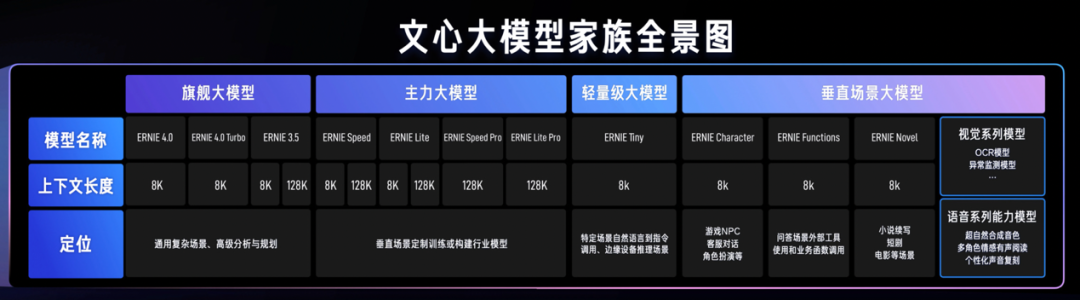

为满足企业对模型调用、开发及应用的多元化需求,百度智能云发布了千帆大模型平台3.0版本。该平台不仅支持调用包括文心系列在内的近百个国内外大模型,还新增了对语音、视觉等传统小模型的调用能力。同时,文心旗舰大模型在过去一年中价格降幅超过90%,且主力模型已实现全面免费。

在模型开发方面,千帆3.0提供了完善的大模型工具链,支持CV、NLP、语音等传统模型的定制与微调,并实现了数据、模型、算力等资源的统一纳管和调度。此外,该平台还支持企业将应用中产生的数据通过采样评估、人工标注等方式反馈给模型,形成数据飞轮效应,持续优化模型性能。

针对企业级应用开发,千帆3.0从检索效果、性能、存储扩展及调配灵活性等多个维度对RAG(增强生成检索)进行了全面升级。同时,为提升企业级Agent的开发效率,千帆3.0还新增了业务自主编排、人工编排、知识注入等80多个官方组件支持。

三大AI原生应用产品焕新升级

百度智能云还针对企业直接选购成熟AI应用的需求,对代码助手、智能客服、数字人等三大AI原生应用产品进行了全面升级。

· 智能客服“客悦”:基于文心大模型重构的“客悦”在复杂意图理解、多模态信息交流等方面实现了显著提升,问题自助解决率从行业平均的80%提升至92%。截至目前,“客悦”已累计服务企业超过1.5亿人次,交互次数超过5亿次。

· 曦灵数字人4.0:新升级的曦灵数字人不仅支持根据文字快速生成多样化3D形象和视频,还通过4D自动绑定技术和创新模态迁移技术解决了传统2D数字人动作僵硬的问题。此外,曦灵平台宣布将3D超写实数字人的价格从万元大幅降低至199元,进一步降低了企业应用门槛。

· 文心快码:全新升级的文心快码首次推出了“企业级代码架构解释”和“企业级代码审查”两大功能,能够智能解读工程架构、传承资深工程师编码经验,并深度理解企业代码库,帮助企业提升整体研发效率20%以上。目前,文心快码已服务超过1万家企业客户。

此次大会的召开标志着百度在AI领域的技术实力和应用能力迈上了新的台阶,也为广大企业用户带来了更加高效、智能的AI解决方案。