Adobe推出Firefly视频模型,正式进军生成式AI视频领域

Adobe公司在其年度MAX大会上宣布,正式推出Firefly视频模型,标志着其正式进军生成式AI视频创作领域。该模型此前已在今年早些时候进行过预览,现在通过一系列新工具向公众提供,其中包括直接在Premiere Pro中集成的一些功能,允许创作者延长视频片段、从静态图像和文本提示生成视频。

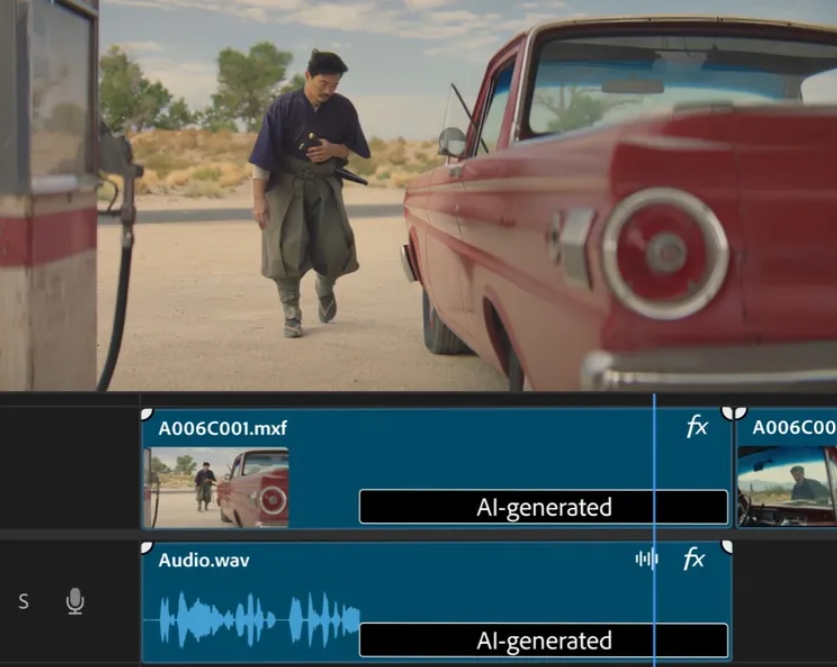

在Premiere Pro中,Adobe首先推出了名为“Generative Extend”的beta版工具。该工具可用于延长略短的视频片段的开头或结尾,或在中途进行调整,如校正眼神偏离或意外动作。不过,视频片段只能延长两秒,因此该工具主要适用于小幅修改,但可避免因小问题而重新拍摄视频的需求。生成的延长片段分辨率可达720p或1080p,帧率为24帧每秒。此外,该工具也可用于音频,以帮助平滑编辑,但有所限制,例如可延长音效和环境“房间音调”至多十秒,但不适用于对话或音乐。

同时,Adobe还在其Web平台上推出了另外两个视频生成工具:Text-to-Video和Image-to-Video。这两个工具最初于9月宣布,现在作为Firefly Web应用的有限公开beta版推出。

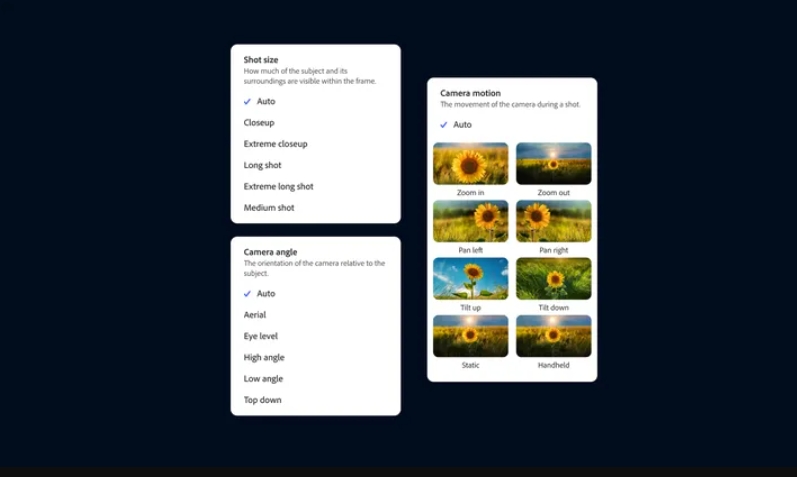

Text-to-Video功能与其他视频生成器类似,用户只需输入要生成的文本描述。它可以模拟多种风格,如普通“真实”电影、3D动画和定格动画,生成的片段可使用“相机控制”选项进行进一步调整,模拟相机角度、运动和拍摄距离等。

Image-to-Video功能更进一步,允许用户添加参考图像和文本提示,以更精准地控制结果。Adobe建议,该功能可用于从图像和照片制作B卷素材,或上传现有视频的静态图像以帮助可视化重拍。然而,示例显示,该功能尚无法直接替代重拍,因为结果中可见诸如晃动电缆和背景偏移等错误。

目前,Text-to-Video和Image-to-Video生成的片段最长为五秒,分辨率最高为720p,帧率为24帧每秒。相比之下,OpenAI表示其Sora可以生成长达一分钟的视频,同时保持视觉质量和用户提示的一致性,但该功能尚未向公众开放,尽管其宣布时间早于Adobe的工具。

这三个工具(Text-to-Video、Image-to-Video和Generative Extend)的生成时间约为90秒,但Adobe表示正在开发“涡轮模式”以缩短该时间。尽管存在限制,但Adobe表示,其由AI视频模型支持的工具是“商业安全的”,因为它们是在获得使用许可的内容上进行训练的。鉴于其他提供商(如Runway)的模型因涉嫌使用数千个YouTube视频进行训练而受到审查,Adobe工具的这一特点可能对某些用户具有吸引力。

此外,使用Adobe的Firefly视频模型创建或编辑的视频可以嵌入内容凭证,以在在线发布时披露AI的使用情况和所有权。目前尚不清楚这些工具何时会退出beta版,但它们现已公开可用,这优于OpenAI的Sora、Meta的Movie Gen和Google的Veo生成器等尚未公开的工具。

对于企业用户,Adobe还宣布了AI驱动的配音和口型同步功能,以及用于管理大量内容的批量编辑工具。

目前,Firefly视频模型处于有限公开beta阶段,该阶段可免费访问。Adobe尚未公布定价详情。