腾讯发布POINTS1.5,性能显著提升

2024年12月16日 由 neo 发表

198

0

距离腾讯首次推出POINTS1.0模型已经过去了整整两个月的时间,近日,腾讯再次宣布了一项重大更新——POINTS1.5的正式发布。这款新一代模型在保持POINTS1.0经典LLaVA架构的基础上,进行了全面的性能优化与提升,为用户带来了更加出色的使用体验。

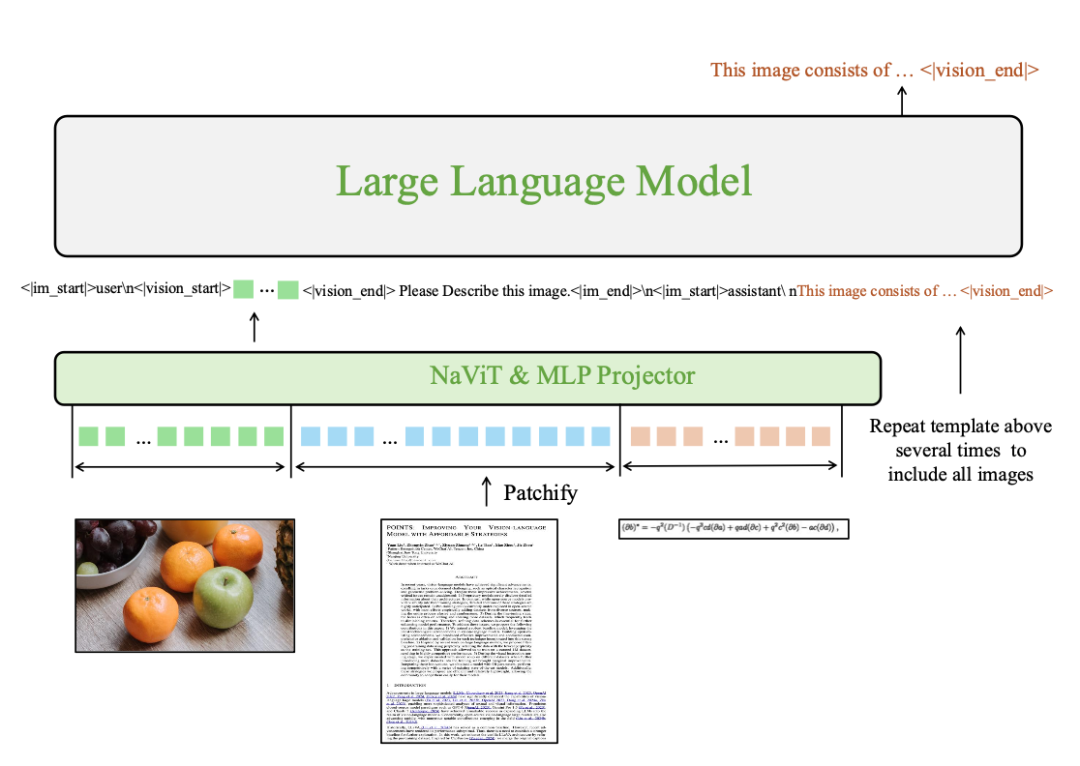

POINTS1.5依然沿用了POINTS1.0中的核心架构,即由vision encoder(视觉编码器)、projector(投影器)以及一个大语言模型共同组成。这一经典架构的延续,确保了POINTS1.5在保持高效运行的同时,能够充分发挥各组件的协同作用,从而提升整体性能。

据腾讯官方介绍,POINTS1.5在继承POINTS1.0效率优先理念的基础上,对模型性能进行了极大的增强。这一改进使得POINTS1.5在全球开源模型领域脱颖而出,特别是在10B参数以下的模型中,POINTS1.5-7B更是凭借其卓越的性能,成功登上了榜首位置,超越了包括Qwen2-VL、InternVL2以及MiniCPM-V-2.5等在内的众多业界领先模型。

在实际应用方面,POINTS1.5同样展现出了强大的实力。无论是在复杂场景的OCR(光学字符识别)中,还是在推理能力、关键信息提取、Latex公式提取、数学处理、图片翻译以及物体识别等多个领域,POINTS1.5都表现出了不俗的性能。这一全面而强大的应用能力,使得POINTS1.5在多个行业场景中都具有广泛的应用前景。

腾讯方面表示,POINTS1.5的发布是公司持续推动人工智能技术发展的又一重要里程碑。未来,腾讯将继续加大在人工智能领域的投入,不断推出更加先进、实用的模型和技术,为用户提供更加优质、便捷的服务体验。

文章来源:https://www.ithome.com/0/817/665.htm

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消