AutoDroid-V2:基于SLM的移动任务自动化新突破

大型语言模型(LLM)和视觉语言模型(VLM)的快速发展,正在彻底改变移动设备控制的自动化方式,为复杂的用户任务提供了前所未有的解决方案。然而,传统的分步GUI代理方法,尽管通过动态决策和反思来处理用户任务,却严重依赖于基于云的强大模型,如GPT-4和Claude,这引发了隐私、安全、流量消耗和成本等方面的担忧。

在过去,移动任务自动化主要依赖于基于模板的方法,如Siri、Google Assistant和Cortana,但这些方法在处理复杂任务时存在局限性。随着技术的进步,基于GUI的自动化方法应运而生,能够处理更复杂的任务,而无需依赖第三方API或大量编程。然而,这些方法,尤其是基于脚本的GUI代理,在面对移动应用程序的动态特性时,仍然面临知识提取和脚本执行的挑战。

为了克服这些挑战,清华大学人工智能产业研究院(AIR)的研究人员推出了AutoDroid-V2。这款创新的移动任务自动化工具,旨在利用小型语言模型(SLM)的编码功能,构建强大的GUI代理。与传统的分步式GUI代理相比,AutoDroid-V2采用了基于脚本的方法,能够根据用户指令生成并执行多步骤脚本,从而大大提高了效率和性能。

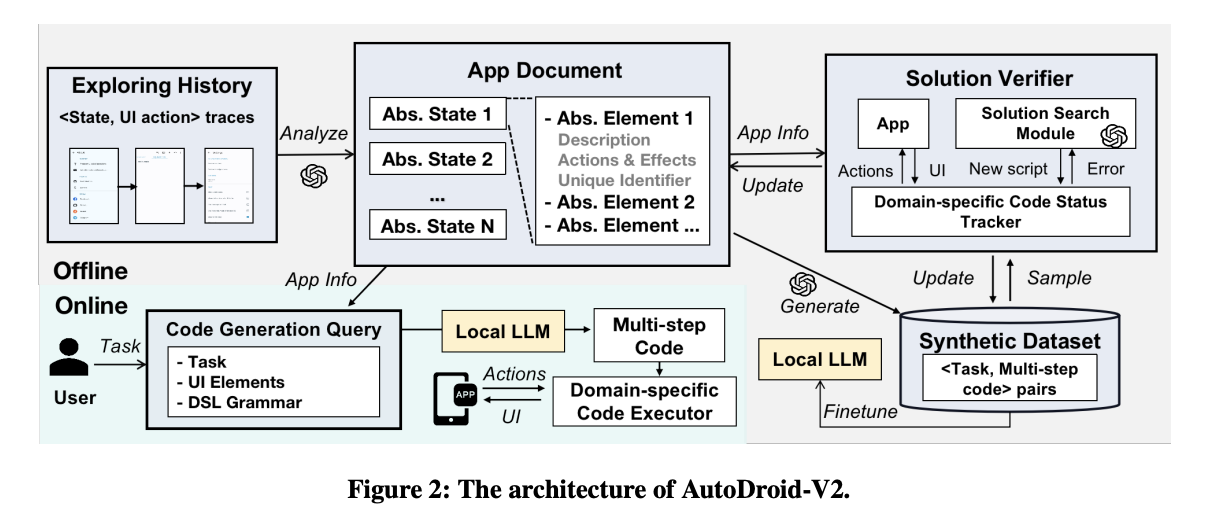

AutoDroid-V2的架构分为离线和在线两个阶段。在离线阶段,系统通过全面分析应用程序探索历史来构建应用程序文档,为脚本生成提供基础。这一文档结合了AI引导的GUI状态压缩、元素XPath自动生成和GUI依赖性分析,确保了脚本的简洁性和准确性。在在线阶段,当用户提交任务请求时,定制的本地LLM会生成一个多步骤脚本,然后由特定于领域的解释器执行该脚本,以实现可靠高效的运行时执行。

实验结果表明,AutoDroid-V2在23个移动应用程序上测试了226个任务,与AutoDroid、SeeClick、CogAgent和Mind2Web等领先基准相比,任务完成率提高了10.5%-51.7%。同时,它还显著减少了计算需求,输入和输出令牌消耗分别减少了43.5倍和5.8倍,LLM推理延迟降低了5.7-13.4倍。在不同的LLM上进行测试时,AutoDroid-V2也显示出一致的性能表现。

研究人员表示,AutoDroid-V2代表了移动任务自动化的重大进步。它利用设备上的SLM和创新的文档引导、基于脚本的方法,实现了与基于云的解决方案相当的准确度,同时保持了设备级的隐私和安全性。这一突破性的成果为移动任务自动化领域带来了新的希望和发展方向。

尽管AutoDroid-V2在处理结构化文本表示形式的GUI应用程序方面取得了显著成就,但在面对缺乏结构化文本表示形式的GUI应用程序(如基于Unity和基于Web的应用程序)时,仍面临一定的限制。然而,研究人员指出,通过集成VLM来恢复基于视觉特征的结构化GUI表示,有望解决这一挑战,进一步拓展AutoDroid-V2的应用范围。