OpenAI的Sam Altman所说的AGI可实现是什么意思?

Sam Altman在2025年发表了一项大胆宣言:OpenAI已经找到了创造人工通用智能(AGI)的方法。AGI一词,通常被理解为AI系统能够理解、学习和执行人类所能执行的任何智力任务。

上周末,Altman在一篇反思性博文中表示,第一批AI代理或将于今年加入劳动力,这标志着技术史上的一个关键时刻。他描述了OpenAI从默默无闻到宣称即将创造AGI的非凡旅程。然而,这个时间表看起来颇为雄心勃勃,毕竟ChatGPT才刚刚庆祝完它的2岁生日,而Altman已经表示,下一个能够进行复杂推理的AI模型的范式已经显现。

从那一刻起,一切都聚焦于将近乎人类的AI融入社会,直至AI在所有领域超越人类。但什么是AGI,什么又是ASI呢?Altman对AGI的概括以及对时间表的预测,引起了AI研究人员和行业老将们的广泛关注。

谁是 AGI,谁是 ASI?

Altman写道:“我们现在有信心知道如何构建AGI,因为我们以传统的方式理解它。我们相信,在2025年,我们可能会看到第一个AI代理‘加入劳动力’,并对公司的产出产生实质性的改变。”然而,AGI的定义并不明确,随着AI模型变得越来越强大但不一定更有能力,标准也必须不断提高。

Fetch.ai的CEO兼ASI联盟主席Humayun Sheikh表示:“虽然这些系统已经能够通过许多与AGI相关的传统基准测试,如图灵测试,但这并不意味着它们具备感知能力。AGI还没有达到真正感知的水平,我认为还需要很长时间才能达到。”

Altman的乐观态度与专家共识之间存在明显背离,这引发了人们对他所称“AGI”真正含义的疑问。他关于AI代理在2025年“加入劳动力”的说法,听起来更像是先进的自动化,而非真正的人工通用智能。

Altman写道:“超级智能工具可以大大加速科学发现和创新,超越我们自己的能力,并进一步增加社会的丰富和繁荣。”然而,关于AGI或代理整合在2025年成为现实的说法,并非每个人都如此确定。

Galxe的联合创始人Charles Wayn表示:“现有的AI模型存在太多错误和不一致之处,这些问题必须首先解决。也就是说,可能是几年而不是几十年,我们就会看到AGI级别的AI代理。”

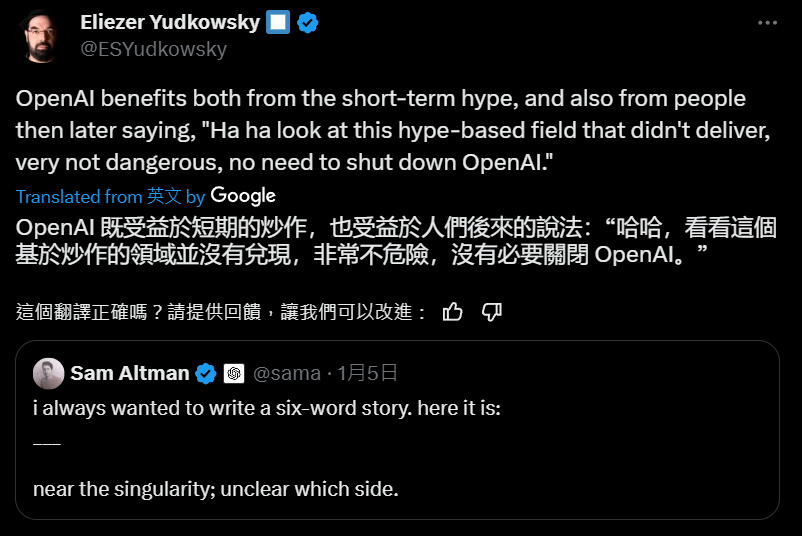

一些专家怀疑,Altman的大胆预测或许另有目的。OpenAI一直在以惊人的速度烧钱,需要大量投资来维持其人工智能开发的进展。一些人认为,承诺即将取得突破可能有助于保持投资者的兴趣,尽管公司的运营成本相当高昂。

然而,也有人支持Altman的说法。数字身份平台SPACE ID的业务拓展总监Harrison Seletsky表示:“如果Sam Altman说AGI即将到来,那么他可能有一些数据或商业眼光来支持这种说法。”如果Altman的说法正确,且技术继续在同一领域发展,那么“广义智能的AI代理”可能还需要一两年时间才能出现。

值得注意的是,OpenAI的首席执行官暗示,对于他来说,AGI并不足够,他的公司的目标是ASI——AI发展的一个优越状态,其中模型在所有任务上都能超过人类能力。Altman在博客中写道:“我们开始将目标转向真正意义上的超级智能。我们热爱我们目前的产品,但我们以荣耀的未来为己任。有了超级智能,我们可以做任何事情。”

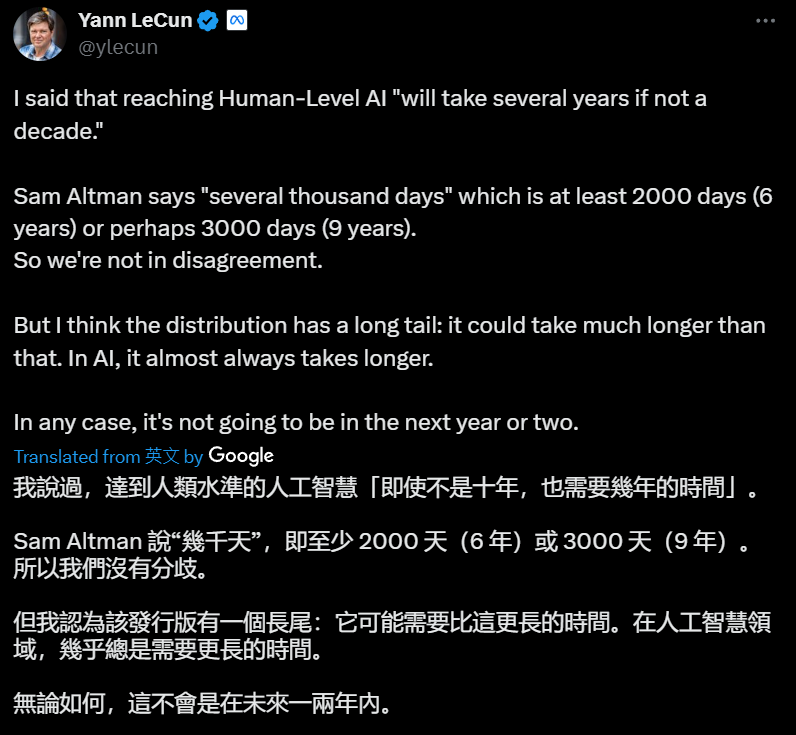

虽然Altman没有详细说明ASI的时间框架,但有人预计到2116年,机器人可以替代所有人类工作。Altman曾经说过,ASI只是“几千天”的问题,然而Forecasting Institute的专家则认为,至少要到2060年,实现ASI的可能性才有50%。

Meta的首席AI研究员Yan Lecun表示,由于训练技术或处理如此庞大信息所需的硬件的限制,人类离达到这个里程碑仍然很远。而相当有影响力的AI研究人员和哲学家Eliezer Yudkowsky则认为,这可能是一种炒作手段,旨在短期内让OpenAI受益。

尽管AI代理的质量和多功能性正在以比许多人预期更快的速度提高,但与AGI或ASI不同,代理行为本身是一种存在。像Crew AI、Autogen或LangChain这样的框架使得创建具有不同能力的AI代理系统成为可能,包括与用户密切合作的能力。

这对于普通人来说意味着什么?对于日常工作者来说,这是一种危险还是一种福音?专家们对此并不太担心。Sheikh表示:“我不相信我们会看到过夜的剧变。虽然可能会对人力资本产生一些减少,特别是对于重复性的任务,但这些进展也可能解决当前遥控飞行器无法处理的更复杂的重复性任务。”

Seletsky也认为,代理通常更可能处理重复性任务,而不是需要某种程度决策的任务。只要人们能够利用自己的创造力和专业知识,并对自己的行为负责,人类就是安全的。他告诉Decrypt:“我认为在不久的将来,决策不一定会由AI代理主导,因为它们可以推理和分析,但它们还没有人类的创造力。”

至少在短期内,似乎有一定程度的共识。Galxe的Wayn表示:“关键区别在于AGI的方法缺乏‘人性’。它是一种客观、基于数据的金融研究和投资方法。这有助于而不是阻碍金融决策,因为它消除了一些情绪偏见,这些偏见经常导致草率的决策。”

专家们已经意识到采用AI代理可能带来的社会影响。香港城市大学的研究认为,生成性AI和代理通常必须与人类合作,而不是替代他们,这样社会才能实现健康和持续的增长。该研究论文写道:“AI在技术、商业、教育、医疗、艺术和人文等各个领域都带来了挑战和机遇。AI与人类的合作是解决由生成性AI所产生的挑战和抓住机遇的关键。”

尽管推动人工智能与人类的合作,但一些公司已经开始用AI代理替换人类工作者,结果好坏参半。一般来说,他们总是需要人类来处理代理无法完成的任务,这可能是因为虚构、训练限制或简单地缺乏上下文理解。

截至2024年,将近25%的首席执行官对拥有农场式的数字奴役代理产生了兴趣,这些代理能够像人类一样工作,而不涉及劳动力成本。然而,其他专家则认为,AI代理可以在几乎80%的情况下比首席执行官做得更好——所以,没有人是真正安全的。