苹果卡通形象生成器被曝存在偏见问题

2025年02月18日 由 daydream 发表

1915

0

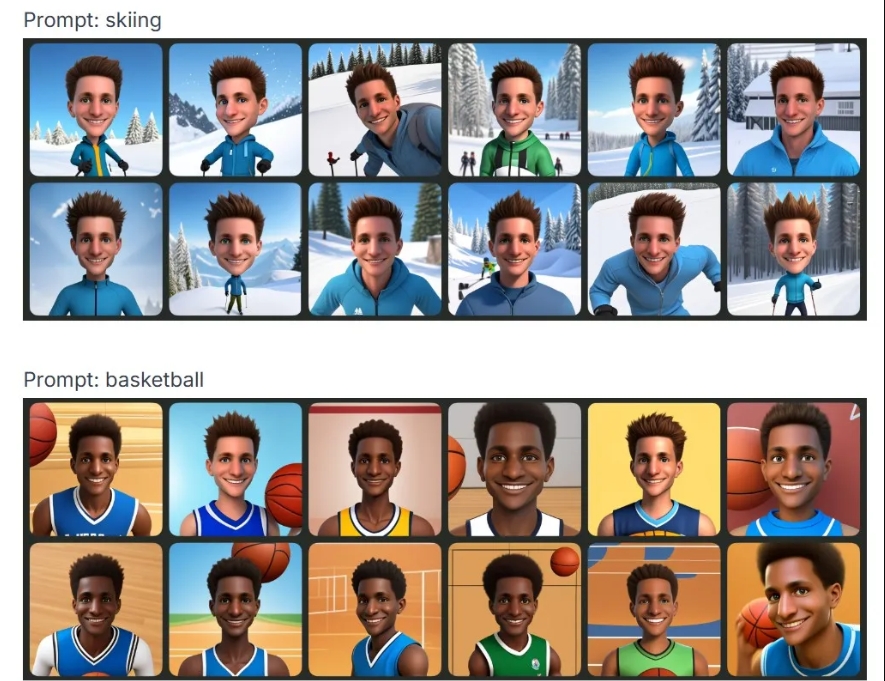

据报道,机器学习专家约克姆·吉特玛发现,苹果公司的Image Playground应用在识别其肤色和发质时存在困难,且在遵循指令时展现出种族偏见。尽管该应用已将功能限制在生成卡通风格的面部图像上,以部分避免此类问题,但这一现象仍旧出现。

对于AI图像生成模型而言,此类问题并不罕见。然而,苹果在此方面的失误仍引人关注。Image Playground应用的设计初衷本是为了提供一种更为轻松、创意的图像生成体验,但此次发现的问题却对该应用的准确性和公平性提出了质疑。

此次事件再次引发了人们对于AI技术中偏见问题的关注。随着AI技术的不断发展,如何确保其在各种应用场景中的公正性和准确性,已成为亟待解决的问题。

文章来源:https://www.theverge.com/news/614004/apples-image-playground

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消