Salesforce AI发布Text2Data:突破低资源环境下文本到数据生成挑战

生成式人工智能在自主性和可控性之间面临一项关键挑战。尽管通过强大的生成模型,自主性取得了显著进展,但可控性却成为机器学习研究者关注的焦点。特别是基于文本的控制变得至关重要,因为自然语言为人类和机器之间提供了一个直观的交互界面。这一方法推动了图像编辑、音频合成和视频生成等领域的显著进步。

近年来,文本到数据生成模型,尤其是那些采用扩散技术的模型,通过利用大量数据-文本配对数据集中的语义洞察,取得了令人瞩目的成果。然而,在获取足够的文本配对数据变得极其昂贵或复杂的低资源环境中,这些模型面临着显著的障碍。这些障碍在分子数据、动作捕捉和时间序列等关键领域尤为突出,因为这些领域通常缺乏足够的文本标签,从而限制了监督学习的能力,并阻碍了先进生成模型的部署。这些限制往往导致生成质量低下、模型过拟合、存在偏见以及输出多样性不足等问题,暴露了在数据有限情况下优化文本表示以实现更好数据对齐的巨大挑战。

为了应对低资源情境下的这些挑战,出现了一些缓解方法,但每种方法都有其固有的局限性。数据增强技术往往无法准确对齐合成数据与原始文本描述,并且在增加扩散模型计算需求的同时,还存在过拟合的风险。半监督学习在处理文本数据固有的模糊性时表现不佳,使得正确解释未标记样本变得具有挑战性。迁移学习虽然对有限数据集有所帮助,但往往受到灾难性遗忘的影响,即模型在适应新的文本描述时会忘记先前获取的知识。

鉴于这些方法上的缺陷,设计针对低资源环境的文本到数据生成的更健壮方法显得尤为重要。在本文中,Salesforce AI Research的研究人员介绍了Text2Data技术,该技术引入了一个基于扩散的框架,通过两阶段方法在低资源环境中增强文本到数据的可控性。

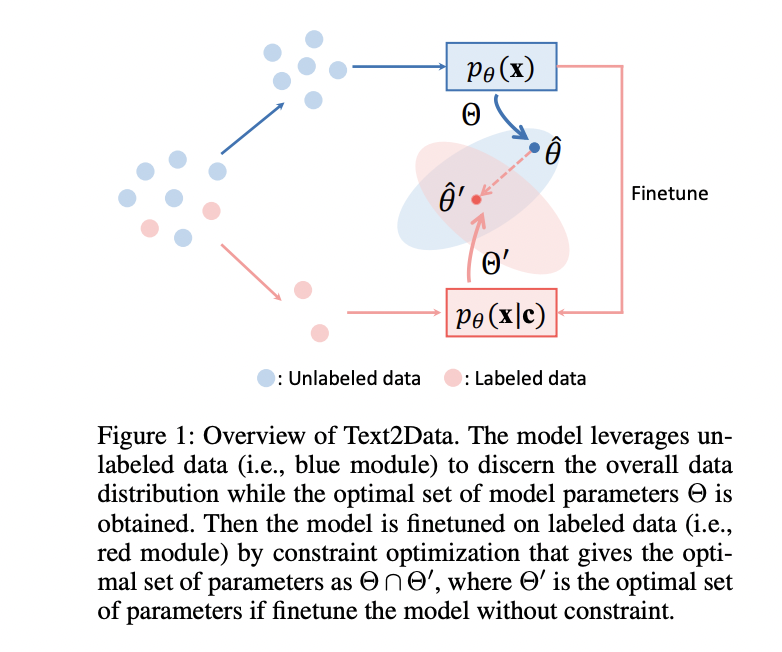

首先,Text2Data利用无监督扩散模型,通过未标记数据掌握数据分布,从而避免了半监督方法中常见的语义模糊问题。其次,该技术对文本标注数据进行可控的微调,而不会扩大训练数据集。相反,Text2Data采用了基于约束优化的学习目标,以防止参数陡变,从而有效避免灾难性遗忘。

这个独特的框架有效地结合了标注和未标注的数据,保持了细粒度的数据分布,同时实现了卓越的可控性。理论验证支持了优化约束选择和泛化界限的合理性,并通过跨三个模态的综合实验证明了Text2Data在生成质量和可控性上相较于基线方法的优越性。

Text2Data通过学习条件分布pθ(x|c)来解决可控的数据生成问题,其中有限的配对数据带来了优化挑战。该框架在两个不同阶段运行。初始阶段,它利用更丰富的未标记数据学习边缘分布pθ(x),以获得最优参数θ̂。这种方法利用了边缘分布与条件分布之间的数学关系,使得pθ(x)近似于在文本分布上pθ(x|c)的期望值。随后,Text2Data使用可用的标记数据-文本对对这些参数进行微调,同时实施约束优化以保持更新后的参数θ̂’在先前学习的分布范围内。

这个约束确保了模型在获得文本可控性的同时,保持了对整体数据分布的知识,有效防止了通常在微调过程中发生的灾难性遗忘。Text2Data通过首先使用带有NULL标记作为条件的所有可用数据来学习总体数据分布,然后引入一个约束优化框架,在文本标注数据上微调模型,同时防止参数偏离先前学习的分布。

从数学上,这表示为最小化条件概率pθ(x|c)的负对数似然,并约束边缘分布性能保持接近第一阶段确立的最优值ξ。这种基于约束的方法直接解决了灾难性遗忘问题,通过确保模型参数保持在一个既具有一般数据表示又具有文本特定可控性的最优集合内,实现了这两个竞争目标之间的平衡。

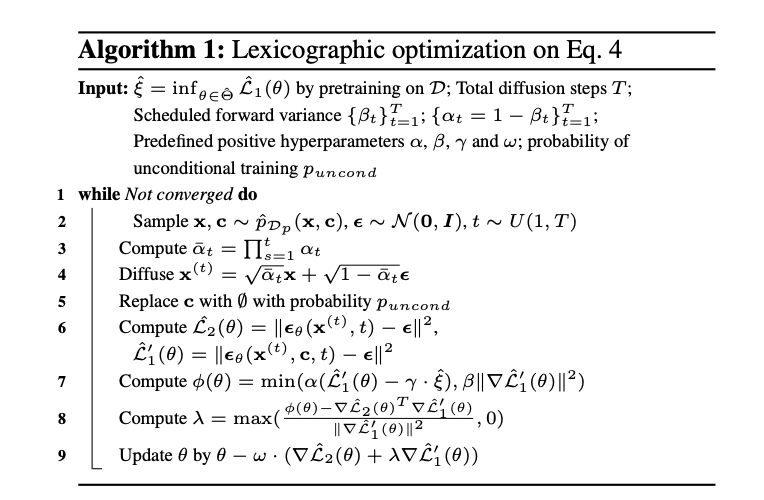

通过将理论目标转化为实际损失函数,Text2Data实现了无分类器扩散指导。该框架优化了三个关键组成部分:L1(θ)用于一般数据分布学习,L’1(θ)用于标记数据的分布保持,以及L2(θ)用于文本条件生成。这些是通过使用可用数据样本进行经验估计得出的。

字典优化过程通过动态调整具有参数λ的梯度更新来执行约束,同时允许有效学习。此方法使用了一个复杂的更新规则,其中θ根据两个目标的梯度加权组合进行修改。训练期间可以放松该约束以改善收敛,因为可以认识到参数不需要是原始参数空间的精确子集,但应保持接近,以保留分布知识同时获得可控性。

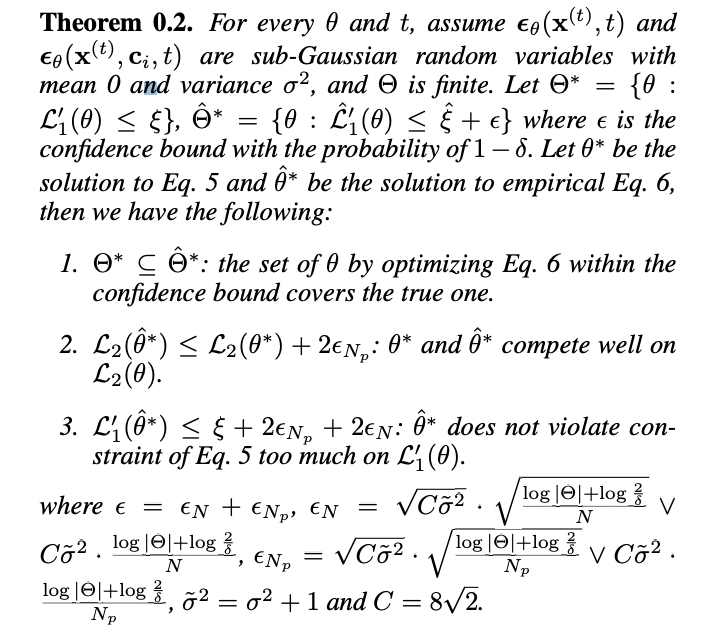

Text2Data通过结合扩散过程得出的随机变量是次高斯的特性,为其约束优化方法提供了理论基础,从而能够制定严格的置信界限。定理0.2提供了三个关键保证:首先,置信界限内的经验参数集完全包含了真实的最优集;其次,经验解决方案在主要目标上与理论最优竞争;第三,经验解决方案合理地遵循了理论约束。

实际实施中引入了一个放松参数ρ,用于调整约束的严格程度,同时保持在数学上合理的置信区间内。这种放松承认了现实条件下获取大量未标记样本的可行性,使得即使在处理包含数百万参数的模型时,置信界限也保持合理紧凑。涉及45000个样本和1400万参数的运动生成实验验证了该框架的实用性。

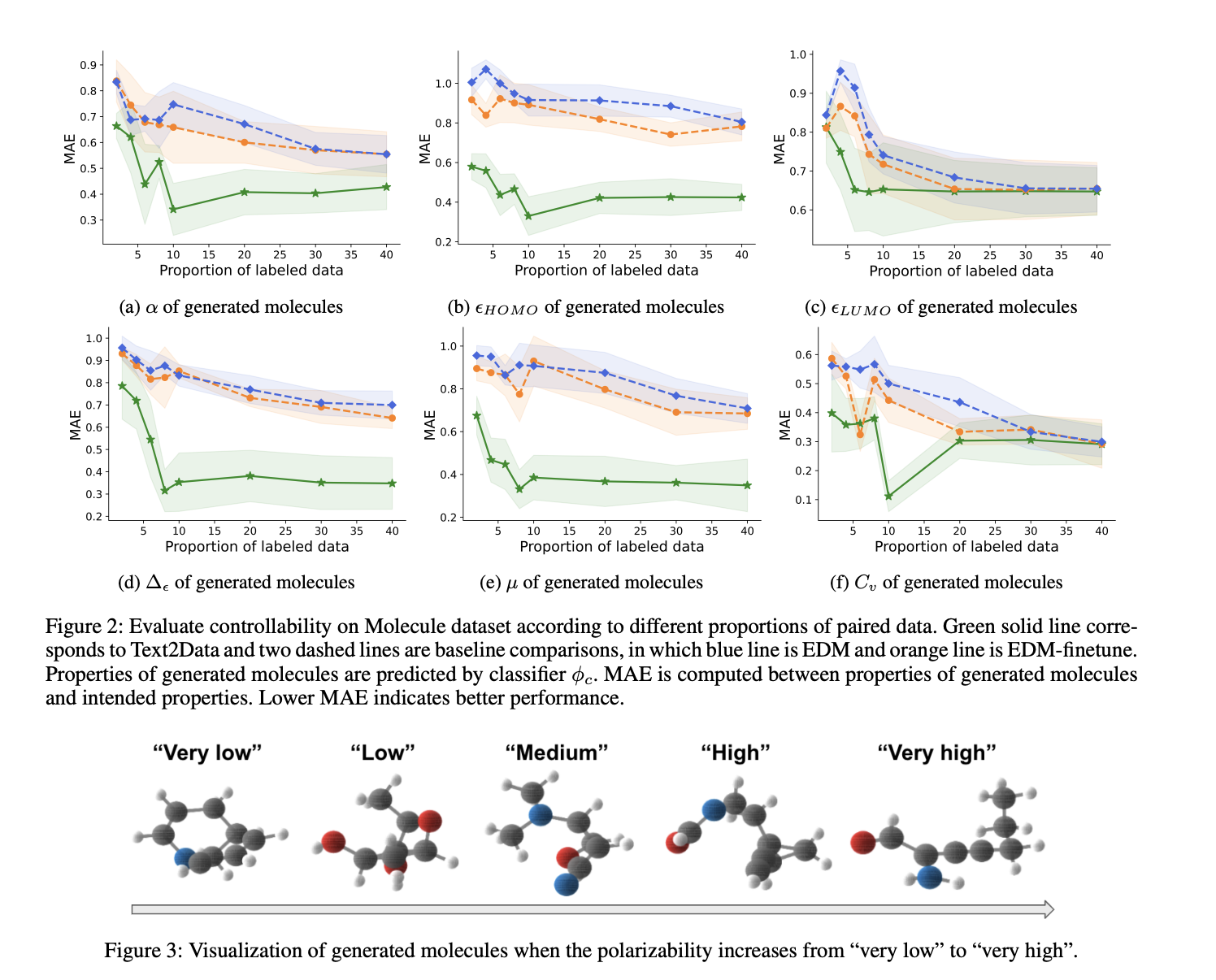

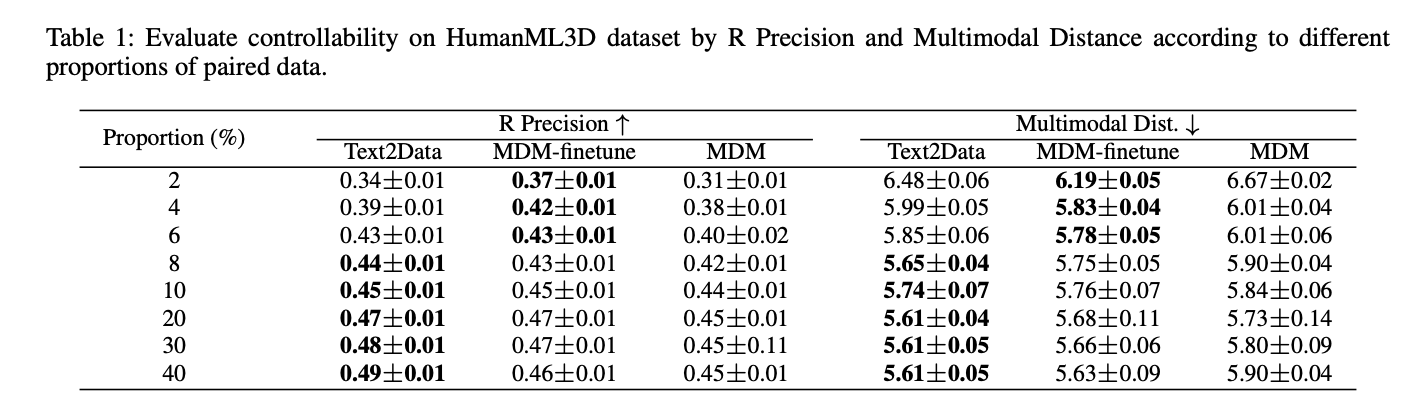

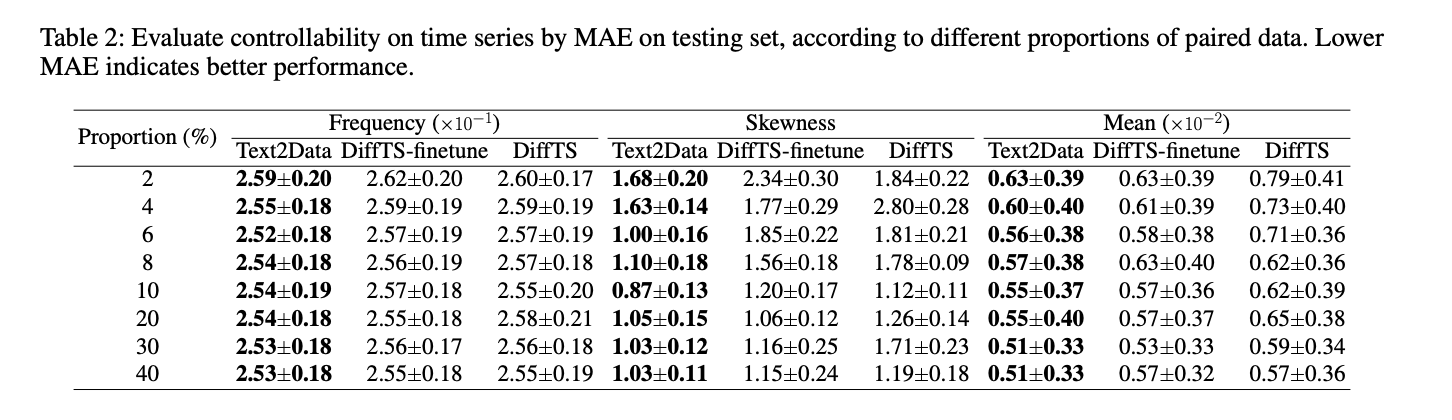

Text2Data在多个领域展示了相较于基线方法更优的可控性。在分子生成中,它在所有特性上的平均绝对误差(MAE)都比EDM-finetune和EDM低,特别是在某些关键特性上表现出色。在运动生成方面,Text2Data在R Precision和多模态距离指标上超过了MDM-finetune和MDM。在时间序列生成中,它在所有评估的特性上始终优于DiffTS-finetune和DiffTS。

除了可控性之外,Text2Data还保持了卓越的生成质量,在分子有效性、稳定性、运动生成多样性和时间序列中分布对齐方面显示了改进。这些结果验证了Text2Data在防止灾难性遗忘的同时保持生成质量的有效性。

综上所述,Text2Data在多个模态中有效地解决了低资源场景下文本到数据生成的挑战。通过初步利用未标记数据掌握整体数据分布,随后在标记数据上微调时实施约束优化,该框架成功地平衡了可控性与分布保持之间的关系。实验结果一致表明,Text2Data在可控性和生成质量上均优于基线方法。虽然Text2Data是基于扩散模型实现的,但其原则可以很容易地适应其他生成架构。