模型:

TheBloke/wizard-vicuna-13B-SuperHOT-8K-GPTQ

英文

英文

Chat & support: my new Discord server

Want to contribute? TheBloke's Patreon page

June Lee's Wizard Vicuna 13B GPTQ

这些文件是用于 June Lee's Wizard Vicuna 13B 与 Kaio Ken's SuperHOT 8K 的合并的GPTQ 4bit模型文件。

这是使用 GPTQ-for-LLaMa 进行4bit量化的结果。

这是一个实验性的新GPTQ,可以提供高达8K的上下文大小。

通过最新版本的 text-generation-webui ,已对增加的上下文进行了测试 更新 ExLlama 。

它还通过使用AutoGPTQ中的Python代码进行了测试,并且设置 trust_remote_code=True。

代码来源:

- 增加上下文长度的原始概念和代码: kaiokendev

- 更新的包括这个功能的Llama建模代码: emozilla 。

请仔细阅读以下内容,了解如何使用。

目前还没有提供GGML版本,因为lama.cpp还不支持SuperHOT。正在调查此问题,并希望很快解决。

可用的存储库

- 4-bit GPTQ models for GPU inference

- 2, 3, 4, 5, 6 and 8-bit GGML models for CPU inference

- Unquantised SuperHOT fp16 model in pytorch format, for GPU inference and for further conversions

- Unquantised base fp16 model in pytorch format, for GPU inference and for further conversions

如何在text-generation-webui中轻松下载和使用此模型

请确保您正在使用text-generation-webui的最新版本。

如何在Python代码中使用此GPTQ模型的AutoGPTQ

首先确保已安装AutoGPTQ和Einops:

pip3 install einops auto-gptq

然后运行以下代码。请注意,为了使代码正常工作,config.json已被硬编码为序列长度为8192。

如果要尝试4096以减少VRAM使用量,请手动编辑config.json,将max_position_embeddings设置为所需的值。

from transformers import AutoTokenizer, pipeline, logging

from auto_gptq import AutoGPTQForCausalLM, BaseQuantizeConfig

import argparse

model_name_or_path = "TheBloke/wizard-vicuna-13B-SuperHOT-8K-GPTQ"

model_basename = "wizard-vicuna-13b-superhot-8k-GPTQ-4bit-128g.no-act.order"

use_triton = False

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, use_fast=True)

model = AutoGPTQForCausalLM.from_quantized(model_name_or_path,

model_basename=model_basename,

use_safetensors=True,

trust_remote_code=True,

device_map='auto',

use_triton=use_triton,

quantize_config=None)

model.seqlen = 8192

# Note: check the prompt template is correct for this model.

prompt = "Tell me about AI"

prompt_template=f'''USER: {prompt}

ASSISTANT:'''

print("\n\n*** Generate:")

input_ids = tokenizer(prompt_template, return_tensors='pt').input_ids.cuda()

output = model.generate(inputs=input_ids, temperature=0.7, max_new_tokens=512)

print(tokenizer.decode(output[0]))

# Inference can also be done using transformers' pipeline

# Prevent printing spurious transformers error when using pipeline with AutoGPTQ

logging.set_verbosity(logging.CRITICAL)

print("*** Pipeline:")

pipe = pipeline(

"text-generation",

model=model,

tokenizer=tokenizer,

max_new_tokens=512,

temperature=0.7,

top_p=0.95,

repetition_penalty=1.15

)

print(pipe(prompt_template)[0]['generated_text'])

使用其他UI:monkey patch

在存储库中提供了llama_rope_scaled_monkey_patch.py,由@kaiokendev编写。

它理论上可以添加到任何Python UI或自定义代码中,以启用与trust_remote_code=True相同的结果。我没有测试过这一点,使用trust_remote_code=True应替代它,但为了完整性和兴趣,我包含了它。

提供的文件

wizard-vicuna-13b-superhot-8k-GPTQ-4bit-128g.no-act.order.safetensors

这将与AutoGPTQ,ExLlama以及GPTQ-for-LLaMa的CUDA版本一起工作。有报道称最近的GPTQ-for-LLaMa Triton模式存在问题。如果有问题,请改用AutoGPTQ。

它使用group_size 128进行创建,以增加推理准确性,但不使用--act-order(desc_act)进行创建,以增加兼容性并改善推理速度。

- wizard-vicuna-13b-superhot-8k-GPTQ-4bit-128g.no-act.order.safetensors

- 适用于具有增加上下文的ExLlama(4096或8192)

- 适用于Python代码中的AutoGPTQ,包括具有增加上下文的情况,如果设置trust_remote_code=True。

- 应该适用于CUDA模式的GPTQ-for-LLaMa,但是否支持增加上下文还未确定 - TBC。可能在GPTQ-for-LLaMa Triton模式下存在问题。

- 可与text-generation-webui一起使用,包括一键安装程序。

- 参数:Groupsize = 128。Act Order / desc_act = False。

Discord

如需进一步支持以及有关这些模型和AI的讨论,请加入我们:

感谢和如何贡献

感谢 chirper.ai 工作团队!

很多人问我是否可以贡献。我喜欢提供模型并帮助人们,并且很乐意投入更多时间来做这些事情,以及扩大到新的项目,如微调/训练。

如果您有能力并愿意贡献,我会非常感激,并且帮助我继续提供更多的模型,并开始新的AI项目。

捐助者将在所有关于人工智能/LLM/模型的问题和请求上获得优先支持,还可以进入专用Discord房间,以及其他收益。

- Patreon: https://patreon.com/TheBlokeAI

- Ko-Fi: https://ko-fi.com/TheBlokeAI

特别感谢 :Luke from CarbonQuill, Aemon Algiz, Dmitriy Samsonov。

Patreon特别提及 :zynix, ya boyyy, Trenton Dambrowitz, Imad Khwaja, Alps Aficionado, chris gileta, John Detwiler, Willem Michiel, RoA, Mano Prime, Rainer Wilmers, Fred von Graf, Matthew Berman, Ghost, Nathan LeClaire, Iucharbius, Ai Maven, Illia Dulskyi, Joseph William Delisle, Space Cruiser, Lone Striker, Karl Bernard, Eugene Pentland, Greatston Gnanesh, Jonathan Leane, Randy H, Pierre Kircher, Willian Hasse, Stephen Murray, Alex, terasurfer, Edmond Seymore, Oscar Rangel, Luke Pendergrass, Asp the Wyvern, Junyu Yang, David Flickinger, Luke, Spiking Neurons AB, subjectnull, Pyrater, Nikolai Manek, senxiiz, Ajan Kanaga, Johann-Peter Hartmann, Artur Olbinski, Kevin Schuppel, Derek Yates, Kalila, K, Talal Aujan, Khalefa Al-Ahmad, Gabriel Puliatti, John Villwock, WelcomeToTheClub, Daniel P. Andersen, Preetika Verma, Deep Realms, Fen Risland, trip7s trip, webtim, Sean Connelly, Michael Levine, Chris McCloskey, biorpg, vamX, Viktor Bowallius, Cory Kujawski。

感谢所有慷慨的赞助人和捐助者!

原始模型卡片:Kaio Ken的SuperHOT 8K

带有8K上下文的SuperHOT原型2

这是SuperHOT的第二个原型,这次是30B带有8K上下文,没有RLHF,使用了 the github blog 中描述的相同技术。测试表明,该模型确实利用了8K的扩展上下文。

您需要使用 monkeypatch,如果您已经使用monkeypatch,请将缩放因子更改为0.25,并将最大序列长度更改为8192。

寻找合并和量化的模型吗?- 30B 4位CUDA: tmpupload/superhot-30b-8k-4bit-safetensors

- 30B 4位CUDA 128g: tmpupload/superhot-30b-8k-4bit-128g-safetensors

我使用以下配置对LoRA进行了训练:

- 1200个样本(2048个序列长度上额外400个样本)

- 学习率为3e-4

- 3个epochs

- 导出的模块为:

- q_proj

- k_proj

- v_proj

- o_proj

- 没有偏差

- 排名 = 4

- Alpha = 8

- 没有dropout

- 权重衰减为0.1

- AdamW beta1为0.9,beta2为0.99,epsilon为1e-5

- 在4位基础模型上进行训练

原始模型卡片:June Lee的Wizard Vicuna 13B

Chat & support: my new Discord server

Want to contribute? TheBloke's Patreon page

# Wizard-Vicuna-13B-HF这是一个浮点16位HF格式的存储库,用于 junelee's wizard-vicuna 13B 。

June Lee的存储库也使用了HF格式。我创建这个的原因是原始存储库是float32格式,意味着需要52GB的磁盘空间,VRAM和RAM来加载和管理。

为了更容易加载和管理,将此模型转换为float16格式。

可用的存储库

- 4bit GPTQ models for GPU inference

- 4bit and 5bit GGML models for CPU inference

- float16 HF format model for GPU inference

Discord

如需进一步支持以及有关这些模型和AI的讨论,请加入我们:

感谢和如何贡献

感谢 chirper.ai 团队!

很多人问我是否可以贡献。我喜欢提供模型并帮助人们,并且很乐意投入更多时间以从事此类工作,以及扩大到新的项目,如微调/训练。

如果您有能力并愿意贡献,我会非常感激,并且帮助我继续提供更多的模型,并开始新的AI项目。

捐助者将在所有关于人工智能/LLM/模型的问题和请求上获得优先支持,还可以进入专用Discord房间,以及其他收益。

- Patreon: https://patreon.com/TheBlokeAI

- Ko-Fi: https://ko-fi.com/TheBlokeAI

Patreon特别提及 : Aemon Algiz, Dmitriy Samsonov, Nathan LeClaire, Trenton Dambrowitz, Mano Prime, David Flickinger, vamX, Nikolai Manek, senxiiz, Khalefa Al-Ahmad, Illia Dulskyi, Jonathan Leane, Talal Aujan, V. Lukas, Joseph William Delisle, Pyrater, Oscar Rangel, Lone Striker, Luke Pendergrass, Eugene Pentland, Sebastain Graf, Johann-Peter Hartman.

感谢所有慷慨的赞助人和捐助者!

原始WizardVicuna-13B模型卡片

GitHub页面: https://github.com/melodysdreamj/WizardVicunaLM

WizardVicunaLM

向导的数据集+ChatGPT的对话扩展+Vicuna的调谐方法

我非常喜欢WizardLM和VicunaLM背后的理念。我特别喜欢WizardLM更深入和广泛地处理数据集本身的理念,以及VicunaLM通过引入多回合对话来克服单回合对话的限制。因此,我将这两个理念结合起来创建了WizardVicunaLM。这个项目高度实验性,旨在证明概念,而不是实际使用。

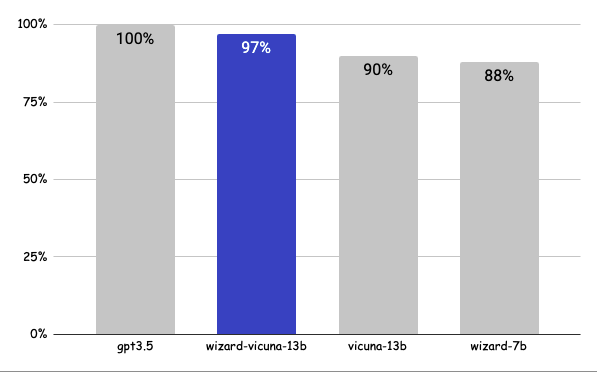

基准

与VicunaLM相比,大约提高了7%的性能

详细信息

这里提出的问题不是来自严格的测试,而是我问了一些问题,并要求GPT-4对它们进行评分。比较的模型是ChatGPT 3.5、WizardVicunaLM、VicunaLM和WizardLM,按此顺序进行比较。

| gpt3.5 | wizard-vicuna-13b | vicuna-13b | wizard-7b | link | |

|---|---|---|---|---|---|

| Q1 | 95 | 90 | 85 | 88 | 12334321 |

| Q2 | 95 | 97 | 90 | 89 | 12335321 |

| Q3 | 85 | 90 | 80 | 65 | 12336321 |

| Q4 | 90 | 85 | 80 | 75 | 12337321 |

| Q5 | 90 | 85 | 80 | 75 | 12338321 |

| Q6 | 92 | 85 | 87 | 88 | 12339321 |

| Q7 | 95 | 90 | 85 | 92 | 12340321 |

| Q8 | 90 | 85 | 75 | 70 | 12341321 |

| Q9 | 92 | 85 | 70 | 60 | 12342321 |

| Q10 | 90 | 80 | 75 | 85 | 12343321 |

| Q11 | 90 | 85 | 75 | 65 | 12344321 |

| Q12 | 85 | 90 | 80 | 88 | 12345321 |

| Q13 | 90 | 95 | 88 | 85 | 12346321 |

| Q14 | 94 | 89 | 90 | 91 | 12347321 |

| Q15 | 90 | 85 | 88 | 87 | 12348321 |

| 91 | 88 | 82 | 80 |

原则

我们采用了WizardLM的方法,即更深入地扩展单个问题。然而,我们没有使用单独的指令,而是使用Vicuna的对话格式扩展了它。

将单个命令扩展为丰富的对话是我们所做的事 here 。

创建训练数据后,我根据Vicuna v1.1使用了以下模型进行训练 training method 。

详细方法

首先,我们使用WizardLM创建的7K个对话扩展了各个领域,而不是使用单个指令格式。也就是说,它从WizardLM的指令开始,然后使用ChatGPT 3.5在一个对话中扩展到各个领域。

然后,我们使用Vicuna的微调格式应用了以下模型。

训练过程

使用8个A100 GPU进行了35小时的训练。

权重

您可以在我们在训练中使用的 dataset 中看到,并在huggingface中看到 13b model 。

结论

如果我们将对话延伸到gpt4 32K,我们可以期望显着提高,因为我们可以生成8倍更多、更准确且更丰富的对话。

许可证

该模型基于LLaMA模型许可证,数据集基于OpenAI的条款许可。其他内容都是免费的。